« Infrastructure KVM/QEMU+Kubernetes+CEPH » : différence entre les versions

| Ligne 319 : | Ligne 319 : | ||

<code>sed -i 's/10.244.0.0\/16/10.85.0.0\/16/g' kube-flannel.yml</code> | <code>sed -i 's/10.244.0.0\/16/10.85.0.0\/16/g' kube-flannel.yml</code> | ||

<code>sed -i 's/cbr0/cni0/g' kube-flannel.yml</code> | |||

A déployer comme suit : | A déployer comme suit : | ||

Version du 13 février 2024 à 01:57

Article en cours de rédaction ou de modification !

Le présent article est actuellement en cours de rédaction ou de modification.

Adressez-vous à la personne en charge pour toute proposition ou modification.

| Aide Pour lire ce wiki convenablement, merci de lire la page suivante concernant les conventions de nommage. |

Introduction :

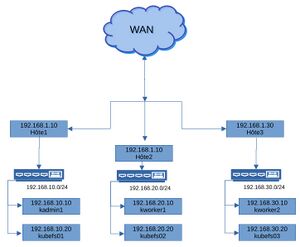

Nous allons présenter ici une infrastructure "Kubernetes" qui peut être mise en oeuvre sur 3 Hyperviseurs "bare metal" (machines physiques) KVM/QEMU ou simplement sur 3 Machines virtuelles (VM).

A savoir que cela reste une base qui peut être largement amélioré/modifié selon les besoins et vos possibilités.

Cette documentation est fortement inspirée en partie à partir du lien suivant pour la partie Kubernetes et CEPH. Sans le copier/coller et les erreurs intentionnelles ou non :

https://www.server-world.info/en/note?os=Fedora_38&p=kubernetes&f=1

https://fedoramagazine.org/kubernetes-with-cri-o-on-fedora-linux-39/

La documentation officielle de Kubernetes est disponible ici :

https://kubernetes.io/fr/docs/home/

A savoir que l'on s'éloigne d'une procédure pouvant être mis en œuvre pour passer les certifications Kubernetes (CKA, CKD, CKS, etc...).

Pré-requis :

Il nous faut donc :

- S'assurer d'avoir activé, après confirmation que le processeur les supporte, les options de virtualisation matérielle dans le bios de de la carte mère (voir la documentation de celle-ci) de chaque hôte physique.

- 1 hôte physique "hote1" disposant d'une interface graphique (ici KDE/plasma) étant à la fois :

- Administrateur pour les 3 hyperviseurs physiques avec Virt-manager

- Hyperviseur

- Minimum requis conseillé :

- 1 processeur 4 coeurs/8 threads

- 16Go de RAM (ou 32Go si vous n'utilisez qu'un seul hyperviseur/machine physique)

- 2 hôtes physiques "hyperviseurs" "hote2" et "hote3"

- Minimum requis conseillé :

- 1 processeur 4 coeurs/8 threads

- 16Go de RAM

- Minimum requis conseillé :

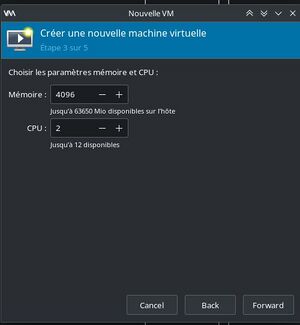

- 1 VM (machine virtuelle) "kadmin1" :

- 2->4 vcpu + 4Go de RAM minimum recommandé

- Utilisée en tant que "Control Plane" kubernete

- 1 VM "Worker" par hôte :

- 2->4vcpu + 6/8Go de RAM minimum recommandés par hôte

- Sert à déployer nos pods

- Nommée "kworker1" et "kworker2", etc...

- DNS :

- Soit on ajoute les IP correspondant aux noms des VM dans /etc/hosts pour chaque hyperviseur et VM

- Soit on installe un serveur DNS personnel à notre infrastructure

- Exemple : Vous pouvez utiliser celui fourni à l'installation de FreeIPA (IPA ou IDM/Identity manager)

- Autres...

- CEPH (optionnel) :

- Pour gérer le stockage permanent (d'autres solutions existent NFS, glusterFS, etc...)

- 3 VM (peut être réparti sur les 3 hyperviseurs) composé de :

- 1 ou 2 vcpu, 2Go de RAM minimum conseillés

- Une unité de stockage de 10Go minimum virtuelle (possibilité d'utiliser des unités de stockage physique dédié et autres types)

- 3 VM (peut être réparti sur les 3 hyperviseurs) composé de :

- Pour gérer le stockage permanent (d'autres solutions existent NFS, glusterFS, etc...)

Schémas d'architecture :

Avec 3 hyperviseurs bare-metal + VM (exemple, rien ne vous empêche d'ajouter d'autres VM sur les mêmes hôtes:

- hote1 :

- kadmin1

- hote2 :

- kworker1

- hote3 :

- kworker2

Avec 1 hyperviseur bare-metal + VM :

kadmin1

kworker1

kworker2

Configuration Réseaux (si 3 hyperviseurs bare-metal) :

Routage :

Il est nécessaire de rajouter le routage vers le réseau virtuel, voir plusieurs si nécessaire, prédéfini par "Hyperviseur" physique.

Cette partie n'est pas nécessaire si l'on ne déploie pas sur plusieurs hôtes physiques.

On utilisera le routage suivant :

hote1 :

192.168.10.0/24 (kadmin1 192.168.10.10, kwork1 192.168.10.20)

hote2 :

192.168.20.0/24 (kwork2 192.168.20.20)

hote3 :

192.168.30.0/24 (kwork3 192.168.30.20)

On rajoutera le mode "masquerade" et "forward" au niveau du pare-feu (firewall) :

# firewall-cmd --add-masquerade && firewall-cmd --add-masquerade --permanent # firewall-cmd --add-forward && firewall-cmd --add-forward --permanent

On lance la commande pour prendre en compte directement les règles du pare-feu :

# firewall-cmd --reload

Il existe plusieurs méthodes, mais les deux plus communes sont :

1 : En ligne de commande avec "nmcli" (Modifier ce qui est en GRAS):

Pour ajouter de nouvelles routes à votre interface réseau, nous utiliserons principalement la commande "nmcli" comme suit:

Hôte 1 :

#nmcli connection modify enp1s0 +ipv4.routes "192.168.20.0/24 VERS-IP-DE-hote2"#nmcli connection modify enp1s0 +ipv4.routes "192.168.30.0/24 VERS-IP-DE-hote3"

Hôte 2 :

#nmcli connection modify enp2s0 +ipv4.routes "192.168.10.0/24 VERS-IP-DE-hote1"#nmcli connection modify enp2s0 +ipv4.routes "192.168.30.0/24 VERS-IP-DE-hote3"

Hôte 3 :

#nmcli connection modify enp3s0 +ipv4.routes "192.168.10.0/24 VERS-IP-DE-hote1"#nmcli connection modify enp3s0 +ipv4.routes "192.168.20.0/24 VERS-IP-DE-hote2"

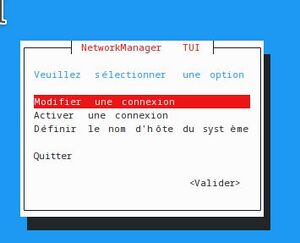

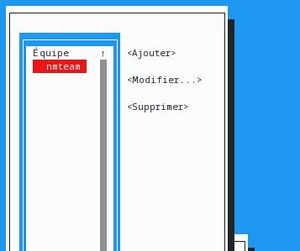

2 : Avec l'interface "nmtui" disponible avec "NetworkManager-tui" :

# dnf install NetworkManager-tui

Lancer :

# nmtui

Sur "Modifier une connexion"

Choisisez votre périphérique réseau (généralement "enpXsX")

Allez sur "[Routage]..."

Ajouter les routes des Switch virtuels :

Hôte 1 :

"192.168.20.0/24 VERS-IP-DE-hote2""192.168.30.0/24 VERS-IP-DE-hote3"

Hôte 2 :

"192.168.10.0/24 VERS-IP-DE-hote1""192.168.30.0/24 VERS-IP-DE-hote3"

Hôte 3 :

"192.168.10.0/24 VERS-IP-DE-hote1""192.168.20.0/24 VERS-IP-DE-hote2"

KVM/QEMU (hyperviseurs) :

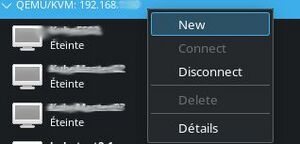

On utilisera l'interface graphique "virt-manager" pour créer et gérer les 3 hyperviseurs sur un hôte, qui sera donc le gestionnaire de ceux ci, ayant un environnement graphique. (la création et gestion en ligne de commande est possible, mais plus complexe)

Voici le lien de base pour installer et configurer vos VM (à faire sur chaque hyperviseur) : Virtualisation : KVM, Qemu, libvirt en images

Il est nécessaire de créer et partager la clef du gestionnaire avec les hyperviseurs : SSH : Authentification par clé

Ajout des hyperviseurs distant :

Captures d'écran

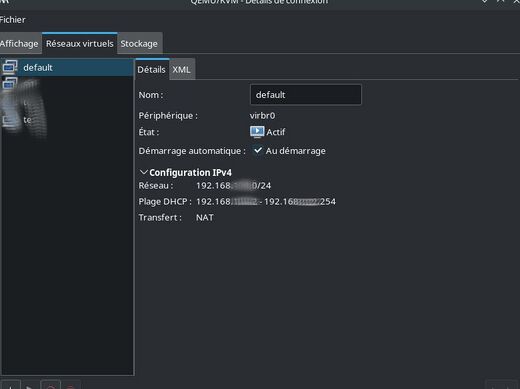

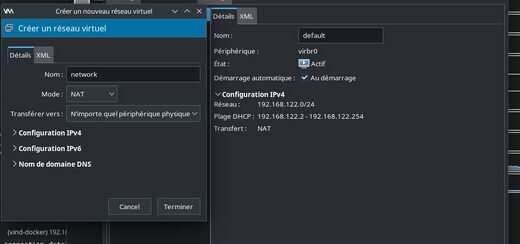

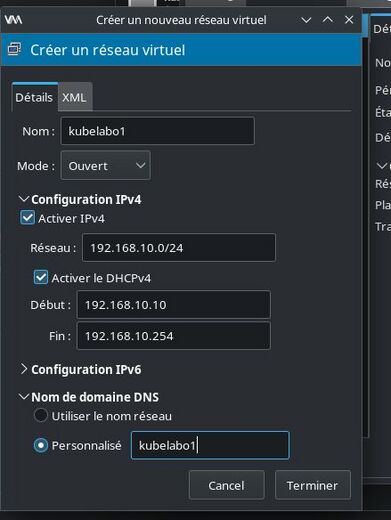

Réseaux virtuels (à faire sur chaque hyperviseur) :

Ajout d'un réseau virtuel en mode "ouvert" (open) :

Capture interface "Réseaux virtuels" :

On change le mode par "Ouvert" ("OPEN") :

IPV4 (remplacer XX selon l'hôte en 1 : "10", en 2 : "20", etc...) :

Réseau en 192.168.XX.0/24

DHCPV4 192.168.XX.10->192.168.XX.100

Nom de domaine DNS :

"Personnalisé" : ici kubelabo1/2/3/...

Ce réseau sera à utiliser dans la configuration de nos VM.

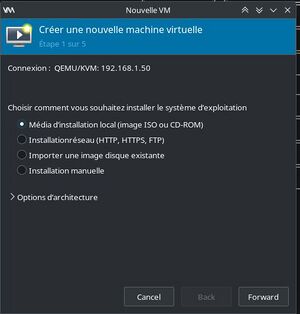

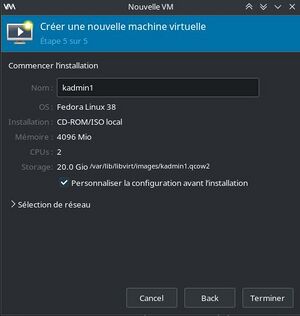

Création des Machines virtuelles :

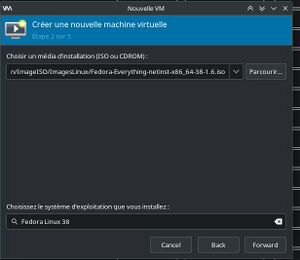

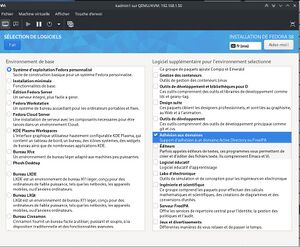

On utilisera une ISO Fedora (dernière en date) pour déployer nos machines virtuelles.

Il est préférable de partir sur une Fedora "Everything" qui permet d'installer que ce dont nous avons besoin.

Exemple ici :

On clique droit sur notre hyperviseur et l'on fait "New"

On choisi comment créer notre VM

Choix de l'ISO utilisé pour l'installation avec le type de système utilisé

On sélectionne la taille de la mémoire et du/des vcpu

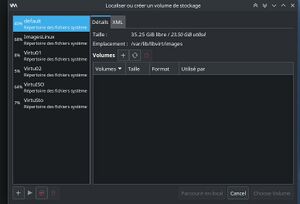

On crée notre unité de stockage personnalisé dans l'emplacement désiré

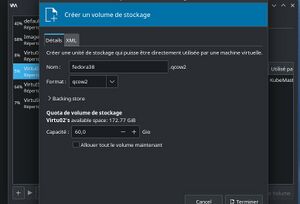

Choix d'une unité de stockage virtuel personnel (nom, taille, format)

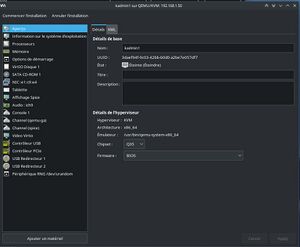

Définition du nom, sélection du réseau précédemment défini (ici ce sera R2 en mode "Open") et l'on coche la case pour activer la configuration personnalisé

On vérifie les options et on commence l'installation

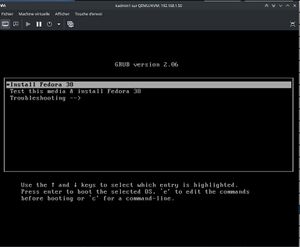

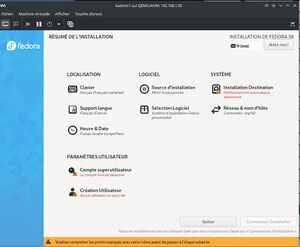

On lance l'installation de Fedora (ici en version 38)

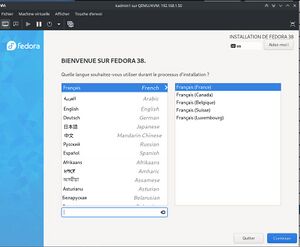

Choix de langue du système et du clavier

On modifie les différentes partie de notre système

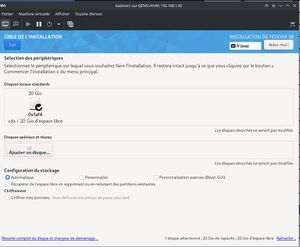

On défini notre système de fichier (ici automatiquement pour le disque système)

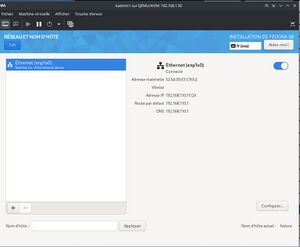

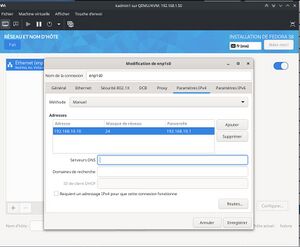

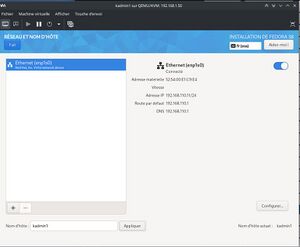

On reconfigure notre carte réseau

On fixe les paramètres "IP/Masque de sous réseau/Passerelles" et le/les DNS.

On modifie le "Nom d'hôte"

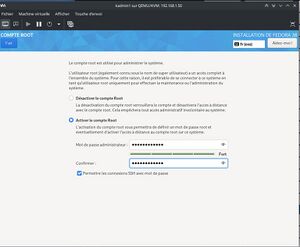

On défini un mot de passe ROOT et on active l'accès à distance (à modifier par la suite si besoin)

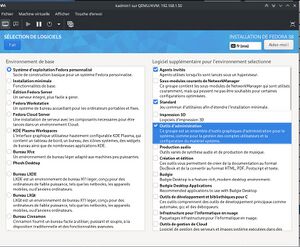

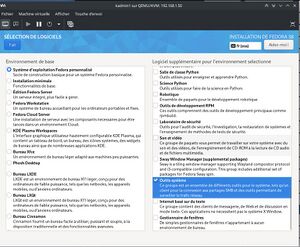

On sélectionne l'option par défaut et on active "Agent invité" (pour les VM),"Standard" et "Outils d'administration"

Plus bas on sélectionne "Outils système"

Et "Adhésion à un domaine" si nécessaire

On peut "commencer l'installation"

Firewalld :

Nous utiliserons firewalld (A revoir, il y a un problème de redirection des fluxs Kubernetes avec le périphérique "cni0" en mode "BRIDGE") :

# firewall-cmd --add-masquerade --permanent # firewall-cmd --add-forward --permanent

On active les services du pare-feu pour Kubernetes :

# firewall-cmd --add-service=kube-controller-manager-secure --add-service=kube-api --add-service=kube-apiserver --add-service=kube-controller-manager-secure --add-service=kube-controller-manager --add-service=kube-control-plane --add-service=kube-control-plane-secure --add-service=kubelet --add-service=kubelet-readonly --add-service=kubelet-worker --add-service=kube-nodeport-services --add-service=kube-scheduler --add-service=kube-scheduler-secure --add-service=kube-worker --permanent # firewall-cmd --permanent --add-port=8472/udp --zone=trusted # firewall-cmd --permanent --zone=trusted --add-interface=flannel.1 --add-interface=cni0

On lance la commande pour prendre en compte directement les règles du pare-feu :

# firewall-cmd --reload

Kubernetes (VM) :

La version de kubernetes fournie par défaut dépend de la version de Fedora installée.

1.25 pour Fedora 37, en 1.26 pour Fedora 38, etc...

Installation sur "kadmin1" (en root) en tant que "Controle Plane" :

Que l'on ajoute dans un fichier (A revoir) :

# cat <<EOF | sudo tee /etc/modules-load.d/k8s.conf overlay br_netfilter EOF

On relance les modules systemd pour la bonne prise en compte :

# systemctl restart systemd-modules-load.service

On active quelques options système (A revoir, la partie "iptables" ne semble pas nécessaire) :

# cat <<EOF | sudo tee /etc/sysctl.d/k8s.conf net.bridge.bridge-nf-call-iptables = 1 net.bridge.bridge-nf-call-ip6tables = 1 net.ipv4.ip_forward = 1 user.max_pid_namespaces = 1048576 user.max_user_namespaces = 1048576 vm.swappiness = 10 EOF

Que l'on activera avec :

# sysctl --system

Pour information : On gardera la gestion de la SWAP avec une utilisation au dernier moment (par défaut on utilise de la ZRAM en mémoire RAM, mais il est possible de rajouter de la SWAP sur unité de stockage)

Bien qu'il soit conseillé de désactiver la SWAP, il est préférable de ne pas le faire ayant eu souvent le cas où le manque de mémoire RAM à entraîné l'arrêt par OOMKILLER des pods/containers (en perso ou en pro).

On installe les paquets suivant :

# dnf install -y cri-o cri-tools crun kubernetes-client kubernetes-kubeadm kubernetes-node

On vas modifier les paramètres de kubelet et crio et, dans ce dernier, rajouter l'utilisation de "crun" à la place de "runc" pour une meilleur gestion de l'empreinte mémoire (reprise de l'article de Fedoramagazine) :

# sed -i 's/KUBELET_ADDRESS="--address=127.0.0.1"/KUBELET_ADDRESS="--address=0.0.0.0"/g' /etc/kubernetes/kubelet # sed -i 's/# KUBELET_PORT="--port=10250"/KUBELET_PORT="--port=10250"/g' /etc/kubernetes/kubelet # sed -i 's/KUBELET_HOSTNAME="--hostname-override=127.0.0.1"/KUBELET_HOSTNAME="--hostname-override=$HOSTNAME"/g' /etc/kubernetes/kubelet # sed -i 's/# cgroup_manager/cgroup_manager/g' /etc/crio/crio.conf # sed -i 's/# default_runtime = "runc"/default_runtime = "crun"/g' /etc/crio/crio.conf # mkdir /etc/crio/crio.conf.d # tee -a /etc/crio/crio.conf.d/90-crun <<CRUN [crio.runtime.runtimes.crun] runtime_path = "/usr/bin/crun" runtime_type = "oci" CRUN

On ajoute la configuration de l'uid/gid des utilisateurs/groupes pour kubernetes :

# echo "containers:1000000:1048576" | sudo tee -a /etc/subuid # echo "containers:1000000:1048576" | sudo tee -a /etc/subgid # tee -a /etc/crio/crio.conf.d/91-userns <<USERNS [crio.runtime.workloads.userns] activation_annotation = "io.kubernetes.cri-o.userns-mode" allowed_annotations = ["io.kubernetes.cri-o.userns-mode"] USERNS # chcon -R --reference=/etc/crio/crio.conf /etc/crio/crio.conf.d/ # ls -laZ /etc/crio/crio.conf.d/

On recharge systemd pour prendre en compte nos modifications :

# systemctl daemon-reload

On active le service kubelet :

# systemctl enable kubelet.service

Et on active et démarre le service "crio" :

# systemctl enable --now crio.service

On récupère ou change le subnet du fichier "/etc/cni/net.d/100-crio-bridge.conflist" (en gras), ici "10.85.0.0/16" :

{

"cniVersion": "1.0.0",

"name": "crio",

"plugins": [

{

"type": "bridge",

"bridge": "cni0",

"isGateway": true,

"ipMasq": true,

"hairpinMode": true,

"ipam": {

"type": "host-local",

"routes": [

{ "dst": "0.0.0.0/0" },

{ "dst": "::/0" }

],

"cniVersion": "1.0.0",

"ranges": [

[{ "subnet": "10.85.0.0/16" }],

[{ "subnet": "1100:200::/24" }]

]

}

}

]

}

On peut initialiser notre kubernetes comme suit (les noeuds prennent le nom du "hostname" dans notre cas) et l'on modifie l'IP du controlPlaneEndpoint avec l'ip/port du "kadmin1", "podSubnet" (correspond à l'option "--pod-network-CIDR") par celle du premier "subnet" reprise ci-dessus, exemple :

# cat <<CONFIG > kubeadmin-config.yaml

---

apiVersion: kubeadm.k8s.io/v1beta3

kind: InitConfiguration

nodeRegistration:

criSocket: "unix:///var/run/crio/crio.sock"

imagePullPolicy: "IfNotPresent"

kubeletExtraArgs:

cgroup-driver: "systemd"

resolv-conf: "/run/systemd/resolve/resolv.conf"

max-pods: "4096"

max-open-files: "20000000"

---

apiVersion: kubeadm.k8s.io/v1beta3

kind: ClusterConfiguration

kubernetesVersion: "1.27.0"

controlPlaneEndpoint: "IP_kadmin1:6443"

networking:

podSubnet: "10.85.0.0/16"

serviceSubnet: "172.16.16.0/24"

controllerManager:

extraArgs:

node-cidr-mask-size: "20"

allocate-node-cidrs: "true"

---

CONFIG

On peut initialiser notre kubernetes comme suit :

# kubeadm init --config=kubeadmin-config.yaml --skip-token-print=true

Si tout ce passe bien, nous devrions pouvoir récupérer l'IP:Port du master et son token pour les workers (avec une durée limité) :

# kubeadm token create --ttl=30m --print-join-command

Nous vous conseillons de copier les commandes/token quelque part dans un portefeuille numérique crypté (keepass, kwallet, etc...)

Pour avoir accès en permanence aux commandes "kube" et complétion-automatique, on lance la suite de commande suivante sur le/les "Controle Plane" :

# mkdir -p $HOME/.kube # sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config # sudo chown $(id -u):$(id -g) $HOME/.kube/config

Ou temporairement :

# export KUBECONFIG=/etc/kubernetes/admin.conf

On ajoutera le pilote CNI "flannel" :

Flannel est un plug-in CNI open source mature et stable conçu autour d’un modèle de réseau superposé basé sur VXLAN et adapté à la plupart des cas d’utilisation de Kubernetes.

wget https://github.com/coreos/flannel/raw/master/Documentation/kube-flannel.yml

On vas modifier le fichier "kube-flannel.yml" avant de l'appliquer, car il est nécessaire de changer l'IP par défaut :

sed -i 's/10.244.0.0\/16/10.85.0.0\/16/g' kube-flannel.yml

sed -i 's/cbr0/cni0/g' kube-flannel.yml

A déployer comme suit :

# kubectl apply -f kube-flannel.yml

Il existe d'autre types de pilotes (calico, calcium, etc...), à vous de trouver celui qui vous convient le mieux.

Installation en tant que "Worker" sur "kworker1 et kworker2" (et autres) :

Firewalld :

Nous utiliserons firewalld :

# firewall-cmd --add-masquerade --permanent # firewall-cmd --add-forward --permanent

On active les services du pare-feu pour Kubernetes :

# firewall-cmd --add-service=kubelet --add-service=kube-worker --add-service=kube-nodeport-services --add-service=kubelet-readonly --permanent # firewall-cmd --add-port=30000-30250/tcp --permanent # firewall-cmd --permanent --add-port=8472/udp --zone=trusted # firewall-cmd --permanent --zone=trusted --add-interface=flannel.1 --add-interface=cni0

On lance la commande pour prendre en compte directement les règles du pare-feu :

# firewall-cmd --reload

On installe les paquets suivant

# dnf install -y cri-o cri-tools crun kubernetes-client kubernetes-kubeadm kubernetes-node

On ajoute les modules overlay/br_netfilter :

# cat <<EOF | sudo tee /etc/modules-load.d/k8s.conf overlay br_netfilter EOF

On relance les modules systemd pour la bonne prise en compte :

# systemctl restart systemd-modules-load.service

On active quelques options système :

# cat <<EOF | sudo tee /etc/sysctl.d/k8s.conf net.bridge.bridge-nf-call-iptables = 1 net.bridge.bridge-nf-call-ip6tables = 1 net.ipv4.ip_forward = 1 user.max_pid_namespaces = 1048576 user.max_user_namespaces = 1048576 vm.swappiness = 10 EOF

Que l'on activera avec :

# sysctl --system

On vas modifier les paramètres de kubelet et crio et, dans ce dernier, rajouter l'utilisation de "crun" à la place de "runc" pour une meilleur gestion de l'empreinte mémoire (reprise de l'article de Fedoramagazine) :

# sed -i 's/KUBELET_ADDRESS="--address=127.0.0.1"/KUBELET_ADDRESS="--address=0.0.0.0"/g' /etc/kubernetes/kubelet # sed -i 's/# KUBELET_PORT="--port=10250"/KUBELET_PORT="--port=10250"/g' /etc/kubernetes/kubelet # sed -i 's/KUBELET_HOSTNAME="--hostname-override=127.0.0.1"/KUBELET_HOSTNAME="--hostname-override=$HOSTNAME"/g' /etc/kubernetes/kubelet # sed -i 's/# cgroup_manager/cgroup_manager/g' /etc/crio/crio.conf # sed -i 's/# default_runtime = "runc"/default_runtime = "crun"/g' /etc/crio/crio.conf # mkdir /etc/crio/crio.conf.d # tee -a /etc/crio/crio.conf.d/90-crun <<CRUN [crio.runtime.runtimes.crun] runtime_path = "/usr/bin/crun" runtime_type = "oci" CRUN

On ajoute la configuration de l'uid/gid des utilisateurs/groupes pour kubernetes :

# echo "containers:1000000:1048576" | sudo tee -a /etc/subuid # echo "containers:1000000:1048576" | sudo tee -a /etc/subgid # tee -a /etc/crio/crio.conf.d/91-userns <<USERNS [crio.runtime.workloads.userns] activation_annotation = "io.kubernetes.cri-o.userns-mode" allowed_annotations = ["io.kubernetes.cri-o.userns-mode"] USERNS # chcon -R --reference=/etc/crio/crio.conf /etc/crio/crio.conf.d/ # ls -laZ /etc/crio/crio.conf.d/

On recharge systemd pour prendre en compte nos modifications :

# systemctl daemon-reload

On active le service kubelet :

# systemctl enable kubelet.service

Et on active et démarre le service "crio" :

# systemctl enable --now crio.service

Et on lancera donc la commande pour rattacher nos nœud en tant que "worker" retourné par le retour de "kubeadm init..." :

# cat <<CONFIG > join-config.yaml

---

apiVersion: kubeadm.k8s.io/v1beta3

kind: JoinConfiguration

discovery:

bootstrapToken:

token: <TOKEN>

apiServerEndpoint: 192.168.xx.xx:6443

caCertHashes: ["sha256:xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx"]

timeout: 5m

nodeRegistration:

criSocket: "unix:///var/run/crio/crio.sock"

imagePullPolicy: "IfNotPresent"

kubeletExtraArgs:

cgroup-driver: "systemd"

resolv-conf: "/run/systemd/resolve/resolv.conf"

max-pods: "4096"

max-open-files: "20000000"

---

CONFIG

Que l'on initialisera comme suit après modification :

# kubeadm join --config=join-config.yaml

Sur "kadmin1 :

On teste si l'on voit tous les noeuds :

# kubectl get nodes

Résultat (exemple) :

# kubectl get nodes NAME STATUS ROLES AGE VERSION kadmin1 Ready control-plane 206d v1.26.7 kworker1 Ready <none> 205d v1.26.7 kworker2 Ready <none> 205d v1.26.7

On va modifier le rôle par défaut de nos nœuds en tant que "Worker" :

# kubectl label node kube0x node-role.kubernetes.io/worker="worker"

Résultat (exemple) :

# kubectl get nodes NAME STATUS ROLES AGE VERSION kadmin1 Ready control-plane 206d v1.26.7 kworker1 Ready worker 205d v1.26.7 kworker2 Ready worker 205d v1.26.7

Pour vérifier les pods :

# kubectl get pods -A -o wide

Résultat (exemple) :

kube-system coredns-xxxx-6sgjh 1/1 Running 12 120d kube-system coredns-xxxx-j2478 1/1 Running 19 141d kube-system coredns-xxxxx-x58lj 1/1 Running 25 52d kube-system etcd-kubexxxxx01.xxxxx 1/1 Running 126 206d kube-system kube-apiserver-kubexxxxr01.xxxxx 1/1 Running 31 157d kube-system kube-controller-manager-kubexxxxr01.xxxx 1/1 Running 31 157d kube-system kube-proxy-6jfzb 1/1 Running 25 157d kube-system kube-proxy-92vd4 1/1 Running 26 157d kube-system kube-proxy-gpkdq 1/1 Running 29 157d kube-system kube-proxy-hthq6 1/1 Running 11 154d kube-system kube-proxy-n62vl 1/1 Running 6 157d kube-system kube-scheduler-kubexxxxr01.xxxx 1/1 Running 25 141d kubernetes-dashboard dashboard-metrics-scraper-64bcc67c9c-mftc6 1/1 Running 22 152d kubernetes-dashboard kubernetes-dashboard-5c8bd6b59-gtwtm 1/1 Running 22 152d kube-flannel kube-flannel-ds-tqps8 1/1 Running 4 75m kube-flannel kube-flannel-ds-z2kvm 1/1 Running 4 75m kube-flannel kube-flannel-ds-x7bgm 1/1 Running 4 75m

Commandes utiles :

Toutes les commandes utiles sont généralement disponibles ici : https://kubernetes.io/fr/docs/reference/kubectl/cheatsheet/

Nous rajouterons au fur et à mesure celles qui nous semblent les plus importantes ici :

- Pour récupérer la commande, ainsi que son token, pour ajouter un noeud :

kubeadm token create --print-join-command

- Pour récupérer la clef du certificat :

kubeadm init phase upload-certs --upload-certs

Résultat :

I0xx 17:01:40.112468 19386 version.go:256] remote version is much newer: v1.28.1; falling back to: stable-1.26 [upload-certs] Storing the certificates in Secret "kubeadm-certs" in the "kube-system" Namespace [upload-certs] Using certificate key: 2xxxxxxxxxxxxxxxxxxxxxxxxxxxxf57ca186bbc34xxxxxxxxxxxxxxxxxxxx

Export de notre configuration dans un fichier pour certains outils (exemple "kubenav" sur android disponible par F-droid : https://f-droid.org/packages/io.kubenav.kubenav/) :

kubectl config view --raw > kubetest.yaml

Mise à jours des noeuds :

Nous pouvons lancer une petite boucle en ligne de commande pour mettre à jours nos noeuds en même temps :

for NODE in kadmin1 kworker1 kworker2; do ssh $NODE "dnf clean all && dnf upgrade -y"; done

Ceph : (En cours)

Basé sur la documentation officielle :

https://docs.ceph.com/en/latest/rbd/rbd-kubernetes/

Cette partie est un brouillon, merci de ne pas en tenir compte pour le moment

Nous utiliserons le mode "POOL" mais il est possible d'en utiliser d'autres :

Pre-requis pour cette exemple :

- 3 VM appelé kubefs01,kubefs02 et kubefs03 :

- 1 VM par hôte physique (sauf dans le cas où vous n'utilisez pas cette partie)

- Composé au minimum de :

- 2 vcpu (possible de n'en mettre qu'un, mais cela n'est pas conseillé)

- 2Go de RAM

- 1 stockage supplémentaire de 10Go dédié au stockage CEPH

- Même conditions que pour la création des VM et concernant la partie réseau décrite ci-dessus

- Rajouter l'ip et le nom de ces VM dans /etc/hosts (exemple "192.168.10.XX kubefs01", etc...)

Configuration préliminaire des nœuds :

Générer une clef ssh à partager sur les noeuds à partir du premier (ici kubefs01) :

# ssh-keygen -t ed25519 -q -N ""

# create new (define each Node and SSH user)

Host node01

Hostname kubefs01

User root

Host node02

Hostname kubefs02

User root

Host node03

Hostname kubefs03

User root

# chmod 600 ~/.ssh/config

Lancer la copy de la clef sur vos différents noeuds :

# ssh-copy-id node01

# ssh-copy-id node02

# ssh-copy-id node03

On lancera la boucle suivante :

# for NODE in node01 node02 node03

do

ssh $NODE "dnf -y install ceph"

done

On génère un fsid que l'on notera à part :

# uuidgen

On édite le fichier de configuration de CEPH :

# vi /etc/ceph/ceph.conf

Comme ce qui suit en modifiant le fsid généré précédemment et l'IP de l'hôte :

[global]

# specify cluster network for monitoring

cluster network = 192.168.0.0/16/24

# specify public network

public network = 192.168.0.0/16/24

# specify UUID genarated above

fsid = xxxxxxx-xsdx-xxxxx-xxxxx-xxxxxxxx

# specify IP address of Monitor Daemon

mon host = 192.168.10.XX

# specify Hostname of Monitor Daemon

mon initial members = node01

osd pool default crush rule = -1

# mon.(Node name)

[mon.node01]

# specify Hostname of Monitor Daemon

host = node01

# specify IP address of Monitor Daemon

mon addr = 192.168.10.XX

# allow to delete pools

mon allow pool delete = true

ceph-authtool --create-keyring /etc/ceph/ceph.mon.keyring --gen-key -n mon. --cap mon 'allow *'

ceph-authtool --create-keyring /etc/ceph/ceph.client.admin.keyring --gen-key -n client.admin --cap mon 'allow *' --cap osd 'allow *' --cap mds 'allow *' --cap mgr 'allow *'

ceph-authtool --create-keyring /var/lib/ceph/bootstrap-osd/ceph.keyring --gen-key -n client.bootstrap-osd --cap mon 'profile bootstrap-osd' --cap mgr 'allow r'

ceph-authtool /etc/ceph/ceph.mon.keyring --import-keyring /etc/ceph/ceph.client.admin.keyring

ceph-authtool /etc/ceph/ceph.mon.keyring --import-keyring /var/lib/ceph/bootstrap-osd/ceph.keyring

FSID=$(grep "^fsid" /etc/ceph/ceph.conf | awk {'print $NF'})

NODENAME=$(grep "^mon initial" /etc/ceph/ceph.conf | awk {'print $NF'})

NODEIP=$(grep "^mon host" /etc/ceph/ceph.conf | awk {'print $NF'})

monmaptool --create --add $NODENAME $NODEIP --fsid $FSID /etc/ceph/monmap

mkdir /var/lib/ceph/mon/ceph-node01

ceph-mon --cluster ceph --mkfs -i $NODENAME --monmap /etc/ceph/monmap --keyring /etc/ceph/ceph.mon.keyring

chown ceph: /etc/ceph/ceph.*

chown -R ceph: /var/lib/ceph/mon/ceph-node01 /var/lib/ceph/bootstrap-osd

systemctl enable --now ceph-mon@$NODENAME

ceph mon enable-msgr2

ceph mgr module enable pg_autoscaler

mkdir /var/lib/ceph/mgr/ceph-node01

ceph auth get-or-create mgr.$NODENAME mon 'allow profile mgr' osd 'allow *' mds 'allow *'

ceph auth get-or-create mgr.node01 > /etc/ceph/ceph.mgr.admin.keyring

cp /etc/ceph/ceph.mgr.admin.keyring /var/lib/ceph/mgr/ceph-node01/keyring

chown ceph: /etc/ceph/ceph.mgr.admin.keyring

chown -R ceph: /var/lib/ceph/mgr/ceph-node01

systemctl enable --now ceph-mgr@$NODENAME

On rajoute un module CEPH pour selinux en créant un fichier .te comme suit :

# vi cephmon.te

# create new

module cephmon 1.0;

require {

type ceph_t;

type ptmx_t;

type initrc_var_run_t;

type sudo_exec_t;

type chkpwd_exec_t;

type shadow_t;

class file { execute execute_no_trans lock getattr map open read };

class capability { audit_write sys_resource };

class process setrlimit;

class netlink_audit_socket { create nlmsg_relay };

class chr_file getattr;

}

#============= ceph_t ==============

allow ceph_t initrc_var_run_t:file { lock open read };

allow ceph_t self:capability { audit_write sys_resource };

allow ceph_t self:netlink_audit_socket { create nlmsg_relay };

allow ceph_t self:process setrlimit;

allow ceph_t sudo_exec_t:file { execute execute_no_trans open read map };

allow ceph_t ptmx_t:chr_file getattr;

allow ceph_t chkpwd_exec_t:file { execute execute_no_trans open read map };

allow ceph_t shadow_t:file { getattr open read };

On lance la suite de commande suivante pour générer ce qui va bien et l'activer :

# checkmodule -m -M -o cephmon.mod cephmon.te

# semodule_package --outfile cephmon.pp --module cephmon.mod

# semodule -i cephmon.pp

On lance une boucle pour activer le service "ceph" du pare-feu sur chaque nœud :

for NODE in node01 node02 node03

do

ssh $NODE "firewall-cmd --add-service=ceph; firewall-cmd --runtime-to-permanent"

done

for NODE in node01 node02 node03

do

if [ ! ${NODE} = "node01" ]

then

scp /etc/ceph/ceph.conf ${NODE}:/etc/ceph/ceph.conf

scp /etc/ceph/ceph.client.admin.keyring ${NODE}:/etc/ceph

scp /var/lib/ceph/bootstrap-osd/ceph.keyring ${NODE}:/var/lib/ceph/bootstrap-osd

fi

ssh $NODE \

"chown ceph. /etc/ceph/ceph.* /var/lib/ceph/bootstrap-osd/*; \

parted --script /dev/vdb 'mklabel gpt'; \

parted --script /dev/vdb "mkpart primary 0% 100%"; \

ceph-volume lvm create --data /dev/vdb1"

done

# ssh kadmin1 "dnf -y install ceph-common"

# scp /etc/ceph/ceph.conf kadmin1:/etc/ceph/

# scp /etc/ceph/ceph.client.admin.keyring kadmin1:/etc/ceph/

# ssh kadmin1 "chown ceph: /etc/ceph/ceph.*"

# mkdir -p /var/lib/ceph/mds/ceph-node01

# ceph-authtool --create-keyring /var/lib/ceph/mds/ceph-node01/keyring --gen-key -n mds.node01

# chown -R ceph: /var/lib/ceph/mds/ceph-node01

# ceph auth add mds.node01 osd "allow rwx" mds "allow" mon "allow profile mds" -i /var/lib/ceph/mds/ceph-node01/keyring

# systemctl enable --now ceph-mds@node01

# scp /etc/ceph/ceph.conf dlp:/etc/ceph/

# scp /etc/ceph/ceph.client.admin.keyring dlp:/etc/ceph/

# ssh dlp "chown ceph: /etc/ceph/ceph.*"

Exemples pratiques :

Avancée :

Sécurité :

Pare-feu(firewall) :

la procédure ci-dessus ne permet pas de sécuriser notre infra kubernetes complètement coté système. Pour cela il est préférable de partir sur une configuration du pare-feu plus avancée.

Ici -> liens pour approfondir cette partie

Exemple :

A suivre

Kubernetes :

https://kubernetes.io/docs/concepts/security/ (en anglais)

https://www.redhat.com/fr/topics/containers/intro-kubernetes-security (en français généralement)