« LocalAI Assistant à base de modèles IA » : différence entre les versions

m →Optimisation : : Correction |

|||

| (82 versions intermédiaires par 3 utilisateurs non affichées) | |||

| Ligne 1 : | Ligne 1 : | ||

{{EnCours|auteur=VINDICATORs}}{{Auteur|VINDICATORs}} | {{EnCours|auteur=VINDICATORs}}{{Auteur|VINDICATORs}} | ||

{{Guide}} | |||

== Introduction == | == Introduction == | ||

Je vais vous présenter l'installation d'une instance pour | Je vais vous présenter l'installation d'une instance pour bénéficier d'un assistant personnel basé sur des modèles neuronaux, disponibles librement ou sous certaines conditions, et qui peut être installé en local. | ||

Pour cela nous utiliserons LocalAI qui est une | Pour cela, nous utiliserons '''LocalAI''', qui est une API REST open source alternative à '''OpenAI''' :https://localai.io/ | ||

Vous pouvez déployer la solution directement, dans un container | Vous pouvez déployer la solution directement sur votre système, dans un container <app>Podman</app>/<app>Docker</app> ou sur un cluster <app>Kubernetes</app>. | ||

Cette documentation | Cette documentation se concentrera sur l'installation dans des containers avec <app>Podman</app> : https://podman.io/ | ||

Nous aborderons également l'intégration avec votre serveur Nextcloud à partir de la version Hub 8 (29.x) : https://nextcloud.com/fr/ | |||

Nous n'utiliserons qu'une | Nous n'utiliserons qu'une seule instance sur un simple nœud (une machine physique ou virtuelle), mais il est possible d'en utiliser plusieurs pour du calcul en parallèle | ||

== Présentation == | == Présentation == | ||

<app>LocalAI</app> permet d'avoir une solution locale pour la mise à disposition et l’exploitation de modèles d’'''Intelligence Artificielle''' ('''IA''' ou '''AI''' en anglais) en local (pas de connexion Internet nécessaire), généralement libre et/ou avec quelques conditions. | |||

Parmi les modèles et options | Parmi les modèles et options proposés vous pouvez disposer : | ||

* De tchats (Conversationnels + Traducteurs multi-lingues) | |||

* De générateurs d'Images | |||

* De convertisseurs Vidéo/Musique vers du Texte | |||

* De convertisseurs Texte vers Voix | |||

* '''''Et bien d'autres possibilités présentes et à venir...''''' | |||

== Pré-Requis == | |||

Nous vous conseillons de bien régler les paramètres de votre BIOS et de ne pas utiliser les modes d'overclocking automatique, ainsi que les modes de "boost" du processeur et de la carte graphique. Bien que les performances ne soient pas trop impactées, vous gagnerez en consommation d'énergie, en température et en silence de fonctionnement. | |||

N'hésitez pas à demander de l'aide sur notre forum si nécessaire. | |||

=== Au minimum | === Au minimum === | ||

* Processeur 4 cœurs/ | * Processeur 4 cœurs/4 threads | ||

* Un bon refroidissement | * Un bon refroidissement | ||

* 16 Go de Mémoire (RAM) | * 16 Go de Mémoire (RAM) | ||

* | * 100 Go de stockage disponible (les modèles prennent beaucoup de place) | ||

=== Conseillé | === Conseillé === | ||

* Processeur | * Processeur 6 cœurs/12 threads | ||

* | * 32, voire 64 Go de Mémoire (RAM) | ||

* | * 500 Go de stockage (NVME de préférence) | ||

=== En option | === En option === | ||

* Carte graphique supportant le GPGPU | * Carte graphique : | ||

* Un | ** supportant le [https://fr.wikipedia.org/wiki/General-Purpose_Processing_on_Graphics_Processing_Units GPGPU] | ||

*** [https://fr.wikipedia.org/wiki/CUDA CUDA] (Nvidia) | |||

*** [https://en.wikipedia.org/wiki/Rocm ROCM] (AMD) | |||

*** [https://en.wikipedia.org/wiki/SYCL SYCL] (INTEL) | |||

** | |||

* Un [https://fr.wikipedia.org/wiki/Puce_d%27acc%C3%A9l%C3%A9ration_de_r%C3%A9seaux_de_neurones NPU] | |||

* '''''Autres à suivre''''' | * '''''Autres à suivre''''' | ||

== Podman == | == Podman == | ||

=== Accélération CPU : === | === Installation === | ||

==== Accélération CPU (réalisé et testé sur AMD Ryzen ZEN3 5600G et 5800X) ==== | |||

On ouvrira les flux du pare-feu pour les accès distants sur les ports '''8082/TCP''' et '''3333/TCP''' : | |||

# firewall-cmd --add-port=8082/tcp --add-port=3333/tcp && firewall-cmd --runtime-to-permanent | |||

On installe <app>podman</app> si ce n'est pas déjà fait : | |||

# dnf install podman | |||

On récupère le container de <app>localai</app> pour processeur : | |||

$ podman pull docker.io/localai/localai:latest-aio-cpu | |||

On va créer un répertoire de stockage permanent (à modifier au besoin) : | |||

$ mkdir ~/projets/IA/models | |||

On va lui attribuer l'étiquette <app>SELinux</app> du dossier <path>/var/lib/containers</path> '''''(à revoir, car cela ne rend pas le dossier accessible pour les containers sur Fedora 40...)''''' : | |||

$ sudo semanage fcontext -a -e /var/lib/containers /home/'''UTILISATEUR'''/'''projets/IA/models''' | |||

On lance notre container : | |||

$ podman run -d '''--security-opt label=disable''' -p '''8082''':8080 -p '''3333''':3333 -e GRPC_PORT='''3333''' -e MODELS_PATH=/build/models -v '''~/projets/IA/models''':/build/models -e LOCALAI_THREADS='''6''' -e LOCALAI_CONTEXT_SIZE='''2048''' -e LOCALAI_UPLOAD_LIMIT='''100''' --name '''test''' docker.io/localai/localai:latest-aio-cpu | |||

Descriptif des options à modifier au besoin : | |||

* '''''LOCALAI_THREADS''''' : Indique le nombre de cœurs/threads à utiliser ('''de préférence n'utiliser que des cœurs physique'''). Ici pour un Ryzen 5 en 6 cœurs/12 threads ('''4 threads par défaut''') | |||

* '''''LOCALAI_CONTEXT_SIZE''''' (en Méga octets) : Définit la taille du contexte des modèles ('''512 Mo par défaut'''). Ici réglé sur '''2048 Mo''' | |||

* '''''LOCALAI_UPLOAD_LIMIT''''' (en Méga octets) : Limite de téléchargement ('''15 Mo par défaut'''). Ici réglé sur '''100 Mo''' | |||

==== Accélération CPU+GPU ROCM (AMD) : ==== | |||

===== Pré-requis : ===== | |||

'''''Il est nécessaire de s'assurer que le modèle utilisé ne soit pas plus grand que la taille de la VRAM que vous avez!''''' | |||

'''Exemple si vous avez ''16Go de VRAM'', vous pouvez utiliser des modèles allant jusqu'à "''14B''".''' | |||

'''Il est possible de limiter le nombre de token d'un modèle (par défaut 8192) pour consommer moins de Mémoire.''' | |||

'''Exemple :''' | |||

'''Pour un modèle de 24B vous pouvez limiter le nombre de token possible à 4092, ce qui n'utilisera que 14Go de RAM/VRAM.''' | |||

Des recherches sont en cours pour pouvoir utiliser plus de mémoire comme celle centrale dans le cas du calcul sur GPU. | |||

Pour connaitre la taille de la VRAM disponible : | |||

# dmesg | grep "amdgpu.*memory" | |||

Résultat par exemple : | |||

'''[ 6.700305] [drm] amdgpu: 16304M of VRAM memory ready''' | |||

[ 6.700308] [drm] amdgpu: 31829M of GTT memory ready. | |||

La branche "latest" (3.4.0 à lors de la rédaction de ce qui suit) ne permet pas totalement l'utilisation de l'accélération GPGPU. Il faut utiliser la branche de développement permanente "'''''master'''''". | |||

===== Procédure de mise en oeuvre : ===== | |||

On vas créer 2 répertoires locale pour enregistrer les modèles (cela évite de devoir les télécharger à chaque fois!). | |||

Libre à vous d'adapter selon vos besoins :<syntaxhighlight lang="sed"> | |||

$ mkdir ~/projets && mkdir ~/projets/AI && mkdir ~/projets/AI/models && mkdir ~/projets/AI/backends | |||

</syntaxhighlight>On peut lancer notre container : | |||

Branche Stable "Latest" :<syntaxhighlight lang="sed">podman run -d -ti --name local-ai -p 8085:8080 -e DEBUG=true --device=/dev/kfd --device=/dev/dri/renderD128 --security-opt label=disable -v ~/project/AI/models:/build/models -e MODELS_PATH=/build/models -v ~/project/AI/backends:/backends --security-opt=no-new-privileges -e LOCALAI_THREADS=4 -e LOCALAI_CONTEXT_SIZE=2048 -e LOCALAI_UPLOAD_LIMIT=1024 --group-add=video localai/localai:latest-gpu-hipblas</syntaxhighlight>Branche de développement permanente "'''Master'''" :<syntaxhighlight lang="sed">podman run -d -ti --name local-ai -p 8085:8080 -e DEBUG=true --device=/dev/kfd --device=/dev/dri/renderD128 --security-opt label=disable -v ~/project/AI/models:/build/models -e MODELS_PATH=/build/models -v ~/project/AI/backends:/backends --security-opt=no-new-privileges -e LOCALAI_THREADS=4 -e LOCALAI_CONTEXT_SIZE=2048 -e LOCALAI_UPLOAD_LIMIT=1024 --group-add=video localai/localai:master-gpu-hipblas</syntaxhighlight>Il faut activer le port (ici 8085/tcp pour l'exemple) ici temporairement : | |||

$ sudo firewall-cmd --add-port='''8085'''/tcp | |||

Pour rendre l'accès au port en permanence : | |||

$ sudo firewall-cmd --add-port='''8085'''/tcp --permanent | |||

==== Optimisation : ==== | |||

Vous pouvez en profiter pour modifier certaines variable à fin d'améliorer les performances à ajouter dans la commande de déploiement de votre container : | |||

Comme par exemple : | |||

TORCH_ROCM_AOTRITON_ENABLE_EXPERIMENTAL='''1''' | |||

===== Ne pas cumuler les modèles dans la VRAM : ===== | |||

<blockquote>'''''Si vous utilisez le menu "Talk" pour intéragir avec vos modèles d'IA à l'aide de l'interaction vocale, voir d'autres qui nécessite plus d'un modèle à la fois.''''' | |||

'''''Dans ce cas il faut utiliser les recommendations de la sectuib "Manuel" pour stopper au besoin les modèles charger en mémoire!'''''</blockquote> | |||

====== Manuel : ====== | |||

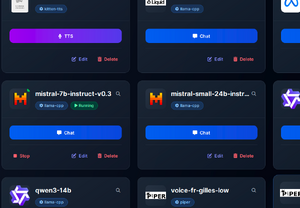

Vous pouvez soit stopper les modèles sur la page web d'accueil ("'''home'''"), il suffit de cliquer sur le bouton "Stop" sur la case du modèle : | |||

[[Fichier:Visualisation pour stopper un modèle.png|centré|vignette]] | |||

====== Automatiquement : ====== | |||

Pour n'utiliser qu'un modèle à la fois (à voir si il est possible de configurer un nombre limité de modèles en VRAM...) : | |||

<code>GPU_MAX_HW_QUEUES='''1'''</code> | |||

Et pour que ce soit remplacer automatiquement par un autre : | |||

SINGLE_ACTIVE_BACKEND='''true''' | |||

D'autres doivent exister, je les rajouterais ici. | |||

Cela peut donner la commande suivante par exemple :<syntaxhighlight lang="sed"> | |||

podman run -d -ti \ | |||

--name local-ai-gpu \ | |||

-p 8085:8080 \ | |||

-e DEBUG=true \ | |||

-e GPU_TARGETS=gfx1201 --device=/dev/kfd --device=/dev/dri/renderD128 \ | |||

--security-opt label=disable --security-opt=no-new-privileges \ | |||

-v ~/project/AI/models:/build/models -e MODELS_PATH=/build/models \ | |||

-v ~/project/AI/models/backends-1:/backends \ | |||

-v ~/project/AI/models/backends-1:/usr/share/localai/backends \ | |||

-e LOCALAI_THREADS=8 -e LOCALAI_CONTEXT_SIZE=1024 -e LOCALAI_UPLOAD_LIMIT=2048 \ | |||

-e SINGLE_ACTIVE_BACKEND=true -e TORCH_ROCM_AOTRITON_ENABLE_EXPERIMENTAL=1 -e GPU_MAX_HW_QUEUES=1 --group-add=video \ | |||

quay.io/go-skynet/local-ai:master-gpu-hipblas | |||

</syntaxhighlight> | |||

===== Téléchargement des "backends" : ===== | |||

Ici on utilisera principalement ceux fait pour "rocm" : | |||

Sur l'onglet "'''Backends'''" télécharger : | |||

* rocm-vllm | |||

* rocm-llama-cpp | |||

* rocm-rerankers | |||

* <s>''rocm-whisper (NON DISPONIBLE POUR LE MOMENT)''</s> | |||

* rocm-transformers | |||

* rocm-diffusers | |||

* rocm-kokoro | |||

* rocm-coqui | |||

* rocm-bark | |||

Certains choix peuvent ne pas fonctionner, comme les modèles '''stablediffusion''' qui n'ont pas de backend disponible pour rocm. | |||

Pour la génération d'images le modèle '''dreamcatcher''' fonctionne, mais sera limité au 512*512 pixel pour la taille de l'image. | |||

Les modèles de conversations sont en cours de test. | |||

La transcription texte vers audio fonctionne très bien. | |||

Les conversations audio sont en cours de test, car il manque des '''templates''' pour installer '''wisper.''' | |||

'''''A SUIVRE...''''' | |||

==== Accélération CPU+GPU VULKAN (En développement) : ==== | |||

<blockquote>'''''ATTENTION! Actuellement cela ne fonctionne pas avec les pilotes vulkan libre.''''' '''''Un incident et à ouvrir coté "Localai", si cela n'est pas déjà fait, pour voir si c'est un problème interne ou si il manque quelque chose.''''' | |||

En test avec la version de développement : '''''quay.io/go-skynet/local-ai:master-gpu-vulkan'''''</blockquote><syntaxhighlight lang="sed"> | |||

$ mkdir ~/projets && mkdir ~/projets/AI && mkdir ~/projets/AI/models && mkdir ~/projets/AI/backends | |||

</syntaxhighlight><syntaxhighlight lang="sed">podman run -d -ti --name local-ai-vulkan -p 8086:8080 -e DEBUG=true --security-opt label=disable -v ~/project/AI/models:/build/models -e MODELS_PATH=/build/models -v ~/project/AI/backends:/backends --security-opt=no-new-privileges -e LOCALAI_THREADS=4 -e LOCALAI_CONTEXT_SIZE=2048 -e LOCALAI_UPLOAD_LIMIT=1024 localai/localai:latest-gpu-vulkan</syntaxhighlight>Il faut activer le port (ici 8086/tcp pour l'exemple) ici temporairement : | |||

$ sudo firewall-cmd --add-port='''8086'''/tcp | |||

Pour rendre l'accès au port en permanence : | |||

$ sudo firewall-cmd --add-port='''8086'''/tcp --permanent | |||

===== Téléchargement des "backends" : ===== | |||

Ici on utilisera principalement ceux fait pour "Vulkan" : | |||

* vulkan-llama-cpp | |||

* vulkan-whisper | |||

* vulkan-stablediffusion-ggml | |||

==== Accélération CPU+GPU CUDA (NVIDIA) : ==== | |||

<blockquote>'''''Recherche volontaires étant équipé de cartes graphique NVIDIA supportant le CUDA!'''''</blockquote>Repris de la doc officiel : https://github.com/mudler/LocalAI | |||

Il est nécessaire d'installer le pilote propriétaire NVIDIA et CUDA avant : | |||

[[Carte graphique NVIDIA : installation des pilotes propriétaires]] et [[Cuda]] '''''(un peu obsolète comme doc...)''''' | |||

===== CUDA 12.0 ===== | |||

$ podman run -ti --name local-ai -p '''8080''':8080 --gpus all localai/localai:'''latest-gpu-nvidia-cuda-12''' | |||

===== CUDA 11.7 ===== | |||

$ podman run -ti --name local-ai -p '''8080''':8080 --gpus all localai/localai:'''latest-gpu-nvidia-cuda-11''' | |||

===== NVIDIA Jetson (L4T) ARM64 ===== | |||

$ podman run -ti --name local-ai -p '''8080''':8080 --gpus all localai/localai:'''latest-nvidia-l4t-arm64''' | |||

===== Téléchargement des "backends" : ===== | |||

Ici on utilisera principalement ceux fait pour "'''CUDA'''" : | |||

Sur l'onglet "'''Backends'''" télécharger selon votre version de CUDA (liste incomplète) : | |||

* cuda11-llama-cpp | |||

* cuda12-llama-cpp | |||

* cuda11-whisper | |||

* cuda12-whisper | |||

* cuda11-stablediffusion-ggml | |||

* cuda12-stablediffusion-ggml | |||

* cuda12-vllm | |||

* cuda12-rfdetr | |||

* cuda11-rerankers | |||

* etc... | |||

==== Accélération CPU+GPU SYCL (INTEL) : ==== | |||

<blockquote>'''''Recherche volontaires étant équipé de cartes graphique INTEL supportant le SYCL!'''''</blockquote>Repris de la doc officiel : https://github.com/mudler/LocalAI | |||

$ podman run -ti --name local-ai -p '''8080''':8080 --device=/dev/dri/card1 --device=/dev/dri/renderD128 localai/localai:latest-gpu-intel | |||

===== Téléchargement des "backends" : ===== | |||

Ici on utilisera principalement ceux fait pour "Intel-sycl" : | |||

Faire attention à la précision désiré ('''F32''' et ou '''F16''') : | |||

* intel-sycl-f32-llama-cpp | |||

* intel-sycl-f16-llama-cpp | |||

* intel-sycl-f32-whisper | |||

* intel-sycl-f16-whisper | |||

* intel-sycl-f32-stablediffusion-ggml | |||

* intel-sycl-f16-stablediffusion-ggml | |||

=== Utilisation : === | |||

==== Par l'interface graphique Web : ==== | |||

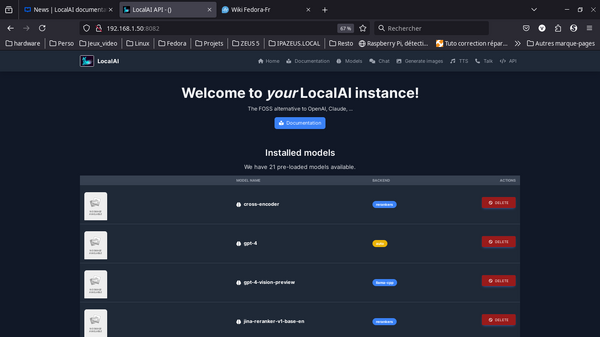

Pour accéder à l'interface graphique depuis un navigateur Web, il faut utiliser le lien : | |||

http://<IPmachine>:8082 | |||

ou | |||

http://localhost:8082 | |||

Il est nécessaire de bien sélectionner son modèle avant de l'utiliser (exemple : génération d'image avec "stable diffusion", etc) | |||

===== Accueil ===== | |||

[[Fichier:Accueil-WebUI-LocalAI.png|centré|vignette|600px]] | |||

===== Models ===== | |||

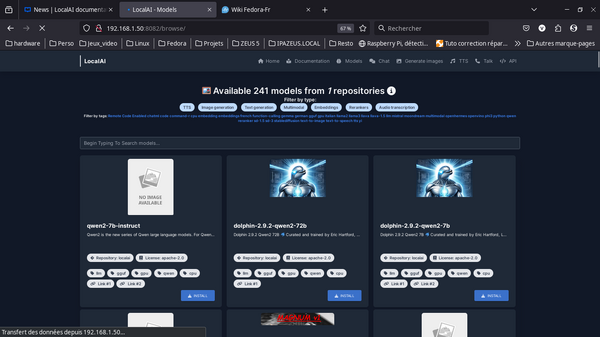

La liste des modèles peut être consultée ('''en anglais''') soit sur cette page, soit sur le site : https://localai.io/gallery.html . | |||

Vous en avez beaucoup de disponibles, censurées ou non. Il faut consulter le descriptif en anglais pour savoir si cela vous convient. | |||

Il y en a d'autres à installer manuellement, voir pour cela sur le site de LocalAI. | |||

[[Fichier:Models-WebUI-LocalAI.png|centré|vignette|600px]] | |||

===== Chat ===== | |||

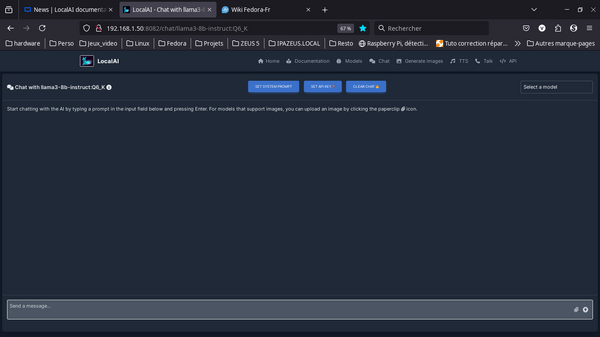

Il faut choisir le modèle pour pouvoir converser avec ; la liste ne fait pas la distinction. | |||

Exemple de modèles '''"GPT4" (par défaut)''' ou '''llama3-8b-instruct''' ('''à installer''', bon rapport performance/qualité dans les interactions). | |||

[[Fichier:Tchat-WebUI-LocalAI.png|centré|vignette|600px]] | |||

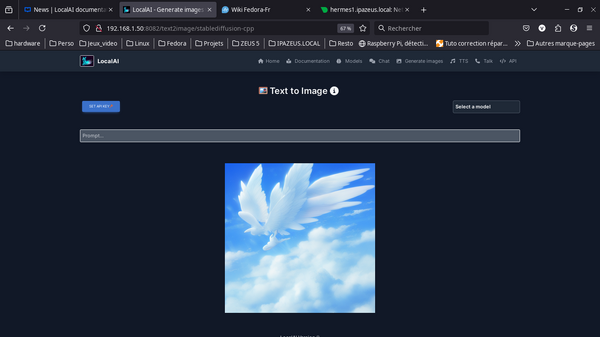

===== Generate images ===== | |||

[[Fichier:Images-WebUI-LocalAI.png|centré|vignette|600px|Modèle utilisé "stablediffusion"]] | |||

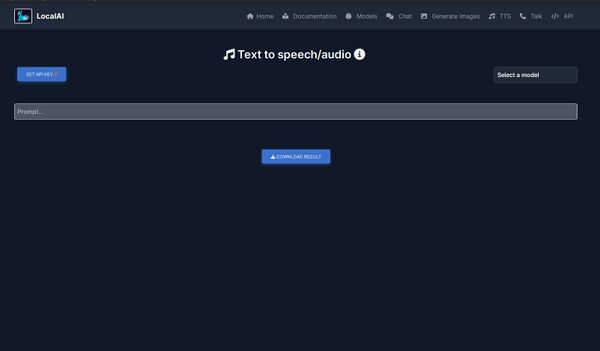

===== TTS ===== | |||

[[Fichier:LocalAI TTS.jpg|centré|vignette|600px|Modèle utilisé "voice-fr-gilles-low"]] | |||

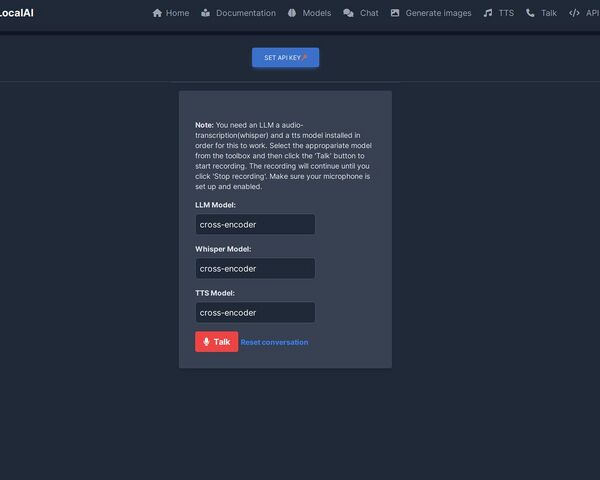

===== Talk ===== | |||

[[Fichier:LocalAI Talk.jpg|centré|vignette|600px]] | |||

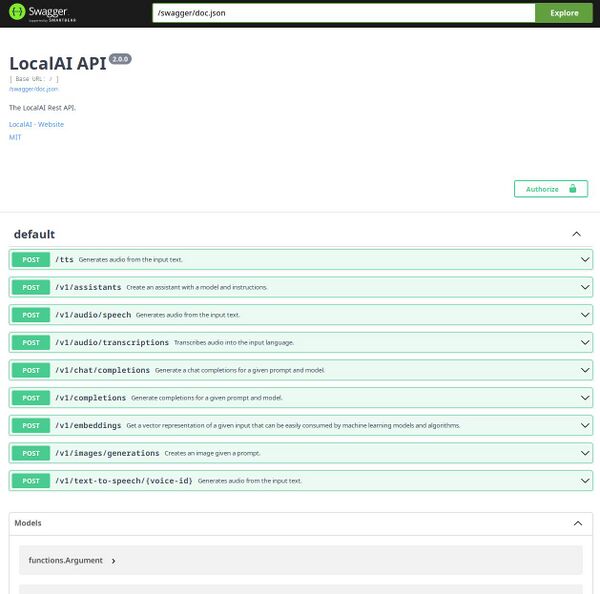

===== </>API ===== | |||

[[Fichier:LocalAI API.jpg|centré|vignette|600px]] | |||

==== En ligne de commande ==== | |||

Voici quelques exemples et résultats selon les cas d'utilisation. Les exemples sont généralement tirés de ceux de "localAI" avec les liens directs. | |||

La liste des modèles installés disponibles s'obtient avec : | |||

$ curl http://'''<IP-Machine>''':'''8082'''/v1/models | |||

===== Chat ===== | |||

Exemple : | |||

$ curl http://'''<IP-Machine>''':'''8082'''/v1/chat/completions -H "Content-Type: application/json" -d '{ | |||

"model": "'''llama3-8b-instruct'''", | |||

"messages": [{"role": "user", "content": "'''Salut, comment vas tu?'''"}], | |||

"temperature": '''0.1''' | |||

}' | |||

Réponse : | |||

{"created":1720598309,"object":"chat.completion","id":"'''xxxxxxx-a24f-xxxxxxx-a0de-xxxxxxxxxdeb'''","model":"'''llama3-8b-instruct'''","choices":[{"index":0,"finish_reason":"stop","message":{"role":"assistant","content":"'''''Bonjour ! Je suis un modèle de langage artificiel, donc je n'ai pas d'état d'esprit ou d'émotions comme les humains. Je suis juste là pour discuter et répondre à vos questions ! Comment puis-je vous aider aujourd'hui ?'''''<nowiki>"}}],"usage":{"prompt_tokens":19,"completion_tokens":58,"total_tokens":77}</nowiki> | |||

Plus d'explications ici : https://localai.io/features/text-generation/ | |||

===== Génération d'images ===== | |||

Le générateur d'image par défaut est limité au 512x512px max. | |||

Exemple : | |||

$ curl http://'''<IP-Machine>''':'''8082'''/v1/images/generations -H "Content-Type: application/json" -d '{ | |||

"prompt": "'''A cute baby sea otter'''", | |||

"size": "'''256x256'''" | |||

}' | |||

Retourne : | |||

{"created":'''1724418751''',"id":"xxxxxxx-c8d9-xxxxx-909b-xxxxxxx","data":[{"embedding":null,"index":0,"url":"http://'''<IP-Machine>''':'''8082'''/generated-images/'''b641977059781'''<nowiki>.png"}], | |||

"usage":{"prompt_tokens":0,"completion_tokens":0,"total_tokens":0}}</nowiki> | |||

[[Fichier:ImageiA.png|600px|centré|vignette]] | |||

Plus d'explications ici : https://localai.io/features/image-generation/ | |||

===== TTS ===== | |||

Pour transcrire du texte en Audio (il est possible que <cmd>curl</cmd> puisse avoir besoin d'avoir l'option ''output'' pour créer la sortie vers un fichier par exemple) | |||

$ curl http://'''<IP-Machine>''':'''8082'''/tts -H "Content-Type: application/json" -d '{ | |||

"input": "'''Hello world'''", | |||

"model": "tts-1" | |||

}' | |||

Plus d'explications ici : https://localai.io/features/text-to-audio/ | |||

===== Talk ===== | |||

<code>$ curl http://'''<IP-Machine>''':'''8082'''/v1/audio/transcriptions -H "Content-Type: multipart/form-data" -F file="@<FILE_PATH>" -F model="<MODEL_NAME>"</code> | |||

Plus d'explications ici : https://localai.io/features/audio-to-text/ | |||

===== GPT Vision ===== | |||

Permet de décrire une image (à confirmer pour une vidéo et autres ?) : | |||

Exemple avec le modèle "'''gpt-4-vision-preview'''" (d'autres sont à installer) : | |||

curl http://'''<IP-Machine>:8082'''/v1/chat/completions -H "Content-Type: application/json" -d '{ | |||

"model": "'''gpt-4-vision-preview'''", | |||

"messages": [{"role": "user", "content": [{"type":"text", "text": "'''What is in the image?'''"}, {"type": "image_url", "image_url": {"url": "'''<nowiki>https://upload.wikimedia.org/wikipedia/commons/thumb/d/dd/Gfp-wisconsin-madison-the-nature-boardwalk.jpg/2560px-Gfp-wisconsin-madison-the-nature-boardwalk.jpg</nowiki>'''<nowiki>" }}], "temperature": 0.9}]}'</nowiki> | |||

{"created":'''1724576857''',"object":"chat.completion","id":"'''xxxx-xxxx-xxxxx-xxxx-xxxxxx'''","model":"'''gpt-4-vision-preview'''","choices":[{"index":0,"finish_reason":"stop","message":{"role":"assistant","content":"'''The image features a wooden path or boardwalk that is surrounded by tall grass, flowers, and weeds on both sides. The boardwalk is located in a rural marsh or grassy plain, with clouds visible in the sky above.'''<nowiki>\u003c/s\u003e"}}],"usage":{"prompt_tokens":1,"completion_tokens":49,"total_tokens":50}}</nowiki> | |||

Plus d'explications ici : https://localai.io/features/gpt-vision/ | |||

===== Avec Nextcloud ===== | |||

===== Installation des applications nécessaires ===== | |||

Celles-ci sont disponibles sur la boutique <app>Nextcloud</app> : | |||

* Intégration -> Nextcloud Assistant | |||

* Intégration -> OpenAI and LocalAI integration | |||

===== Configurations ===== | |||

====== Coté Personnel ====== | |||

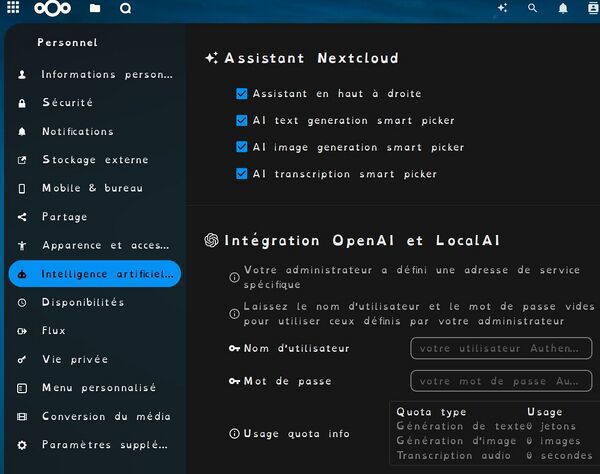

Dans "'''Paramètres d'administration'''" -> "'''Intelligence artificielle'''" activer ou non les options disponibles : | |||

[[Fichier:Copie d'écran 20240825 102732.jpg|600px|centré|vignette]] | |||

====== Coté Administration ====== | |||

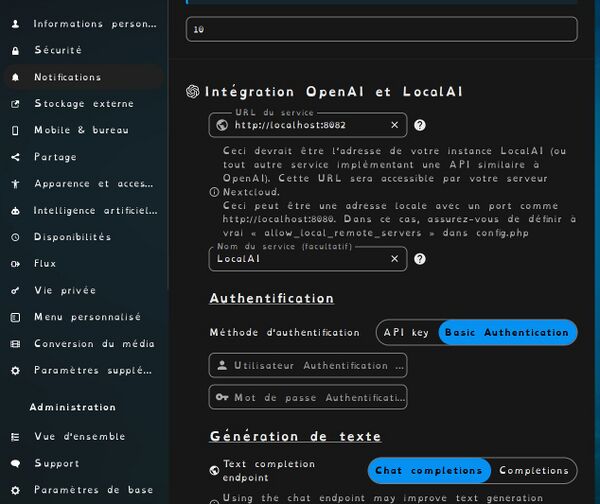

Dans "'''Paramètres d'administration'''" -> "'''Administration'''" -> "'''Intelligence artificielle'''"->"'''Intégration OpenAI et LocalAI'''" | |||

Rentrer l'URL de votre service IA (ici '''localhost''', n'oublier pas de rajouter la condition <cmd>allow_local_remote_servers</cmd> à <cmd>true</cmd> dans votre fichier de de configuration de <app>Nextcloud</app> <cmd>config.php</cmd>) : | |||

[[Fichier:Copie d'écran 20240825 104709.jpg|600px|centré|vignette]] | |||

''A savoir qu'il y avait une option pour définir le modèle à utiliser. Mais cela semble avoir disparu... Sans doute qu'ils vont rajouter le choix selon ce que l'on cherche à faire, tchat/traducteur, générateur d'images, texte vers voix/voix vers texte, etc).'' | |||

=== Mise à jour des images === | |||

Toutes les notes des mises à jour sont disponibles ici https://github.com/mudler/LocalAI/releases . | |||

Il suffit simplement de supprimer l'instance en cours et de refaire un "pull" de l'image puis de relancer notre container. | |||

===== Suppression ===== | |||

$ podman rm -f '''test''' | |||

===== Mise à jour de l'image ===== | |||

$ podman pull '''docker.io/localai/localai:latest-aio-cpu''' | |||

===== Relance du container ===== | |||

$ podman run -d --security-opt label=disable -p '''8082''':8080 -p '''3333''':3333 -e GRPC_PORT='''3333''' -e MODELS_PATH=/build/models -v '''~/projets/IA/models:/build/models''' -e LOCALAI_THREADS='''6''' -e LOCALAI_CONTEXT_SIZE='''2048''' -e LOCALAI_UPLOAD_LIMIT='''100''' --name '''test''' docker.io/localai/localai:latest-aio-cpu | |||

=== Pour aller plus loin === | |||

==== Création d'un service localai-latest systemd : (''ÉBAUCHE!!!!! NE PAS UTILISER POUR LE MOMENT!'') ==== | |||

Nous pouvons créer un service qui se mettra à jour automatiquement avec la dernière version de localai : | |||

On ajoutera dans notre ".bashrc" : | |||

export XDG_RUNTIME_DIR="/run/user/$UID" | |||

Il faut relancer la session pour que cela soit prit en compte. | |||

Nous allons créer un container en tant que service ici "'''test'''" : | |||

$ podman generate systemd --new --files --name '''test''' | |||

Puis on l'active : | |||

<code>$ systemctl --user enable --now '''container-test.service'''</code> | |||

Pour la mise à jour, il suffit de "puller" l'image et de lancer ('''''Revoir le chemin!!!''''') : | |||

$ cat '''~/.config/systemd/users/test.container''' | |||

[Container] | |||

Image='''quay.io/go-skynet/local-ai:latest-aio-cpu''' | |||

Exec=sleep infinity | |||

AutoUpdate=registry | |||

$ systemctl --user daemon-reload | |||

$ systemctl --user enable podman-auto-update | |||

<code>$ systemctl --user restart '''container-test.service'''</code> | |||

Pour vérifier si la nouvelle image est disponible: | |||

$ podman auto-update --dry-run --format "{{.Image}} {{.Updated}}" | |||

$ podman container list | |||

Mettre à jour le service : | |||

$ podman auto-update | |||

== Kubernetes : (Ébauche) == | |||

Vous pouvez vous baser sur la documentation disponible ici pour la création de votre infra kubernetes : [[Infrastructure KVM/QEMU+Kubernetes+CEPH]]<blockquote>''Nous utiliserons un espace de stockage sur une instance "'''CEPH'''", n'hésitez pas à modifier cette partie si nécessaire (avec un espace de stockage locale par exemple, sachant qu'il faut qu'il soit identique, mais aussi de taille importante, sur chaque machine!)''</blockquote> | |||

=== Noeuds Fédérés : === | |||

Nous mettons en place notre assistant '''LOCALAI''' en mode "noeuds fédérés". Pour cela nous allons utiliser les "Statefulls" qui permettent, grace à la définition de modèles, de créer des répliquas identique. | |||

Ici nous aurons donc 1 container de "Répartition de charge" ("LoadBalancer") et 2 containers de "partage" (share). | |||

Avant tout nous allons utiliser le service "secret" pour crypter et sécuriser notre token (à définir) : | |||

Création de l'espace de nom "local-ai" ("namespace") : | |||

cat <<CONFIG > '''~/localai-namespace.yaml''' | |||

--- | |||

apiVersion: v2 | |||

kind: Namespace | |||

metadata: | |||

name: '''local-ai''' | |||

--- | |||

CONFIG" | |||

done | |||

Puis notre service : | |||

cat <<CONFIG > '''~/localai-service.yaml''' | |||

--- | |||

apiVersion: v1 | |||

kind: Service | |||

metadata: | |||

name: '''local-ai''' | |||

namespace: '''local-ai''' | |||

spec: | |||

selector: | |||

app: '''local-ai''' | |||

type: LoadBalancer | |||

ports: | |||

- protocol: TCP | |||

port: 8080 | |||

targetPort: 8080 | |||

nodePort: '''30018''' | |||

--- | |||

CONFIG" | |||

done | |||

Notre modèle de "loadbalancer": | |||

$ cat <<CONFIG > '''~/localai-loadbalancer.yaml''' | |||

--- | |||

Et nos "share" : | |||

$ cat <<CONFIG > '''~/localai.yaml''' | |||

--- | |||

apiVersion: apps/v1 | |||

kind: StatefulSet | |||

metadata: | |||

name: '''local-ai''' | |||

namespace: '''local-ai''' | |||

labels: | |||

app: '''local-ai''' | |||

spec: | |||

serviceName: "'''localai-service'''" | |||

replicas: '''2''' | |||

selector: | |||

matchLabels: | |||

app: '''local-ai''' | |||

template: | |||

metadata: | |||

labels: | |||

app: '''local-ai''' | |||

name: '''local-ai''' | |||

spec: | |||

containers: | |||

- name: local-ai | |||

image: quay.io/go-skynet/local-ai:latest-aio-cpu | |||

imagePullPolicy: IfNotPresent | |||

- args: | |||

- --federated | |||

- --p2p | |||

env: | |||

- name: '''MODELS_PATH''' | |||

value: '''/build/models''' | |||

- name: LOCALAI_THREADS | |||

value: "'''4'''" | |||

'''-''' name: LOCALAI_CONTEXT_SIZE | |||

value: "'''4096'''" | |||

- name: TOKEN | |||

valueFrom: | |||

secretKeyRef: | |||

name: '''ai-secret''' | |||

key: '''aitoken''' | |||

securityContext: | |||

runAsUser: 0 | |||

privileged: true | |||

volumeMounts: | |||

- name: '''localai-volume''' | |||

mountPath: /build/models | |||

volumeClaimTemplates: | |||

- metadata: | |||

name: '''localai-volume''' | |||

spec: | |||

accessModes: | |||

- ReadWriteOnce | |||

volumeMode: Filesystem | |||

resources: | |||

requests: | |||

storage: '''50Gi''' | |||

storageClassName: '''csi-rbd-sc''' | |||

--- | |||

CONFIG" | |||

done | |||

Nous créons et ajoutons notre "'''Token'''" dans un "secret" dédié ici "'''ai-secret'''" : | |||

Pour cela nous allons lancer tempairement un container "LOCALAI" avec Podman et l'option "--p2p" : | |||

podman run -d '''--security-opt label=disable''' -p '''8082''':8080 -p '''3333''':3333 -e GRPC_PORT='''3333''' -e MODELS_PATH=/build/models -v '''~/projets/IA/models''':/build/models -e LOCALAI_THREADS='''6''' -e LOCALAI_CONTEXT_SIZE='''2048''' -e LOCALAI_UPLOAD_LIMIT='''100''' --name '''test''' docker.io/localai/localai:latest-aio-cpu --p2p | |||

$ kubectl create secret generic '''ai-secret''' -n '''local-ai''' --from-literal=aitoken='''NOTRETOKEN''' | |||

A savoir que plus vous ajouter de réplicas, plus l'espace de stockage nécessaire s'agrandit ('''''à voir si l'on peut utiliser le même vu que les modèles doivent être identique'''''). Ici nous avons 2 réplicas, donc 2x50Go mis à disposition de l'installation des modèles. | |||

==== Ajout de "worker" : ==== | |||

== Conseils == | |||

Voici une liste de quelques conseils à suivre pour que l'expérience se passe bien ('''à étoffer'''). | |||

# Ne surtout pas oublier que '''vous êtes responsables''' dans tous les cas de figure. Que ce soit généré par IA ou non ! | |||

# Ne jamais croire à une fiabilité à 100% sans vérification par d'autres sources ! | |||

# Bien se dire que c'est considéré comme une "'''AIDE'''" et non pas comme une solution de remplacement ! | |||

# Il faut bien choisir son modèle selon le besoin sachant que : | |||

## Certains demandent beaucoup de puissance machines (Exemple : llma3-70b-instruct) | |||

## Qu'il y en a des censurés et non censurés (à vos risques et périls) | |||

## Certains sont uniquement adaptés à un type de besoin bien particulier | |||

## Utiliser les "'''API'''" et la ligne de commande si vous voulez aller plus loin que ce que propose l'interface | |||

# Ne pas hésitez à : | |||

## Relire les réponses et corriger si besoin (conseil un peu trop souvent oublié même chez les "PRO") | |||

## Vérifier le rendu des images | |||

### Affiner les paramètres de la demande | |||

### Ne pas hésiter à retoucher | |||

## Vérifiez la cohérence Texte/Audio et Audio/Texte | |||

== Astuces de configuration (En cours de rédaction): == | |||

=== Configuration Form : === | |||

* Model Name : Identificateur unique pour du modèle | |||

* Backend : Moteur à utiliser (par exemple : '''llama-cpp,''' '''transformers''', '''diffusers''', '''whisper''', '''piper''', bark-cpp, vllm, rerankers, exllama2, faster-whisper, stablediffusion-ggml) | |||

* Model File/Path : Emplacement du modèle (locale ou à distance) | |||

* Description : Déscription du modèle (facultatif) | |||

* Usage Instructions : Instruction d'usage (facultatif) | |||

=== Model Parameters : === | |||

* Temperature : Contrôle les caractères aléatoire | |||

** "Réglage de '''0<->2'''" | |||

** plus c'est '''haut''' plus c'est '''imprécis''' | |||

** plus c'est bas plus c'est précis. | |||

** Conseil : régler entre 0.7 et 0.9 | |||

* Top P : Échantillonnage du noyau | |||

* Top K : | |||

* Max Tokens : Limite le nombre de tokens utilisé, cela peut induire des coupures dans les réponses si le maximum est dépassé. A réglé selon le besoin. | |||

** 0 : désactive la limite maximum | |||

** Exemple de limites : | |||

*** 1->2 : permet d'avoir 2 tokens dans la réponse : | |||

**** Avec un Résultat correct : "Bonjour Je m'appel Jean" donne en réponse "Bonjour Jean" | |||

**** Résultat tronqué si dépassé : "Bonjour je m'appel Jean MiMi" donne en réponse "Bonjour Jean M." | |||

*** .... | |||

* Seed : | |||

** Valeur basse : | |||

** Valeur haute : | |||

* Repeat Penalty : | |||

** | |||

* Frequency Penalty : | |||

** | |||

* Presence Penalty : | |||

** | |||

* N (Number of results) : Nombre de résultat affiché à l'écran | |||

** Valeur basse : | |||

** Valeur haute : | |||

* Echo (option) | |||

** | |||

* Ignore EOS (option) : | |||

* '''Repeat Last N :''' Garde en mémoire un nombre défini de tokens pour évité les répétitions. | |||

** '''Réglage de :''' 0 à 1024 | |||

** Plus le chiffre est grand plus grand est la consomation Mmmoire. et plus long sont les traitements des réponses. | |||

* N Keep | |||

* TFZ (Tail Free Sampling) | |||

* Typical P | |||

* Negative Prompt : Indiquer ce que vous ne voulez pas voir dans vos résultats | |||

* RoPE Freq Base : | |||

* RoPE Freq Scale : | |||

* Negative Prompt Scale : Nombre de fois que vous appliquez votre règle "Negative prompt". | |||

* CLIP Skip : | |||

* Language : | |||

* Translate : | |||

* Tokenizer : | |||

=== Advanced Configuration : === | |||

* Use F16 : Précision sur 16 bits | |||

* Threads : Nombre de Thread, se limiter aux coeurs physique du processeur est conseillé. Déduire un coeur pour ne pas saturer les ressources systèmes et entrainer des bloquages. | |||

* Debug Mode : Active/désactive le mode débogue. Augmente la verbosité des logs quand il est actif. | |||

* Embeddings Mode : | |||

* Enable CUDA : Non nécessaire si utilisation des backends ROCM/SYSCL | |||

* Memory Mapping : | |||

* Memory Lock : Bloque le modèle en mémoire | |||

* Low VRAM Mode : Force le modèle à moins consommer de VRAM (mémoire graphique) | |||

* NUMA : '''non uniform memory access''' ou '''non uniform memory architecture (''accès mémoire non uniforme'' et ''architecture mémoire non uniforme)''''' | |||

* Context Size : Défini la limite du context utilisé. | |||

** Limité à la taille du modèle | |||

*** Permet l'utilisation du modèle au maximum tant que la VRAM/RAM disponible n'est pas remplit à 100% | |||

** Plus petit que la taille du modèle : Permet l'utilisation de modèles plus grand sur des systèmes n'ayant pas assez de VRAM/RAM | |||

*** Exemple 1 : En cas d'utilisation d'un modèle 20B, un réglage de 8128 permet d'utiliser le modèle avec 8Go de VRAM/RAM | |||

*** Exemple 2 : ..... | |||

** Plus grand que la taille du modèle : | |||

*** | |||

* GPU Layers | |||

* Reranking | |||

=== LLM Configuration : === | |||

* System Prompt | |||

* Tensor Split | |||

* Main GPU | |||

* Mirostat : C'est une méthode de [https://en.wikipedia.org/wiki/Adaptive_sampling sampling adaptative] ou échantillonnage adaptatif, est plus efficace que le Top_P et Top_K, car il adapte le taux d'échantillonnage automatiquement en permanence. Nécéssite de désactiver Top_P/Top_K (Mettre "1" comme valeur) et les options de "Repeat" (Mettre "0" en valeur). | |||

** '''0''' : Désactivé. | |||

** '''1''' : Mirostat (algorithme original). | |||

** '''2''' : Mirostat 2.0 (algorithme amélioré, généralement préféré pour une convergence plus rapide) | |||

* Mirostat ETA : Permet le contrôle de la vitesse d'ajustement de l'option "Mirostat". Par défaut il est réglé à "0.1", plus la valeur est haute, plus vous augmenter les instabilités et oscillations dans les textes générés. Un réglage de "0.2" semble être un bon compromit. | |||

** Désactiver "Top_P" en le mettant à "1" | |||

** Désactiver "Top_K" en le mettant à "1" | |||

** Désactiver "Min_P" en le mettant à .... | |||

* Mirostat TAU : Permet d'ajuster l'[https://fr.wikipedia.org/wiki/Entropie_(thermodynamique) entropie] de Mirostat. | |||

** Valeurs Faible 2.0-3.0 = les textes générés sont plus cohérent | |||

** Valeur moyenne 4.0-5.0 = bon équilibre cohérence/diversité dans les textes générés | |||

** Valeur haute 6.0->+ = textes générés pouvant être moins cohérent, augmente la diversité/créativité | |||

* | |||

[[Catégorie:Rédaction en cours]] | [[Catégorie:Rédaction en cours]] | ||

[[Catégorie:Réseaux et Serveurs]] | [[Catégorie:Réseaux et Serveurs]] | ||

Dernière version du 16 novembre 2025 à 11:07

Article en cours de rédaction ou de modification !

Le présent article est actuellement en cours de rédaction ou de modification.

Adressez-vous à la personne en charge pour toute proposition ou modification.

| Aide Pour lire ce wiki convenablement, merci de lire la page suivante concernant les conventions de nommage. |

Introduction

Je vais vous présenter l'installation d'une instance pour bénéficier d'un assistant personnel basé sur des modèles neuronaux, disponibles librement ou sous certaines conditions, et qui peut être installé en local.

Pour cela, nous utiliserons LocalAI, qui est une API REST open source alternative à OpenAI :https://localai.io/

Vous pouvez déployer la solution directement sur votre système, dans un container Podman/Docker ou sur un cluster Kubernetes.

Cette documentation se concentrera sur l'installation dans des containers avec Podman : https://podman.io/

Nous aborderons également l'intégration avec votre serveur Nextcloud à partir de la version Hub 8 (29.x) : https://nextcloud.com/fr/

Nous n'utiliserons qu'une seule instance sur un simple nœud (une machine physique ou virtuelle), mais il est possible d'en utiliser plusieurs pour du calcul en parallèle

Présentation

LocalAI permet d'avoir une solution locale pour la mise à disposition et l’exploitation de modèles d’Intelligence Artificielle (IA ou AI en anglais) en local (pas de connexion Internet nécessaire), généralement libre et/ou avec quelques conditions.

Parmi les modèles et options proposés vous pouvez disposer :

- De tchats (Conversationnels + Traducteurs multi-lingues)

- De générateurs d'Images

- De convertisseurs Vidéo/Musique vers du Texte

- De convertisseurs Texte vers Voix

- Et bien d'autres possibilités présentes et à venir...

Pré-Requis

Nous vous conseillons de bien régler les paramètres de votre BIOS et de ne pas utiliser les modes d'overclocking automatique, ainsi que les modes de "boost" du processeur et de la carte graphique. Bien que les performances ne soient pas trop impactées, vous gagnerez en consommation d'énergie, en température et en silence de fonctionnement.

N'hésitez pas à demander de l'aide sur notre forum si nécessaire.

Au minimum

- Processeur 4 cœurs/4 threads

- Un bon refroidissement

- 16 Go de Mémoire (RAM)

- 100 Go de stockage disponible (les modèles prennent beaucoup de place)

Conseillé

- Processeur 6 cœurs/12 threads

- 32, voire 64 Go de Mémoire (RAM)

- 500 Go de stockage (NVME de préférence)

En option

Podman

Installation

Accélération CPU (réalisé et testé sur AMD Ryzen ZEN3 5600G et 5800X)

On ouvrira les flux du pare-feu pour les accès distants sur les ports 8082/TCP et 3333/TCP :

# firewall-cmd --add-port=8082/tcp --add-port=3333/tcp && firewall-cmd --runtime-to-permanent

On installe podman si ce n'est pas déjà fait :

# dnf install podman

On récupère le container de localai pour processeur :

$ podman pull docker.io/localai/localai:latest-aio-cpu

On va créer un répertoire de stockage permanent (à modifier au besoin) :

$ mkdir ~/projets/IA/models

On va lui attribuer l'étiquette SELinux du dossier /var/lib/containers (à revoir, car cela ne rend pas le dossier accessible pour les containers sur Fedora 40...) :

$ sudo semanage fcontext -a -e /var/lib/containers /home/UTILISATEUR/projets/IA/models

On lance notre container :

$ podman run -d --security-opt label=disable -p 8082:8080 -p 3333:3333 -e GRPC_PORT=3333 -e MODELS_PATH=/build/models -v ~/projets/IA/models:/build/models -e LOCALAI_THREADS=6 -e LOCALAI_CONTEXT_SIZE=2048 -e LOCALAI_UPLOAD_LIMIT=100 --name test docker.io/localai/localai:latest-aio-cpu

Descriptif des options à modifier au besoin :

- LOCALAI_THREADS : Indique le nombre de cœurs/threads à utiliser (de préférence n'utiliser que des cœurs physique). Ici pour un Ryzen 5 en 6 cœurs/12 threads (4 threads par défaut)

- LOCALAI_CONTEXT_SIZE (en Méga octets) : Définit la taille du contexte des modèles (512 Mo par défaut). Ici réglé sur 2048 Mo

- LOCALAI_UPLOAD_LIMIT (en Méga octets) : Limite de téléchargement (15 Mo par défaut). Ici réglé sur 100 Mo

Accélération CPU+GPU ROCM (AMD) :

Pré-requis :

Il est nécessaire de s'assurer que le modèle utilisé ne soit pas plus grand que la taille de la VRAM que vous avez!

Exemple si vous avez 16Go de VRAM, vous pouvez utiliser des modèles allant jusqu'à "14B".

Il est possible de limiter le nombre de token d'un modèle (par défaut 8192) pour consommer moins de Mémoire.

Exemple :

Pour un modèle de 24B vous pouvez limiter le nombre de token possible à 4092, ce qui n'utilisera que 14Go de RAM/VRAM.

Des recherches sont en cours pour pouvoir utiliser plus de mémoire comme celle centrale dans le cas du calcul sur GPU.

Pour connaitre la taille de la VRAM disponible :

# dmesg | grep "amdgpu.*memory"

Résultat par exemple :

[ 6.700305] [drm] amdgpu: 16304M of VRAM memory ready [ 6.700308] [drm] amdgpu: 31829M of GTT memory ready.

La branche "latest" (3.4.0 à lors de la rédaction de ce qui suit) ne permet pas totalement l'utilisation de l'accélération GPGPU. Il faut utiliser la branche de développement permanente "master".

Procédure de mise en oeuvre :

On vas créer 2 répertoires locale pour enregistrer les modèles (cela évite de devoir les télécharger à chaque fois!).

Libre à vous d'adapter selon vos besoins :

$ mkdir ~/projets && mkdir ~/projets/AI && mkdir ~/projets/AI/models && mkdir ~/projets/AI/backendsOn peut lancer notre container : Branche Stable "Latest" :

podman run -d -ti --name local-ai -p 8085:8080 -e DEBUG=true --device=/dev/kfd --device=/dev/dri/renderD128 --security-opt label=disable -v ~/project/AI/models:/build/models -e MODELS_PATH=/build/models -v ~/project/AI/backends:/backends --security-opt=no-new-privileges -e LOCALAI_THREADS=4 -e LOCALAI_CONTEXT_SIZE=2048 -e LOCALAI_UPLOAD_LIMIT=1024 --group-add=video localai/localai:latest-gpu-hipblasBranche de développement permanente "Master" :

podman run -d -ti --name local-ai -p 8085:8080 -e DEBUG=true --device=/dev/kfd --device=/dev/dri/renderD128 --security-opt label=disable -v ~/project/AI/models:/build/models -e MODELS_PATH=/build/models -v ~/project/AI/backends:/backends --security-opt=no-new-privileges -e LOCALAI_THREADS=4 -e LOCALAI_CONTEXT_SIZE=2048 -e LOCALAI_UPLOAD_LIMIT=1024 --group-add=video localai/localai:master-gpu-hipblasIl faut activer le port (ici 8085/tcp pour l'exemple) ici temporairement :

$ sudo firewall-cmd --add-port=8085/tcp

Pour rendre l'accès au port en permanence :

$ sudo firewall-cmd --add-port=8085/tcp --permanent

Optimisation :

Vous pouvez en profiter pour modifier certaines variable à fin d'améliorer les performances à ajouter dans la commande de déploiement de votre container :

Comme par exemple :

TORCH_ROCM_AOTRITON_ENABLE_EXPERIMENTAL=1

Ne pas cumuler les modèles dans la VRAM :

Si vous utilisez le menu "Talk" pour intéragir avec vos modèles d'IA à l'aide de l'interaction vocale, voir d'autres qui nécessite plus d'un modèle à la fois. Dans ce cas il faut utiliser les recommendations de la sectuib "Manuel" pour stopper au besoin les modèles charger en mémoire!

Manuel :

Vous pouvez soit stopper les modèles sur la page web d'accueil ("home"), il suffit de cliquer sur le bouton "Stop" sur la case du modèle :

Automatiquement :

Pour n'utiliser qu'un modèle à la fois (à voir si il est possible de configurer un nombre limité de modèles en VRAM...) :

GPU_MAX_HW_QUEUES=1

Et pour que ce soit remplacer automatiquement par un autre :

SINGLE_ACTIVE_BACKEND=true

D'autres doivent exister, je les rajouterais ici.

Cela peut donner la commande suivante par exemple :

podman run -d -ti \

--name local-ai-gpu \

-p 8085:8080 \

-e DEBUG=true \

-e GPU_TARGETS=gfx1201 --device=/dev/kfd --device=/dev/dri/renderD128 \

--security-opt label=disable --security-opt=no-new-privileges \

-v ~/project/AI/models:/build/models -e MODELS_PATH=/build/models \

-v ~/project/AI/models/backends-1:/backends \

-v ~/project/AI/models/backends-1:/usr/share/localai/backends \

-e LOCALAI_THREADS=8 -e LOCALAI_CONTEXT_SIZE=1024 -e LOCALAI_UPLOAD_LIMIT=2048 \

-e SINGLE_ACTIVE_BACKEND=true -e TORCH_ROCM_AOTRITON_ENABLE_EXPERIMENTAL=1 -e GPU_MAX_HW_QUEUES=1 --group-add=video \

quay.io/go-skynet/local-ai:master-gpu-hipblasTéléchargement des "backends" :

Ici on utilisera principalement ceux fait pour "rocm" :

Sur l'onglet "Backends" télécharger :

- rocm-vllm

- rocm-llama-cpp

- rocm-rerankers

rocm-whisper (NON DISPONIBLE POUR LE MOMENT)- rocm-transformers

- rocm-diffusers

- rocm-kokoro

- rocm-coqui

- rocm-bark

Certains choix peuvent ne pas fonctionner, comme les modèles stablediffusion qui n'ont pas de backend disponible pour rocm.

Pour la génération d'images le modèle dreamcatcher fonctionne, mais sera limité au 512*512 pixel pour la taille de l'image.

Les modèles de conversations sont en cours de test.

La transcription texte vers audio fonctionne très bien.

Les conversations audio sont en cours de test, car il manque des templates pour installer wisper.

A SUIVRE...

Accélération CPU+GPU VULKAN (En développement) :

ATTENTION! Actuellement cela ne fonctionne pas avec les pilotes vulkan libre. Un incident et à ouvrir coté "Localai", si cela n'est pas déjà fait, pour voir si c'est un problème interne ou si il manque quelque chose. En test avec la version de développement : quay.io/go-skynet/local-ai:master-gpu-vulkan

$ mkdir ~/projets && mkdir ~/projets/AI && mkdir ~/projets/AI/models && mkdir ~/projets/AI/backendspodman run -d -ti --name local-ai-vulkan -p 8086:8080 -e DEBUG=true --security-opt label=disable -v ~/project/AI/models:/build/models -e MODELS_PATH=/build/models -v ~/project/AI/backends:/backends --security-opt=no-new-privileges -e LOCALAI_THREADS=4 -e LOCALAI_CONTEXT_SIZE=2048 -e LOCALAI_UPLOAD_LIMIT=1024 localai/localai:latest-gpu-vulkanIl faut activer le port (ici 8086/tcp pour l'exemple) ici temporairement :

$ sudo firewall-cmd --add-port=8086/tcp

Pour rendre l'accès au port en permanence :

$ sudo firewall-cmd --add-port=8086/tcp --permanent

Téléchargement des "backends" :

Ici on utilisera principalement ceux fait pour "Vulkan" :

- vulkan-llama-cpp

- vulkan-whisper

- vulkan-stablediffusion-ggml

Accélération CPU+GPU CUDA (NVIDIA) :

Recherche volontaires étant équipé de cartes graphique NVIDIA supportant le CUDA!

Repris de la doc officiel : https://github.com/mudler/LocalAI

Il est nécessaire d'installer le pilote propriétaire NVIDIA et CUDA avant :

Carte graphique NVIDIA : installation des pilotes propriétaires et Cuda (un peu obsolète comme doc...)

CUDA 12.0

$ podman run -ti --name local-ai -p 8080:8080 --gpus all localai/localai:latest-gpu-nvidia-cuda-12

CUDA 11.7

$ podman run -ti --name local-ai -p 8080:8080 --gpus all localai/localai:latest-gpu-nvidia-cuda-11

NVIDIA Jetson (L4T) ARM64

$ podman run -ti --name local-ai -p 8080:8080 --gpus all localai/localai:latest-nvidia-l4t-arm64

Téléchargement des "backends" :

Ici on utilisera principalement ceux fait pour "CUDA" :

Sur l'onglet "Backends" télécharger selon votre version de CUDA (liste incomplète) :

- cuda11-llama-cpp

- cuda12-llama-cpp

- cuda11-whisper

- cuda12-whisper

- cuda11-stablediffusion-ggml

- cuda12-stablediffusion-ggml

- cuda12-vllm

- cuda12-rfdetr

- cuda11-rerankers

- etc...

Accélération CPU+GPU SYCL (INTEL) :

Recherche volontaires étant équipé de cartes graphique INTEL supportant le SYCL!

Repris de la doc officiel : https://github.com/mudler/LocalAI

$ podman run -ti --name local-ai -p 8080:8080 --device=/dev/dri/card1 --device=/dev/dri/renderD128 localai/localai:latest-gpu-intel

Téléchargement des "backends" :

Ici on utilisera principalement ceux fait pour "Intel-sycl" :

Faire attention à la précision désiré (F32 et ou F16) :

- intel-sycl-f32-llama-cpp

- intel-sycl-f16-llama-cpp

- intel-sycl-f32-whisper

- intel-sycl-f16-whisper

- intel-sycl-f32-stablediffusion-ggml

- intel-sycl-f16-stablediffusion-ggml

Utilisation :

Par l'interface graphique Web :

Pour accéder à l'interface graphique depuis un navigateur Web, il faut utiliser le lien :

http://<IPmachine>:8082

ou

http://localhost:8082

Il est nécessaire de bien sélectionner son modèle avant de l'utiliser (exemple : génération d'image avec "stable diffusion", etc)

Accueil

Models

La liste des modèles peut être consultée (en anglais) soit sur cette page, soit sur le site : https://localai.io/gallery.html .

Vous en avez beaucoup de disponibles, censurées ou non. Il faut consulter le descriptif en anglais pour savoir si cela vous convient.

Il y en a d'autres à installer manuellement, voir pour cela sur le site de LocalAI.

Chat

Il faut choisir le modèle pour pouvoir converser avec ; la liste ne fait pas la distinction.

Exemple de modèles "GPT4" (par défaut) ou llama3-8b-instruct (à installer, bon rapport performance/qualité dans les interactions).

Generate images

TTS

Talk

</>API

En ligne de commande

Voici quelques exemples et résultats selon les cas d'utilisation. Les exemples sont généralement tirés de ceux de "localAI" avec les liens directs.

La liste des modèles installés disponibles s'obtient avec :

$ curl http://<IP-Machine>:8082/v1/models

Chat

Exemple :

$ curl http://<IP-Machine>:8082/v1/chat/completions -H "Content-Type: application/json" -d '{

"model": "llama3-8b-instruct",

"messages": [{"role": "user", "content": "Salut, comment vas tu?"}],

"temperature": 0.1

}'

Réponse :

{"created":1720598309,"object":"chat.completion","id":"xxxxxxx-a24f-xxxxxxx-a0de-xxxxxxxxxdeb","model":"llama3-8b-instruct","choices":[{"index":0,"finish_reason":"stop","message":{"role":"assistant","content":"Bonjour ! Je suis un modèle de langage artificiel, donc je n'ai pas d'état d'esprit ou d'émotions comme les humains. Je suis juste là pour discuter et répondre à vos questions ! Comment puis-je vous aider aujourd'hui ?"}}],"usage":{"prompt_tokens":19,"completion_tokens":58,"total_tokens":77}

Plus d'explications ici : https://localai.io/features/text-generation/

Génération d'images

Le générateur d'image par défaut est limité au 512x512px max.

Exemple :

$ curl http://<IP-Machine>:8082/v1/images/generations -H "Content-Type: application/json" -d '{

"prompt": "A cute baby sea otter",

"size": "256x256"

}'

Retourne :

{"created":1724418751,"id":"xxxxxxx-c8d9-xxxxx-909b-xxxxxxx","data":[{"embedding":null,"index":0,"url":"http://<IP-Machine>:8082/generated-images/b641977059781.png"}],

"usage":{"prompt_tokens":0,"completion_tokens":0,"total_tokens":0}}

Plus d'explications ici : https://localai.io/features/image-generation/

TTS

Pour transcrire du texte en Audio (il est possible que curl puisse avoir besoin d'avoir l'option output pour créer la sortie vers un fichier par exemple)

$ curl http://<IP-Machine>:8082/tts -H "Content-Type: application/json" -d '{

"input": "Hello world",

"model": "tts-1"

}'

Plus d'explications ici : https://localai.io/features/text-to-audio/

Talk

$ curl http://<IP-Machine>:8082/v1/audio/transcriptions -H "Content-Type: multipart/form-data" -F file="@<FILE_PATH>" -F model="<MODEL_NAME>"

Plus d'explications ici : https://localai.io/features/audio-to-text/

GPT Vision

Permet de décrire une image (à confirmer pour une vidéo et autres ?) :

Exemple avec le modèle "gpt-4-vision-preview" (d'autres sont à installer) :

curl http://<IP-Machine>:8082/v1/chat/completions -H "Content-Type: application/json" -d '{

"model": "gpt-4-vision-preview",

"messages": [{"role": "user", "content": [{"type":"text", "text": "What is in the image?"}, {"type": "image_url", "image_url": {"url": "https://upload.wikimedia.org/wikipedia/commons/thumb/d/dd/Gfp-wisconsin-madison-the-nature-boardwalk.jpg/2560px-Gfp-wisconsin-madison-the-nature-boardwalk.jpg" }}], "temperature": 0.9}]}'

{"created":1724576857,"object":"chat.completion","id":"xxxx-xxxx-xxxxx-xxxx-xxxxxx","model":"gpt-4-vision-preview","choices":[{"index":0,"finish_reason":"stop","message":{"role":"assistant","content":"The image features a wooden path or boardwalk that is surrounded by tall grass, flowers, and weeds on both sides. The boardwalk is located in a rural marsh or grassy plain, with clouds visible in the sky above.\u003c/s\u003e"}}],"usage":{"prompt_tokens":1,"completion_tokens":49,"total_tokens":50}}

Plus d'explications ici : https://localai.io/features/gpt-vision/

Avec Nextcloud

Installation des applications nécessaires

Celles-ci sont disponibles sur la boutique Nextcloud :

- Intégration -> Nextcloud Assistant

- Intégration -> OpenAI and LocalAI integration

Configurations

Coté Personnel

Dans "Paramètres d'administration" -> "Intelligence artificielle" activer ou non les options disponibles :

Coté Administration

Dans "Paramètres d'administration" -> "Administration" -> "Intelligence artificielle"->"Intégration OpenAI et LocalAI"

Rentrer l'URL de votre service IA (ici localhost, n'oublier pas de rajouter la condition allow_local_remote_servers à true dans votre fichier de de configuration de Nextcloud config.php) :

A savoir qu'il y avait une option pour définir le modèle à utiliser. Mais cela semble avoir disparu... Sans doute qu'ils vont rajouter le choix selon ce que l'on cherche à faire, tchat/traducteur, générateur d'images, texte vers voix/voix vers texte, etc).

Mise à jour des images

Toutes les notes des mises à jour sont disponibles ici https://github.com/mudler/LocalAI/releases .

Il suffit simplement de supprimer l'instance en cours et de refaire un "pull" de l'image puis de relancer notre container.

Suppression

$ podman rm -f test

Mise à jour de l'image

$ podman pull docker.io/localai/localai:latest-aio-cpu

Relance du container

$ podman run -d --security-opt label=disable -p 8082:8080 -p 3333:3333 -e GRPC_PORT=3333 -e MODELS_PATH=/build/models -v ~/projets/IA/models:/build/models -e LOCALAI_THREADS=6 -e LOCALAI_CONTEXT_SIZE=2048 -e LOCALAI_UPLOAD_LIMIT=100 --name test docker.io/localai/localai:latest-aio-cpu

Pour aller plus loin

Création d'un service localai-latest systemd : (ÉBAUCHE!!!!! NE PAS UTILISER POUR LE MOMENT!)

Nous pouvons créer un service qui se mettra à jour automatiquement avec la dernière version de localai :

On ajoutera dans notre ".bashrc" :

export XDG_RUNTIME_DIR="/run/user/$UID"

Il faut relancer la session pour que cela soit prit en compte.

Nous allons créer un container en tant que service ici "test" :

$ podman generate systemd --new --files --name test

Puis on l'active :

$ systemctl --user enable --now container-test.service

Pour la mise à jour, il suffit de "puller" l'image et de lancer (Revoir le chemin!!!) :

$ cat ~/.config/systemd/users/test.container [Container] Image=quay.io/go-skynet/local-ai:latest-aio-cpu Exec=sleep infinity AutoUpdate=registry

$ systemctl --user daemon-reload

$ systemctl --user enable podman-auto-update

$ systemctl --user restart container-test.service

Pour vérifier si la nouvelle image est disponible:

$ podman auto-update --dry-run --format "Modèle:.Image Modèle:.Updated"

$ podman container list

Mettre à jour le service :

$ podman auto-update

Kubernetes : (Ébauche)

Vous pouvez vous baser sur la documentation disponible ici pour la création de votre infra kubernetes : Infrastructure KVM/QEMU+Kubernetes+CEPH

Nous utiliserons un espace de stockage sur une instance "CEPH", n'hésitez pas à modifier cette partie si nécessaire (avec un espace de stockage locale par exemple, sachant qu'il faut qu'il soit identique, mais aussi de taille importante, sur chaque machine!)

Noeuds Fédérés :

Nous mettons en place notre assistant LOCALAI en mode "noeuds fédérés". Pour cela nous allons utiliser les "Statefulls" qui permettent, grace à la définition de modèles, de créer des répliquas identique.

Ici nous aurons donc 1 container de "Répartition de charge" ("LoadBalancer") et 2 containers de "partage" (share).

Avant tout nous allons utiliser le service "secret" pour crypter et sécuriser notre token (à définir) :

Création de l'espace de nom "local-ai" ("namespace") :

cat <<CONFIG > ~/localai-namespace.yaml --- apiVersion: v2 kind: Namespace metadata: name: local-ai --- CONFIG" done

Puis notre service :

cat <<CONFIG > ~/localai-service.yaml

---

apiVersion: v1

kind: Service

metadata:

name: local-ai

namespace: local-ai

spec:

selector:

app: local-ai

type: LoadBalancer

ports:

- protocol: TCP

port: 8080

targetPort: 8080

nodePort: 30018

---

CONFIG"

done

Notre modèle de "loadbalancer":

$ cat <<CONFIG > ~/localai-loadbalancer.yaml ---

Et nos "share" :

$ cat <<CONFIG > ~/localai.yaml

---

apiVersion: apps/v1

kind: StatefulSet

metadata:

name: local-ai

namespace: local-ai

labels:

app: local-ai

spec:

serviceName: "localai-service"

replicas: 2

selector:

matchLabels:

app: local-ai

template:

metadata:

labels:

app: local-ai

name: local-ai

spec:

containers:

- name: local-ai

image: quay.io/go-skynet/local-ai:latest-aio-cpu

imagePullPolicy: IfNotPresent

- args:

- --federated

- --p2p

env:

- name: MODELS_PATH

value: /build/models

- name: LOCALAI_THREADS

value: "4"

- name: LOCALAI_CONTEXT_SIZE

value: "4096"

- name: TOKEN

valueFrom:

secretKeyRef:

name: ai-secret

key: aitoken

securityContext:

runAsUser: 0

privileged: true

volumeMounts:

- name: localai-volume

mountPath: /build/models

volumeClaimTemplates:

- metadata:

name: localai-volume

spec:

accessModes:

- ReadWriteOnce

volumeMode: Filesystem

resources:

requests:

storage: 50Gi

storageClassName: csi-rbd-sc

---

CONFIG"

done

Nous créons et ajoutons notre "Token" dans un "secret" dédié ici "ai-secret" :

Pour cela nous allons lancer tempairement un container "LOCALAI" avec Podman et l'option "--p2p" :

podman run -d --security-opt label=disable -p 8082:8080 -p 3333:3333 -e GRPC_PORT=3333 -e MODELS_PATH=/build/models -v ~/projets/IA/models:/build/models -e LOCALAI_THREADS=6 -e LOCALAI_CONTEXT_SIZE=2048 -e LOCALAI_UPLOAD_LIMIT=100 --name test docker.io/localai/localai:latest-aio-cpu --p2p

$ kubectl create secret generic ai-secret -n local-ai --from-literal=aitoken=NOTRETOKEN

A savoir que plus vous ajouter de réplicas, plus l'espace de stockage nécessaire s'agrandit (à voir si l'on peut utiliser le même vu que les modèles doivent être identique). Ici nous avons 2 réplicas, donc 2x50Go mis à disposition de l'installation des modèles.

Ajout de "worker" :

Conseils

Voici une liste de quelques conseils à suivre pour que l'expérience se passe bien (à étoffer).

- Ne surtout pas oublier que vous êtes responsables dans tous les cas de figure. Que ce soit généré par IA ou non !

- Ne jamais croire à une fiabilité à 100% sans vérification par d'autres sources !

- Bien se dire que c'est considéré comme une "AIDE" et non pas comme une solution de remplacement !

- Il faut bien choisir son modèle selon le besoin sachant que :

- Certains demandent beaucoup de puissance machines (Exemple : llma3-70b-instruct)

- Qu'il y en a des censurés et non censurés (à vos risques et périls)

- Certains sont uniquement adaptés à un type de besoin bien particulier

- Utiliser les "API" et la ligne de commande si vous voulez aller plus loin que ce que propose l'interface

- Ne pas hésitez à :

- Relire les réponses et corriger si besoin (conseil un peu trop souvent oublié même chez les "PRO")

- Vérifier le rendu des images

- Affiner les paramètres de la demande

- Ne pas hésiter à retoucher

- Vérifiez la cohérence Texte/Audio et Audio/Texte

Astuces de configuration (En cours de rédaction):

Configuration Form :

- Model Name : Identificateur unique pour du modèle

- Backend : Moteur à utiliser (par exemple : llama-cpp, transformers, diffusers, whisper, piper, bark-cpp, vllm, rerankers, exllama2, faster-whisper, stablediffusion-ggml)

- Model File/Path : Emplacement du modèle (locale ou à distance)

- Description : Déscription du modèle (facultatif)

- Usage Instructions : Instruction d'usage (facultatif)

Model Parameters :

- Temperature : Contrôle les caractères aléatoire

- "Réglage de 0<->2"

- plus c'est haut plus c'est imprécis

- plus c'est bas plus c'est précis.

- Conseil : régler entre 0.7 et 0.9

- Top P : Échantillonnage du noyau

- Top K :

- Max Tokens : Limite le nombre de tokens utilisé, cela peut induire des coupures dans les réponses si le maximum est dépassé. A réglé selon le besoin.

- 0 : désactive la limite maximum

- Exemple de limites :

- 1->2 : permet d'avoir 2 tokens dans la réponse :

- Avec un Résultat correct : "Bonjour Je m'appel Jean" donne en réponse "Bonjour Jean"

- Résultat tronqué si dépassé : "Bonjour je m'appel Jean MiMi" donne en réponse "Bonjour Jean M."

- ....

- 1->2 : permet d'avoir 2 tokens dans la réponse :

- Seed :

- Valeur basse :

- Valeur haute :

- Repeat Penalty :

- Frequency Penalty :

- Presence Penalty :

- N (Number of results) : Nombre de résultat affiché à l'écran

- Valeur basse :

- Valeur haute :

- Echo (option)

- Ignore EOS (option) :

- Repeat Last N : Garde en mémoire un nombre défini de tokens pour évité les répétitions.

- Réglage de : 0 à 1024

- Plus le chiffre est grand plus grand est la consomation Mmmoire. et plus long sont les traitements des réponses.

- N Keep

- TFZ (Tail Free Sampling)

- Typical P

- Negative Prompt : Indiquer ce que vous ne voulez pas voir dans vos résultats

- RoPE Freq Base :

- RoPE Freq Scale :

- Negative Prompt Scale : Nombre de fois que vous appliquez votre règle "Negative prompt".

- CLIP Skip :

- Language :

- Translate :

- Tokenizer :

Advanced Configuration :

- Use F16 : Précision sur 16 bits

- Threads : Nombre de Thread, se limiter aux coeurs physique du processeur est conseillé. Déduire un coeur pour ne pas saturer les ressources systèmes et entrainer des bloquages.

- Debug Mode : Active/désactive le mode débogue. Augmente la verbosité des logs quand il est actif.

- Embeddings Mode :

- Enable CUDA : Non nécessaire si utilisation des backends ROCM/SYSCL

- Memory Mapping :

- Memory Lock : Bloque le modèle en mémoire

- Low VRAM Mode : Force le modèle à moins consommer de VRAM (mémoire graphique)

- NUMA : non uniform memory access ou non uniform memory architecture (accès mémoire non uniforme et architecture mémoire non uniforme)

- Context Size : Défini la limite du context utilisé.

- Limité à la taille du modèle

- Permet l'utilisation du modèle au maximum tant que la VRAM/RAM disponible n'est pas remplit à 100%

- Plus petit que la taille du modèle : Permet l'utilisation de modèles plus grand sur des systèmes n'ayant pas assez de VRAM/RAM

- Exemple 1 : En cas d'utilisation d'un modèle 20B, un réglage de 8128 permet d'utiliser le modèle avec 8Go de VRAM/RAM

- Exemple 2 : .....

- Plus grand que la taille du modèle :

- Limité à la taille du modèle

- GPU Layers

- Reranking

LLM Configuration :

- System Prompt

- Tensor Split

- Main GPU

- Mirostat : C'est une méthode de sampling adaptative ou échantillonnage adaptatif, est plus efficace que le Top_P et Top_K, car il adapte le taux d'échantillonnage automatiquement en permanence. Nécéssite de désactiver Top_P/Top_K (Mettre "1" comme valeur) et les options de "Repeat" (Mettre "0" en valeur).

- 0 : Désactivé.

- 1 : Mirostat (algorithme original).

- 2 : Mirostat 2.0 (algorithme amélioré, généralement préféré pour une convergence plus rapide)

- Mirostat ETA : Permet le contrôle de la vitesse d'ajustement de l'option "Mirostat". Par défaut il est réglé à "0.1", plus la valeur est haute, plus vous augmenter les instabilités et oscillations dans les textes générés. Un réglage de "0.2" semble être un bon compromit.

- Désactiver "Top_P" en le mettant à "1"

- Désactiver "Top_K" en le mettant à "1"

- Désactiver "Min_P" en le mettant à ....

- Mirostat TAU : Permet d'ajuster l'entropie de Mirostat.

- Valeurs Faible 2.0-3.0 = les textes générés sont plus cohérent

- Valeur moyenne 4.0-5.0 = bon équilibre cohérence/diversité dans les textes générés

- Valeur haute 6.0->+ = textes générés pouvant être moins cohérent, augmente la diversité/créativité