« Infrastructure KVM/QEMU+Kubernetes+CEPH » : différence entre les versions

| Ligne 176 : | Ligne 176 : | ||

On gardera la gestion de la SWAP avec une utilisation au dernier moment (par défaut on utilise de la ZRAM en mémoire RAM, mais il est possible de rajouter de la SWAP sur unité de stockage) comme suit : | On gardera la gestion de la SWAP avec une utilisation au dernier moment (par défaut on utilise de la ZRAM en mémoire RAM, mais il est possible de rajouter de la SWAP sur unité de stockage) comme suit : | ||

# sysctl vm.swappiness=10 | # sysctl vm.swappiness=10 | ||

On rajoutera cette option dans /etc/sysctl.d/'''k8s.conf''' | On rajoutera cette option dans /etc/sysctl.d/'''k8s.conf''' : | ||

vm.swappiness = 10 | vm.swappiness = 10 | ||

Version du 25 août 2023 à 19:06

Article en cours de rédaction ou de modification !

Le présent article est actuellement en cours de rédaction ou de modification.

Adressez-vous à la personne en charge pour toute proposition ou modification.

| Aide Pour lire ce wiki convenablement, merci de lire la page suivante concernant les conventions de nommage. |

Introduction :

Nous allons présenter ici une infrastructure "Kubernetes" qui peut être mis en oeuvre sur 3 Hyperviseurs "bare metal" (machines physique) KVM/QEM ou simplement sur 3 Machines virtuels (VM).

A savoir que cela reste une base qui peut être largement amélioré/modifié selon les besoins et de vos possibilités.

Cette documentation est fortement inspiré en partie à partir du lien suivant pour la partie Kubernetes et CEPH. Sans le copier/coller et les erreurs intentionnel ou non :

https://www.server-world.info/en/note?os=Fedora_38&p=kubernetes&f=1

La documentation officiel de Kubernetes est disponible ici :

https://kubernetes.io/fr/docs/home/

Pré-requis :

Il nous faut donc :

- 1 hôte physique "hote1.local" disposant d'une interface graphique (ici KDE/plasma) étant à la fois :

- Administrateur pour les 3 hyperviseurs physiques avec Virt-manager

- Hyperviseur

- Minimum requis conseillé :

- 1 processeur 4 coeurs/8 threads

- 16Go de RAM (ou 32Go si vous n'utilisez qu'un seul hyperviseur/machine physique)

- 2 hôtes physique "hyperviseurs" "hote2.local" et "hote3.local"

- Minimum requis conseillé :

- 1 processeur 4 coeurs/8 threads

- 16Go de RAM

- Minimum requis conseillé :

- 1 VM (machine virtuel) "Master" :

- 2->4 vcpu + 4Go de RAM minimum recommandé

- Utilisé en tant que "Control Plane" kubernete

- Nommée "vm1.local"

- 1 VM "Worker" par hôte :

- 2->4vcpu + 6/8Go de RAM minimum recommandé par hôte

- Sert à déployer nos pods

- Nommée "vm2.local" et "vm3.local"

- DNS :

- Soit on ajoute les IP correspondant aux noms des VM dans /etc/hosts pour chaque hyperviseur et VM

- Soit on installe un serveur DNS personnel à notre infrastructure

- Exemple : Vous pouvez utiliser celui fourni à l'installation de FreeIPA (IPA ou IDM/Identity manager)

- Autres...

- CEPH (optionnel) :

- Pour gérer le stockage permanent (d'autres solutions existe NFS, glusterFS, etc...)

- 3 VM (peut être réparti sur les 3 hyperviseurs) composé de :

- 2 vcpu, 2Go de RAM

- D'au moins une unité de stockage de 10Go (ou plus si besoin) dédié à notre cluster CEPH

- 3 VM (peut être réparti sur les 3 hyperviseurs) composé de :

- Pour gérer le stockage permanent (d'autres solutions existe NFS, glusterFS, etc...)

Schémas d'architecture :

Avec 3 hyperviseur bare-metal + VM :

- hote1.local :

- kadmin1

- hote2.local

- kworker1

- hote3.local

- kworker2

Avec 1 hyperviseur bare-metal + VM :

kadmin1

kworker1

kworker2

Configuration Réseaux (si 3 hyperviseurs bare-metal) :

Routage :

Il est nécessaire de rajouter le routage vers le réseau virtuel, voir plusieurs si nécessaire, prédéfini par "Hyperviseur" physique.

Cette partie n'est pas nécessaire si l'on ne déploie pas sur plusieurs hôtes physique.

On utilisera le routage suivant :

hote1.local :

192.168.10.0/24 (kadmin1 192.168.10.10, kwork1 192.168.10.20)

hote2.local :

192.168.20.0/24 (kwork2 192.168.20.20)

hote3.local :

192.168.30.0/24 (kwork3 192.168.30.20)

On rajoutera le mode "masquerade" et "forward" au niveau du pare-feu (firewall) :

# firewall-cmd --add-masquerade && firewall-cmd --add-masquerade --permanent # firewall-cmd --add-forward && firewall-cmd --add-forward --permanent

On lance la commande pour prendre en compte directement les règles du pare-feu :

# firewall-cmd --reload

Il existe plusieurs méthodes, mais les deux plus commune sont :

1 : En ligne de commande avec "nmcli" (Modifier ce qui est en GRAS):

Pour ajouter de nouvelles routes à votre interface réseau, nous utiliserons principalement la commande "nmcli" comme suite:

Hôte 1 :

#nmcli connection modify enp1s0 +ipv4.routes "192.168.20.0/24 VERS-IP-DE-hote2.local"#nmcli connection modify enp1s0 +ipv4.routes "192.168.30.0/24 VERS-IP-DE-hote3.local"

Hôte 2 :

#nmcli connection modify enp2s0 +ipv4.routes "192.168.10.0/24 VERS-IP-DE-hote1.local"#nmcli connection modify enp2s0 +ipv4.routes "192.168.30.0/24 VERS-IP-DE-hote3.local"

Hôte 3 :

#nmcli connection modify enp3s0 +ipv4.routes "192.168.10.0/24 VERS-IP-DE-hote1.local"#nmcli connection modify enp3s0 +ipv4.routes "192.168.20.0/24 VERS-IP-DE-hote2.local"

2 : Avec l'interface "nmtui" disponible avec "NetworkManager-tui" :

# dnf install NetworkManager-tui

A suivre

KVM/QEMU (hyperviseurs) :

On utilisera l'interface graphique "virt-manager" pour créer et gérer les 3 hyperviseurs sur un hôte, le gestionnaire, ayant un environnement graphique. (la création et gestion en ligne de commande est possible, mais plus complexe)

Voici le lien de base pour installer et configurer vos VM (à faire sur chaque hyperviseur) : Virtualisation : KVM, Qemu, libvirt en images

Il est nécessaire de créer et partager la clef du gestionnaire avec les hyperviseurs : SSH : Authentification par clé

Ajout des hyperviseurs distant :

Captures d'écran

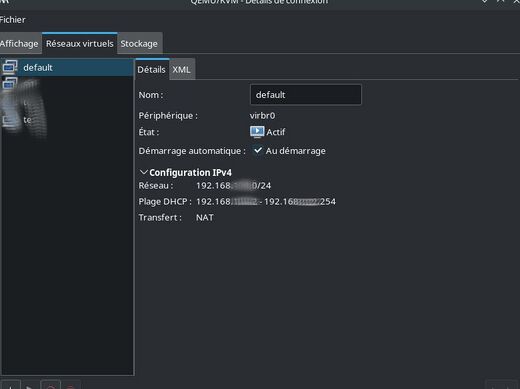

Réseaux virtuels (à faire sur chaque hyperviseur) :

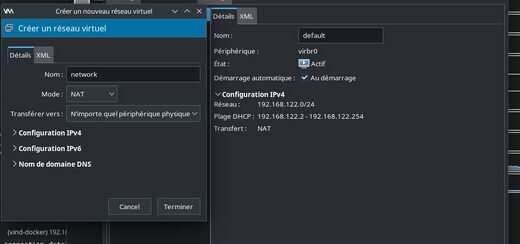

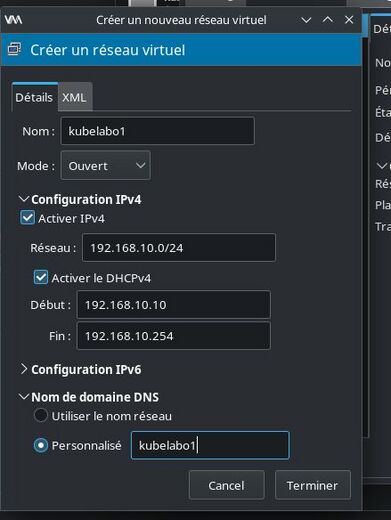

Ajout d'un réseau virtuel en mode "ouvert" (open) :

Capture interface "Réseaux virtuels" :

On change le mode par "Ouvert" :

IPV4 (remplacer XX selon l'hôte en 1 : "10", en 2 : "20", etc...) :

Réseau en 192.168.XX.0/24

DHCPV4 192.168.XX.10->192.168.XX.100

Nom de domaine DNS :

"Personnalisé" : ici kubelabo1/2/3/...

Ce réseau sera à utiliser dans la configuration de nos VM.

Création des Machines virtuel :

On utilisera une ISO Fedora (dernière en date) pour déployer nos machines virtuels.

Il est préférable de partir sur une Fedora "Everything" qui permet d'installer que ce dont nous avons besoins.

Exemple ici :

Captures Installation d'une "Everything" type

Firewalld :

Nous utiliserons firewalld :

# firewall-cmd --add-masquerade --permanent # firewall-cmd --add-forward --permanent

On active les services du pare-feu pour Kubernetes (EN COURS) :

# firewall-cmd --add-service=kube-controller-manager-secure --add-service=kube-api --add-service=kube-apiserver --add-service=kube-controller-manager-secure --add-service=kube-controller-manager --add-service=kube-control-plane --add-service=kube-control-plane-secure --add-service=kubelet --add-service=kubelet-readonly --add-service=kubelet-worker --add-service=kube-nodeport-services --add-service=kube-scheduler --add-service=kube-scheduler-secure --add-service=kube-worker --permanent

On lance la commande pour prendre en compte directement les règles du pare-feu :

# firewall-cmd --reload

Serveur DNS :

La gestion de cette partie étant parfois bien trop problématique, nous allons repasser sur quelque chose de plus manuel et classique.

Pour cela nous allons modifier le comportement de la résolution du DNS de chaque hôte virtuel (ici avec "vi") :

# systemctl disable --now systemd-resolved # vi /etc/NetworkManager/NetworkManager.conf

On ajoute/modifie la section "main" :

[main] dns=default

On délie le fichier /etc/resolv.conf

# unlink /etc/resolv.conf

On recrée le fichier /etc/resolv.conf

# touch /etc/resolv.conf

On ajoutera notre serveur DNS personnel dans notre resolv.conf.

SWAP + divers :

On gardera la gestion de la SWAP avec une utilisation au dernier moment (par défaut on utilise de la ZRAM en mémoire RAM, mais il est possible de rajouter de la SWAP sur unité de stockage) comme suit :

# sysctl vm.swappiness=10

On rajoutera cette option dans /etc/sysctl.d/k8s.conf :

vm.swappiness = 10

On redémarre la machine.

Kubernetes (VM) :

La version de kubernetes fourni par défaut dépend de la version de Fedora installé .

1.25 pour Fedora 37, en 1.26 pour Fedora 38, etc...

Installation sur "kadmin1" (en root) en tant que "Controle Plane" :

On installe les paquets suivant :

# dnf install cri-o kubernetes kubernetes-client kubernetes-kubeadm kubernetes-master kubernetes-node

On active le module suivant :

# modprobe br_netfilter

Que l'on ajoutera dans un fichier :

# vi /etc/module./kube.conf

On active le service kubelet :

# systemctl enable kubelet.service

Et on active et démarre le service "crio" :

# systemctl enable --now crio.service

On initialisera notre kubernetes comme suit :

# kubeadm init --pod-network-cidr=10.0.0.0/16 --cri-socket=unix:///var/run/crio/crio.sock --ignore-preflight-errors=swap

Si tout ce passe bien, nous devrions pouvoir récupérer la commande suivante :

# kubeadm join 192.168.10.10:6443 --token xxxxxxxxxxxxxx --discovery-token-ca-cert-hash sha256:xxxxxxxxxxxxxxxxxx

On rajoutera l'option suivante :

--ignore-preflight-errors all

Ajout en tant que "Worker" :

# kubeadm join 192.168.10.10:6443 --token xxxxxxxxxxxxxx --discovery-token-ca-cert-hash sha256:xxxxxxxxxxxxxxxxxx --ignore-preflight-errors all

Nous vous conseillons de les copier là quelque part dans un portefeuille numérique crypté (keepass, kwallet, etc...).

Pour avoir accès en permanence aux commandes "kube" et complétion-automatique, on lancera la suite de commande suivante sur le/less "Controle Plane" :

# mkdir -p $HOME/.kube # sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config # sudo chown $(id -u):$(id -g) $HOME/.kube/config

Ou temporairement :

export KUBECONFIG=/etc/kubernetes/admin.conf

Installation en tant que "Worker" sur "kworker1 et kworker2" :

On installe les paquets suivant

# dnf install cri-o kubernetes kubernetes-client kubernetes-node kubernetes-kubeadm

On active le module suivant :

# modprobe br_netfilter

Que l'on ajoutera dans un fichier :

# vi /etc/module./kube.conf

Et on lancera donc la commande pour rattacher notre noeud en tant que "worker" retourné par le retour de "kubeadm init..." :

# kubeadm join 192.168.10.10:6443 --token xxxxxxxxxxxxxx --discovery-token-ca-cert-hash sha256:xxxxxxxxxxxxxxxxxx --ignore-preflight-errors all

Sur "kadmin1 :

On test si l'on voit tous les noeuds :

# kubectl get nodes

Résultat (exemple) :

# kubectl get nodes NAME STATUS ROLES AGE VERSION kube01.local Ready control-plane 206d v1.26.7 kube02.local Ready <none> 205d v1.26.7 kube03.local Ready <none> 205d v1.26.7

On vas modifier le rôle par défaut de nos noeuds en tant que "Worker" :

kubectl label node kube0x.local node-role.kubernetes.io/worker="worker"

Résultat (exemple) :

# kubectl get nodes NAME STATUS ROLES AGE VERSION kube01.local Ready control-plane 206d v1.26.7 kube02.local Ready worker 205d v1.26.7 kube03.local Ready worker 205d v1.26.7

Pour vérifier les pods :

# kubectl get pods -A

Résultat (exemple) :

kube-system coredns-xxxx-6sgjh 1/1 Running 12 120d kube-system coredns-xxxx-j2478 1/1 Running 19 141d kube-system coredns-xxxxx-x58lj 1/1 Running 25 52d kube-system etcd-kubemaster01.ipazeus.local 1/1 Running 126 206d kube-system kube-apiserver-kubemaster01.ipazeus.local 1/1 Running 31 157d kube-system kube-controller-manager-kubemaster01.ipazeus.local 1/1 Running 31 157d kube-system kube-proxy-6jfzb 1/1 Running 25 157d kube-system kube-proxy-92vd4 1/1 Running 26 157d kube-system kube-proxy-gpkdq 1/1 Running 29 157d kube-system kube-proxy-hthq6 1/1 Running 11 154d kube-system kube-proxy-n62vl 1/1 Running 6 157d kube-system kube-scheduler-kubemaster01.ipazeus.local 1/1 Running 25 141d kubernetes-dashboard dashboard-metrics-scraper-64bcc67c9c-mftc6 1/1 Running 22 152d kubernetes-dashboard kubernetes-dashboard-5c8bd6b59-gtwtm 1/1 Running 22 152d

Commandes utiles :

Toutes les commandes utiles sont disponible ici : https://kubernetes.io/fr/docs/reference/kubectl/cheatsheet/

Nous en rajouterons au fur est à mesure celles qui nous sembles les plus importantes ici :

- Pour récupérer la commande, ainsi que son token, pour ajouter un noeud :

kubeadm token create --print-join-command

- Pour récupérer la clef du certificat :

kubeadm init phase upload-certs --upload-certs

Résultat :

I0xx 17:01:40.112468 19386 version.go:256] remote version is much newer: v1.28.1; falling back to: stable-1.26 [upload-certs] Storing the certificates in Secret "kubeadm-certs" in the "kube-system" Namespace [upload-certs] Using certificate key: 2xxxxxxxxxxxxxxxxxxxxxxxxxxxxf57ca186bbc34xxxxxxxxxxxxxxxxxxxx