« LocalAI Assistant à base de modèles IA » : différence entre les versions

| Ligne 78 : | Ligne 78 : | ||

==== Accélération CPU+GPU ROCM (AMD) ==== | ==== Accélération CPU+GPU ROCM (AMD) ==== | ||

A venir | |||

==== Accélération CPU+GPU CUDA (NVIDIA) ==== | ==== Accélération CPU+GPU CUDA (NVIDIA) ==== | ||

A venir | |||

==== Accélération CPU+GPU SYCL (INTEL) ==== | ==== Accélération CPU+GPU SYCL (INTEL) ==== | ||

A venir | |||

=== Utilisation === | === Utilisation === | ||

Version du 12 juillet 2024 à 13:58

Article en cours de rédaction ou de modification !

Le présent article est actuellement en cours de rédaction ou de modification.

Adressez-vous à la personne en charge pour toute proposition ou modification.

| Aide Pour lire ce wiki convenablement, merci de lire la page suivante concernant les conventions de nommage. |

Introduction

Je vais vous présenter l'installation d'une instance pour bénéficier d'un assistant personnel basé sur des modèles neuronaux libres ou avec quelques conditions en local.

Pour cela nous utiliserons LocalAI qui est une API REST alternative open source à OpenAI : https://localai.io/

Vous pouvez déployer la solution directement sur votre système, dans un container podman/docker ou sur un cluster Kubernetes.

Cette documentation s'attardera à présenter une installation dans des containers avec Podman : https://podman.io/

Cela parle aussi de l'intégration avec votre serveur Nextcloud à partir de la version Hub8 (29.x) : https://nextcloud.com/fr/

Nous n'utiliserons qu'une seule instance sur un simple nœud (1 machine physique ou virtuelle), mais il est possible d'en utiliser plusieurs pour du calcul en parallèle.

Présentation

LocalAI permet d'avoir une solution locale pour la mise à disposition et l’exploitation de modèles d’Intelligence Artificielle (IA ou AI en anglais) en local (pas de connexion Internet possible), généralement libre et/ou avec quelques conditions.

Parmi les modèles et options proposés vous pouvez disposer :

- De tchats (Conversationnels + Traducteurs multi-lingues)

- De générateurs d'images

- De convertisseurs Vidéo/Musique vers du texte

- De convertisseurs Texte vers Voix

- Et bien d'autres possibilités présentes et à venir ...

Pré-Requis

Nous vous conseillons de bien régler les paramètres de votre bios et de ne pas utiliser les modes d'overclocking automatique, ainsi que les modes de "boost" du processeur, ainsi que de la carte graphique. Les performances ne sont pas trop impacté et vous allez gagner en consommation/température, mais aussi en silence de fonctionnement.

N'hésitez pas à demander de l'aide sur notre forum si nécessaire.

Au minimum

- Processeur 4 cœurs/4 threads

- Un bon refroidissement

- 16 Go de Mémoire (RAM)

- 100 Go de stockage disponible (les modèles prennent beaucoup de place)

Conseillé

- Processeur 6 cœurs/12 threads

- 32, voire 64 Go de Mémoire (RAM)

- 500 Go de stockage (NVME de préférence)

En option

- Carte graphique supportant le GPGPU avec CUDA (Nvidia), ROCM (AMD), SYCL (INTEL)

- Un NPU

- Autres à suivre

Podman

Installation

Accélération CPU (réalisé et testé sur AMD Ryzen ZEN3 5600G et 5800X)

On ouvrira les flux du pare-feu pour les accès distants sur les ports 8082/TCP et 3333/TCP :

# firewall-cmd --add-port=8082/tcp --add-port=3333/tcp && firewall-cmd --runtime-to-permanent

On installe podman si ce n'est pas déjà fait :

# dnf install podman

On récupère le container de localai pour processeur :

$ podman pull docker.io/localai/localai:latest-aio-cpu

On va créer un répertoire de stockage permanent (à modifier au besoin) :

$ mkdir ~/projets/IA/models

On va lui attribuer l'étiquette SELinux du dossier /var/lib/containers (à revoir, car cela ne rend pas le dossier accessible pour les containers sur Fedora 40...) :

$ sudo semanage fcontext -a -e /var/lib/containers /home/UTILISATEUR/projets/IA/models

On lance notre container :

$ podman run -d --security-opt label=disable -p 8082:8080 -p 3333:3333 -e GRPC_PORT=3333 -e MODELS_PATH=/build/models -v ~/projets/IA/models:/build/models -e LOCALAI_THREADS=6 -e LOCALAI_CONTEXT_SIZE=2048 -e LOCALAI_UPLOAD_LIMIT=100 --name test docker.io/localai/localai:latest-aio-cpu

Descriptif des options à modifier au besoin :

- LOCALAI_THREADS : Indique le nombre de cœurs/threads à utiliser (de préférence n'utiliser que des coeurs physique) : Ici pour un Ryzen 5 en 6 cœurs/12 threads (par défaut sur 4 threads)

- LOCALAI_CONTEXT_SIZE (en Méga octets) : Défini la taille du contexte des modèles (512 Mo par défaut) Ici réglé sur 2048Mo

- LOCALAI_UPLOAD_LIMIT (en Méga octets) : Limite de téléchargement (15 Mo par défaut) Ici réglé sur 100Mo

Accélération CPU+GPU ROCM (AMD)

A venir

Accélération CPU+GPU CUDA (NVIDIA)

A venir

Accélération CPU+GPU SYCL (INTEL)

A venir

Utilisation

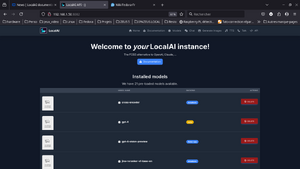

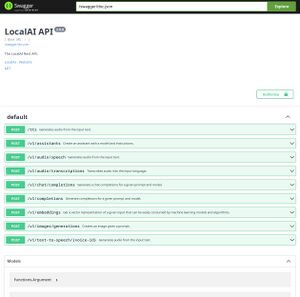

Par l'interface graphique Web

Pour accéder à l'interface graphique WEB par défaut, il faut lancer le lien :

http://IPmachine(ou localhost):8082

Il est nécessaire de bien sélectionner son modèle avant de l'utiliser (exemple : génération d'image avec "stable diffusion", etc...)

Galerie d'images

Accueil

Models :

La liste des modèles peut être consulté (en anglais) soit sur cette page, soit sur le site : https://localai.io/gallery.html

Vous en avez beaucoup de disponible censurée ou non (Il faut consulter le descriptif en anglais pour savoir si cela vous convient).

Il y en a d'autres à installé manuellement (voir pour cela sur le site de LocalAI).

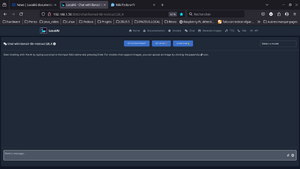

Chat :

Il faut choisir le modèle pour pouvoir converser avec (la liste ne fait pas la distinction).

Exemple de modèles "GPT4" (par défaut) ou llama3-8b-instruct (à installer, bon rapport performance/qualité dans les interactions).

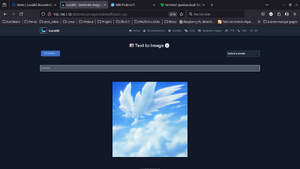

Generate images

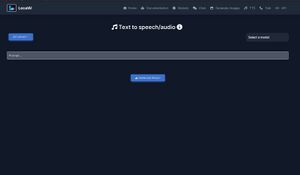

TTS

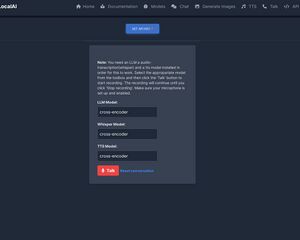

Talk

</>API

En ligne de commande

Voici quelques exemples et résultats selon les cas d'utilisation.

La liste des modèles installés disponible s'obtient avec :

curl http://IP-Machine:8082/v1/models

Chat

Exemple :

curl http:/IP-Machine:8082/v1/chat/completions -H "Content-Type: application/json" -d '{

"model": "llama3-8b-instruct",

"messages": [{"role": "user", "content": "Salut, comment vas tu?"}],

"temperature": 0.1

}'

Réponse :

{"created":1720598309,"object":"chat.completion","id":"xxxxxxx-a24f-xxxxxxx-a0de-xxxxxxxxxdeb","model":"llama3-8b-instruct","choices":[{"index":0,"finish_reason":"stop","message":{"role":"assistant","content":"Bonjour ! Je suis un modèle de langage artificiel, donc je n'ai pas d'état d'esprit ou d'émotions comme les humains. Je suis juste là pour discuter et répondre à vos questions ! Comment puis-je vous aider aujourd'hui ?"}}],"usage":{"prompt_tokens":19,"completion_tokens":58,"total_tokens":77}

Génération d'images

TTS

Talk

Avec NextCloud

Installation des applications nécessaire :

Configurations :

Mise à jours des images :

Toutes les notes des mises à jours sont disponible ici :

https://github.com/mudler/LocalAI/releases

Il suffit simplement de supprimer l'instance en cours et de refaire un "pull" de l'image et de relancer notre container .

Suppression :

$ podman rm -f test

Mise à jour de l'image :

$ podman pull docker.io/localai/localai:latest-aio-cpu

Relance du container :

$ podman run -d --security-opt label=disable -p 8082:8080 -p 3333:3333 -e GRPC_PORT=3333 -e MODELS_PATH=/build/models -v ~/projets/IA/models:/build/models -e LOCALAI_THREADS=6 -e LOCALAI_CONTEXT_SIZE=2048 -e LOCALAI_UPLOAD_LIMIT=100 --name test docker.io/localai/localai:latest-aio-cpu

Pour aller plus loin

Conseils

Voici une liste de quelques conseils à suivre pour que expérience se passe bien (à étoffer).

- Ne surtout pas oublier que vous êtes responsables dans tous les cas de figure. Que ce soit généré par IA ou non!

- Ne jamais croire à une fiabilité à 100% sans vérification par d'autres sources

- Bien se dire que c'est considéré comme une "AIDE" et non pas comme une solution de remplacement!

- Il faut bien choisir son modèle selon le besoin sachant que :

- Certains demandent beaucoup de puissance machines (Exemple : llma3-70b-instruct)

- Qu'il y en a des censurés et non censurés (à vos risques et périls)

- Certains sont uniquement adapté à un type de besoin bien particulier

- Utiliser les "API" et la ligne de commande si vous voulez aller plus loin que ce que propose l'interface

- Ne pas hésitez à :

- Relire les réponses et corriger si besoin (conseil un peu trop souvent oublié même chez les "PRO")

- Vérifiez le rendu des images

- Affiner les paramètres de la demande

- Ne pas hésiter à retoucher

- Vérifiez la cohérence Texte/Audio et Audio/texte