« Infrastructure KVM/QEMU+Kubernetes+CEPH » : différence entre les versions

| Ligne 218 : | Ligne 218 : | ||

CRUN" | CRUN" | ||

done | done | ||

Lancer la copy de la clef sur vos différents nœuds : | |||

# ssh-copy-id '''192.168.10.10''' | |||

# ssh-copy-id '''192.168.20.10''' | |||

# ssh-copy-id '''192.168.30.10''' | |||

# ssh-copy-id '''192.168.10.20''' | |||

# ssh-copy-id '''192.168.20.20''' | |||

# ssh-copy-id '''192.168.30.10''' | |||

# create new (define each Node and SSH user) | # create new (define each Node and SSH user) | ||

Version du 24 avril 2024 à 06:34

Article en cours de rédaction ou de modification !

Le présent article est actuellement en cours de rédaction ou de modification.

Adressez-vous à la personne en charge pour toute proposition ou modification.

| Aide Pour lire ce wiki convenablement, merci de lire la page suivante concernant les conventions de nommage. |

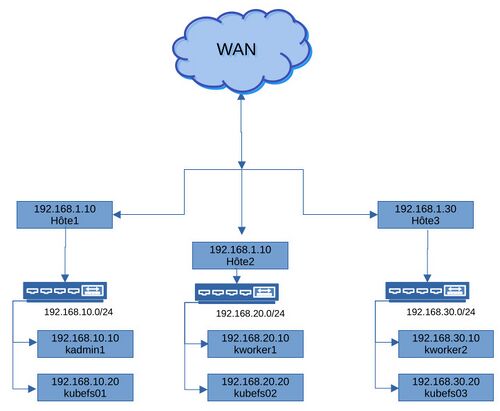

Introduction :

Nous allons présenter ici une infrastructure Kubernetes qui peut être mise en œuvre sur 3 Hyperviseurs "bare metal" (machines physiques) KVM/QEMU ou simplement sur 3 Machines virtuelles (VM).

A savoir que cela reste une base qui peut être largement améliorée/modifiée selon les besoins et vos possibilités.

Cette documentation est fortement inspirée en partie à partir des liens suivants pour Kubernetes et CEPH ; sans le copier/coller et les erreurs intentionnelles ou non :

- https://www.server-world.info/en/note?os=Fedora_38&p=kubernetes&f=1

- https://fedoramagazine.org/kubernetes-with-cri-o-on-fedora-linux-39/

La documentation officielle de Kubernetes est disponible depuis https://kubernetes.io/fr/docs/home/ .

A savoir que l'on s'éloigne d'une procédure pouvant être mise en œuvre pour passer les certifications Kubernetes (CKA, CKD, CKS, etc).

Vous pouvez venir en discuter sur le sujet du forum dédié à cette documentation :

https://forums.fedora-fr.org/d/74126-infrastructure-kvmqemukubernetes/76

Pré-requis :

Il nous faut donc :

- S'assurer d'avoir activé, après confirmation que le processeur les supporte, les options de virtualisation matérielle dans le bios de de la carte mère (voir la documentation de celle-ci) de chaque hôte physique.

- 1 hôte physique "hote1" disposant d'une interface graphique (ici KDE/plasma) étant à la fois :

- Administrateur pour les 3 hyperviseurs physiques avec Virt-Manager

- Hyperviseur

- Minimum requis conseillé :

- 1 processeur 4 cœurs/8 threads

- 16 Go de RAM (ou 32 Go si vous n'utilisez qu'un seul hyperviseur/machine physique)

- 2 hôtes physiques "hyperviseurs" "hote2" et "hote3"

- Minimum requis conseillé :

- 1 processeur 4 cœurs/8 threads

- 16 Go de RAM

- Minimum requis conseillé :

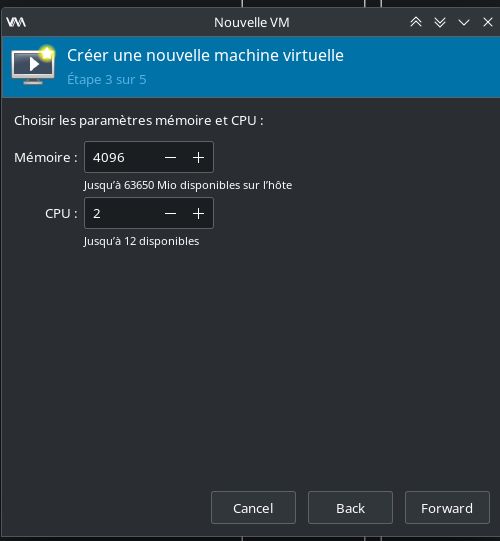

- 1 VM (machine virtuelle) "kadmin1" :

- 2->4 vcpu + 4 Go de RAM minimum recommandé

- Utilisée en tant que "Control Plane" kubernete

- 1 VM "Worker" par hôte :

- 2->4vcpu + 6/8 Go de RAM minimum recommandés par hôte

- Sert à déployer nos pods

- Nommée "kworker1" et "kworker2", etc

- DNS :

- Soit on ajoute les IP correspondant aux noms des VM dans

/etc/hostspour chaque hyperviseur et VM - Soit on installe un serveur DNS personnel à notre infrastructure

- Exemple : Vous pouvez utiliser celui fourni à l'installation de FreeIPA (IPA ou IDM/Identity manager)

- Autres...

- Soit on ajoute les IP correspondant aux noms des VM dans

- CEPH (optionnel) :

- Pour gérer le stockage permanent (d'autres solutions existent NFS, glusterFS, etc...)

- 3 VM (peut être réparti sur les 3 hyperviseurs) composé de :

- 1 ou 2 vcpu, 2 Go de RAM minimum conseillés

- Une unité de stockage de 10 Go minimum virtuelle (possibilité d'utiliser des unités de stockage physique dédiées et autres types)

- 3 VM (peut être réparti sur les 3 hyperviseurs) composé de :

- Pour gérer le stockage permanent (d'autres solutions existent NFS, glusterFS, etc...)

Schémas d'architecture

- Avec 3 hyperviseurs bare-metal + VM (exemple, rien ne vous empêche d'ajouter d'autres VM sur les mêmes hôtes) :

hote1 : kadmin1 / hote2 : kworker1 / hote3 : kworker2

- Avec 1 hyperviseur bare-metal + VM :

kadmin1 / kworker1 / kworker2

Configuration Réseaux (si 3 hyperviseurs bare-metal)

Routage

Il est nécessaire de rajouter le routage vers le réseau virtuel, voir plusieurs si nécessaire, prédéfini par "Hyperviseur" physique.

Cette partie n'est pas nécessaire si l'on ne déploie pas sur plusieurs hôtes physiques.

On utilisera le routage suivant :

- hote1 : 192.168.10.0/24 (kadmin1 192.168.10.10, kubefs01 192.168.10.20)

- hote2 : 192.168.20.0/24 (kworker2 192.168.20.20, kubefs02 192.168.20.20)

- hote3 : 192.168.30.0/24 (kworker3 192.168.30.20, kubefs03 192.168.20.20)

On ajoutera le mode "masquerade" et "forward" au niveau du pare-feu (firewalld) de chaque hôte physique :

# firewall-cmd --add-masquerade && firewall-cmd --add-masquerade \ firewall-cmd --add-forward && firewall-cmd --add-forward \ firewall-cmd --runtime-to-permanent

Il existe plusieurs méthodes, mais les deux plus communes sont expliquées ci-dessous.

En ligne de commande avec nmcli

Pour ajouter de nouvelles routes à votre interface réseau, nous utiliserons principalement la commande nmcli comme suit (modifier ce qui est en GRAS) :

- Hôte 1 :

#nmcli connection modify enp1s0 +ipv4.routes "192.168.20.0/24 VERS-IP-DE-hote2"#nmcli connection modify enp1s0 +ipv4.routes "192.168.30.0/24 VERS-IP-DE-hote3"

- Hôte 2 :

#nmcli connection modify enp2s0 +ipv4.routes "192.168.10.0/24 VERS-IP-DE-hote1"#nmcli connection modify enp2s0 +ipv4.routes "192.168.30.0/24 VERS-IP-DE-hote3"

- Hôte 3 :

#nmcli connection modify enp3s0 +ipv4.routes "192.168.10.0/24 VERS-IP-DE-hote1"#nmcli connection modify enp3s0 +ipv4.routes "192.168.20.0/24 VERS-IP-DE-hote2"

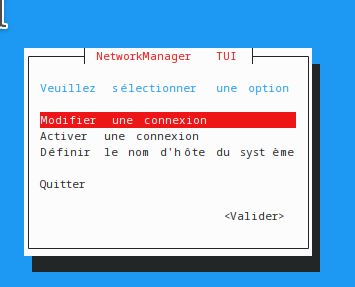

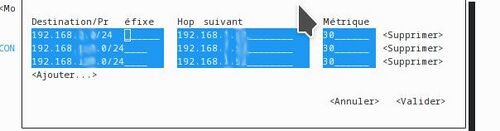

Avec l'interface nmtui disponible avec NetworkManager-tui

# dnf install NetworkManager-tui

Lancer :

# nmtui

Puis choisir "Modifier une connexion"

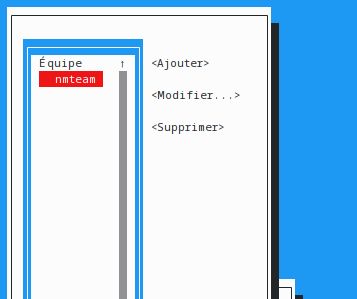

Choisissez votre périphérique réseau (généralement "enpXsX")

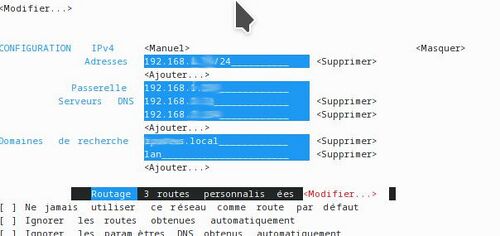

Allez sur "[Routage]..."

Ajouter les routes des Switch virtuels :

- Hôte 1 :

192.168.20.0/24 VERS-IP-DE-hote2192.168.30.0/24 VERS-IP-DE-hote3

- Hôte 2 :

192.168.10.0/24 VERS-IP-DE-hote1192.168.30.0/24 VERS-IP-DE-hote3

- Hôte 3 :

192.168.10.0/24 VERS-IP-DE-hote1192.168.20.0/24 VERS-IP-DE-hote2

KVM/QEMU (hyperviseurs)

On utilisera l'interface graphique virt-manager pour créer et gérer les 3 hyperviseurs sur un hôte, qui sera donc le gestionnaire de ceux-ci, ayant un environnement graphique. La création et gestion en ligne de commande sont possibles, mais plus complexes et ne seront pas abordées ici.

Voici le lien de base pour installer et configurer vos VM (à faire sur chaque hyperviseur) : Virtualisation : KVM, Qemu, libvirt en images.

Il est nécessaire de créer et partager la clef du gestionnaire avec les hyperviseurs : SSH : Authentification par clé.

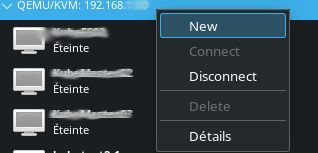

Ajout des hyperviseurs distant

Captures d'écran

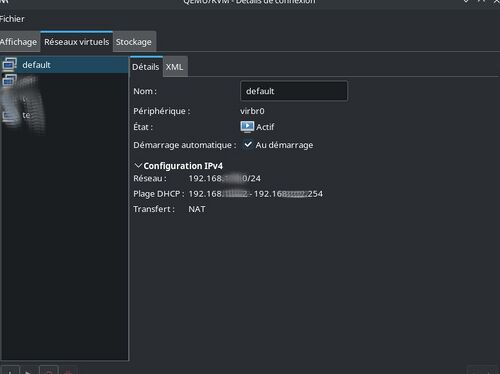

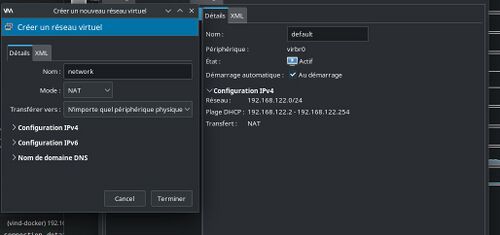

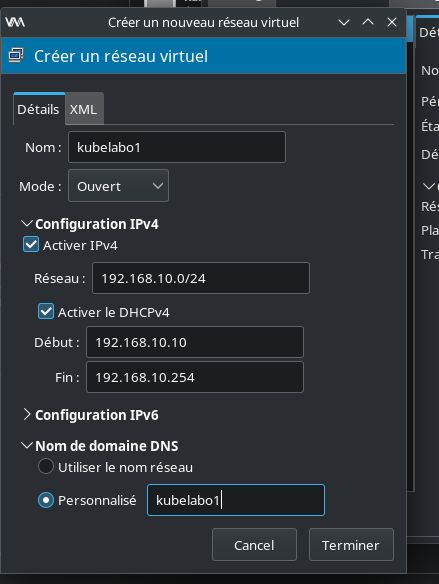

Réseaux virtuels (à faire sur chaque hyperviseur)

Ajout d'un réseau virtuel en mode "ouvert" (open) :

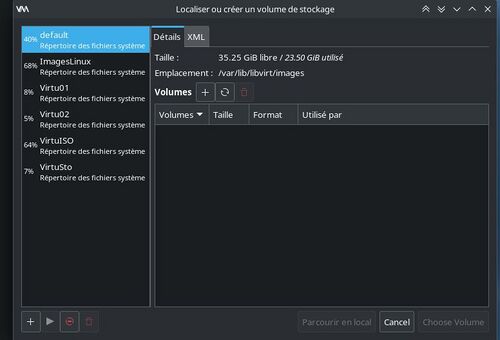

Capture interface "Réseaux virtuels" :

On change le mode par "Ouvert" ("OPEN") :

IPV4 (remplacer XX selon l'hôte en 1 : "10", en 2 : "20", etc) :

Réseau en 192.168.XX.0/24

DHCPV4 192.168.XX.10->192.168.XX.100

Nom de domaine DNS :

"Personnalisé" : ici kubelabo1/2/3/...

Ce réseau sera à utiliser dans la configuration de nos VM.

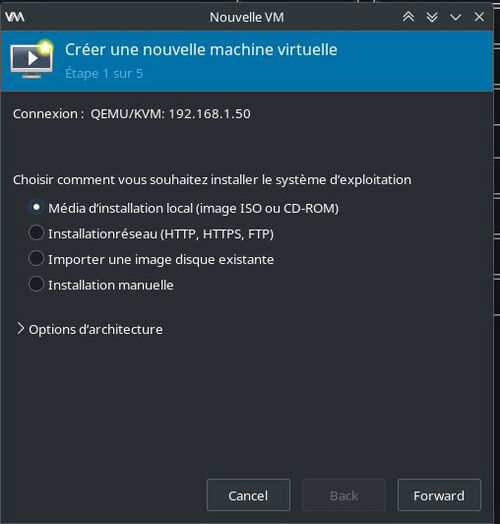

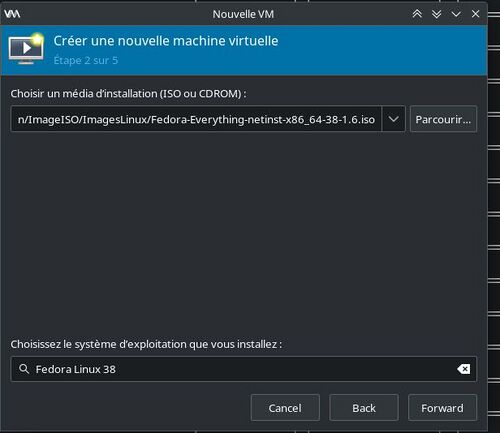

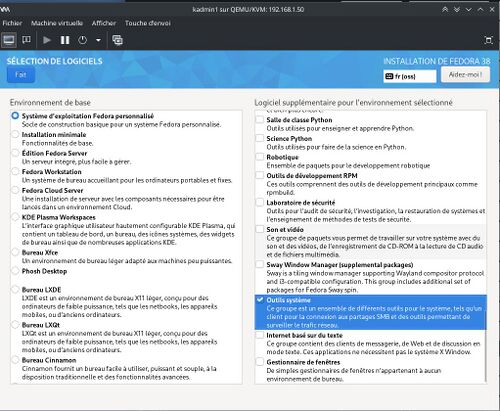

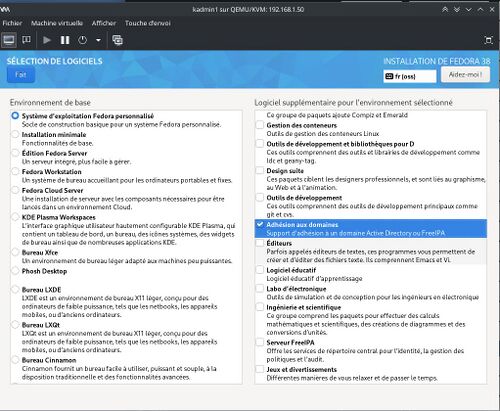

Création des Machines virtuelles

On utilisera une image ISO Fedora Linux (dernière en date) pour déployer nos machines virtuelles.

Il est préférable de partir sur une version Fedora "Everything" qui permet d'installer que ce dont nous avons besoin.

Exemple ici :

On clique droit sur notre hyperviseur et l'on fait "New"

On choisit comment créer notre VM

Choix de l'ISO utilisé pour l'installation avec le type de système utilisé

On sélectionne la taille de la mémoire et du/des vcpu

On crée notre unité de stockage personnalisée dans l'emplacement désiré

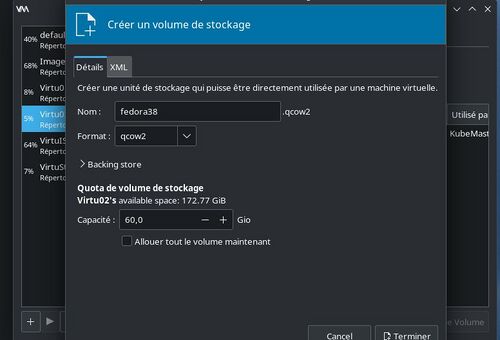

Choix d'une unité de stockage virtuel personnel (nom, taille, format)

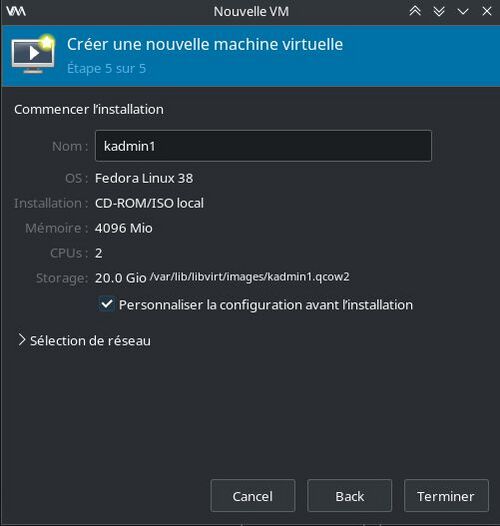

Définition du nom, sélection du réseau précédemment défini (ici ce sera R2 en mode "Open") et l'on coche la case pour activer la configuration personnalisée

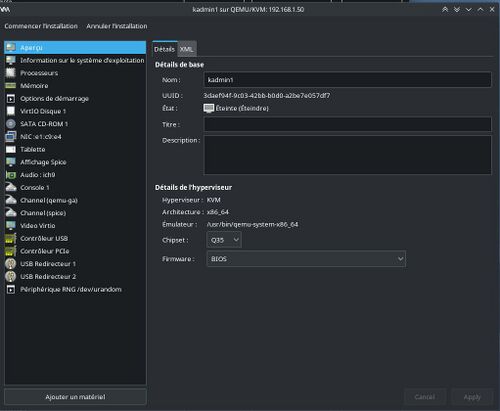

On vérifie les options et on commence l'installation

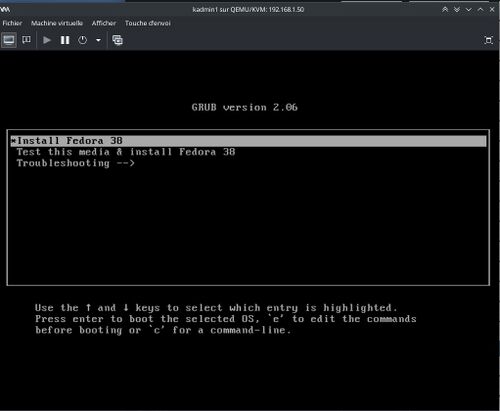

On lance l'installation de Fedora Linux (ici en version 38)

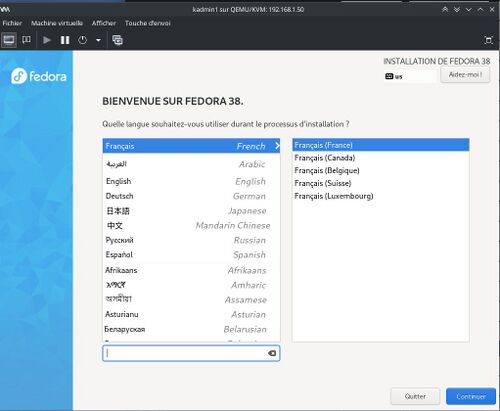

Choix de langue du système et du clavier

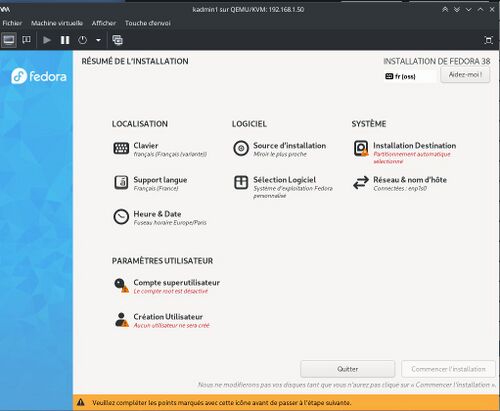

On modifie les différentes partie de notre système

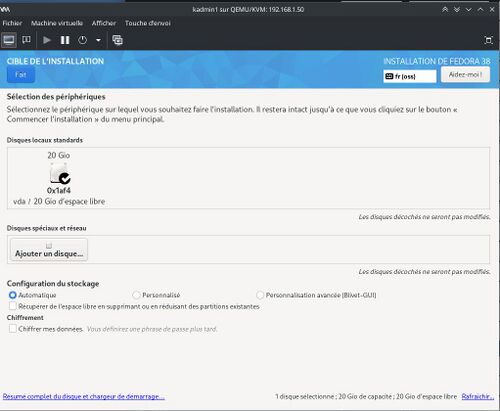

On définit notre système de fichier (ici automatiquement pour le disque système)

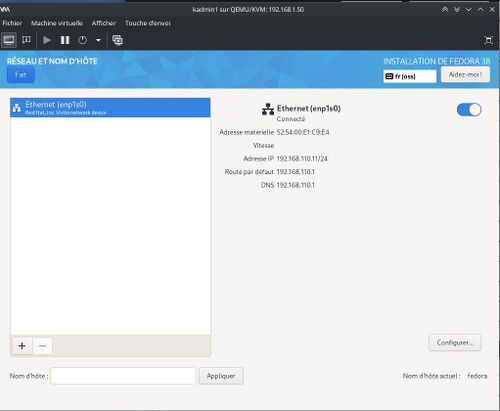

On reconfigure notre carte réseau thumb|500px|center On fixe les paramètres "IP/Masque de sous réseau/Passerelles" et le/les DNS

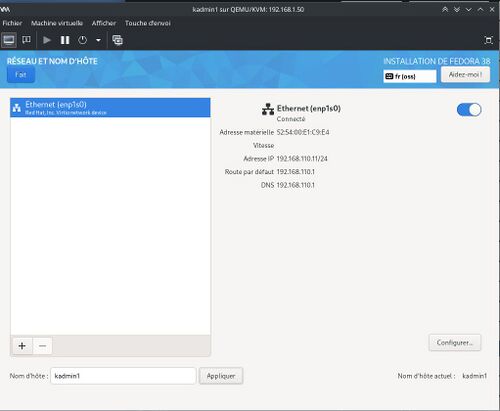

On modifie le "Nom d'hôte"

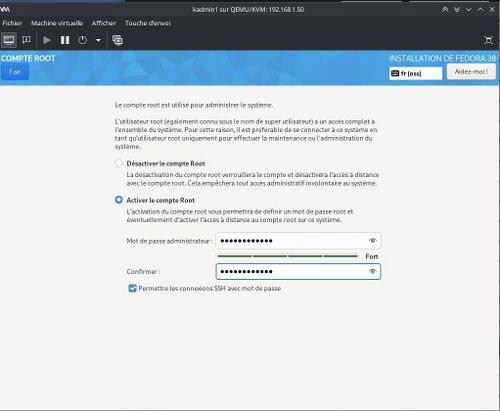

On définit un mot de passe ROOT et on active l'accès à distance (à modifier par la suite si besoin)

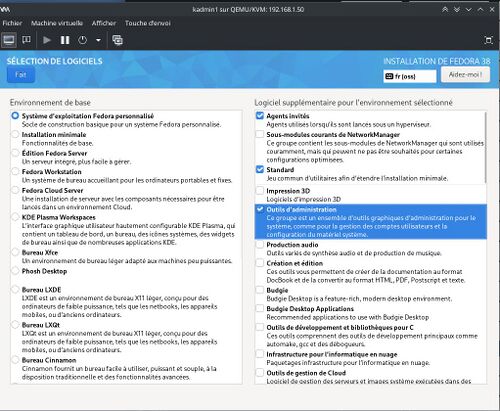

On sélectionne l'option par défaut et on active "Agent invité" (pour les VM),"Standard" et "Outils d'administration"

Plus bas on sélectionne "Outils système"

Et "Adhésion à un domaine" si nécessaire

On peut "commencer l'installation"

A fin d'éviter la redondance des opérations, nous utiliserons des boucles bash. A adapter si vous rajouter d'autres noeuds. Générer une clef ssh à partager sur les noeuds à partir du premier (ici kadmin1) :

# ssh-keygen -t ed25519 -q -N ""

En cas d'utilisation sans serveurs DNS dédié :

# for NODE in 192.168.10.10 192.168.20.10 192.168.30.10 192.168.10.20 192.168.20.20 192.168.30.20

do

ssh $NODE "tee -a /etc/hosts <<CRUN

192.168.10.10 kadmin1

192.168.20.10 kworker1

192.168.30.10 kworker2

192.168.10.20 kubefs01

192.168.20.20 kubefs02

192.168.30.20 kubefs03

CRUN"

done

Lancer la copy de la clef sur vos différents nœuds :

# ssh-copy-id 192.168.10.10

# ssh-copy-id 192.168.20.10

# ssh-copy-id 192.168.30.10

# ssh-copy-id 192.168.10.20

# ssh-copy-id 192.168.20.20

# ssh-copy-id 192.168.30.10

# create new (define each Node and SSH user) Host admin1 Hostname kadmin1 User root Host worker1 Hostname kworker2 User root Host worker2 Hostname kworker3 User root

# chmod 600 ~/.ssh/config

Firewalld

Nous utiliserons firewalld (A revoir, il y a un problème de redirection des flux Kubernetes avec le périphérique "cni0" en mode "BRIDGE") :

# for NODE in admin1 worker2 worker3

do

ssh $NODE "firewall-cmd --add-masquerade --permanent

firewall-cmd --add-forward --permanent

firewall-cmd --reload"

done

Règles du pare-feu pour les "admins" (ici kadmin1) :

# for NODE in admin1

do

ssh $NODE "firewall-cmd --add-service=kube-controller-manager-secure --add-service=kube-api --add-service=kube-apiserver --add-service=kube-controller-manager-secure --add-service=kube-controller-manager --add-service=kube-control-plane --add-service=kube-control-plane-secure --add-service=kubelet --add-service=kubelet-readonly --add-service=kubelet-worker --add-service=kube-nodeport-services --add-service=kube-scheduler --add-service=kube-scheduler-secure --add-service=kube-worker --add-service=http --add-service=https

firewall-cmd --add-port=8472/udp

firewall-cmd --add-port=8472/udp --zone=trusted

firewall-cmd --zone=trusted --add-interface=flannel.1 --add-interface=cni0

firewall-cmd --runtime-to-permanent"

done

Règles du pare-feu pour les "workers" (ici kworker2 et 3) :

# for NODE in worker2 worker3

do

ssh $NODE "firewall-cmd --add-service=kubelet --add-service=kube-worker --add-service=kube-nodeport-services --add-service=kubelet-readonly

firewall-cmd --add-port=30000-30250/tcp --add-port=8472/udp

firewall-cmd --zone=trusted --add-interface=flannel.1 --add-interface=cni0

firewall-cmd --runtime-to-permanent"

done

Kubernetes (VM)

La version de kubernetes fournie par défaut dépend de la version de Fedora Linux installée.

1.25 pour Fedora Linux 37, en 1.26 pour Fedora Linux 38, etc...

Installation sur "kadmin1" (en root)"

Que l'on ajoute dans un fichier (A revoir) :

# for NODE in admin1 worker2 worker3

do

ssh $NODE "cat <<EOF | sudo tee /etc/modules-load.d/k8s.conf

overlay

br_netfilter

EOF

systemctl restart systemd-modules-load.service"

done

On active quelques options système (A revoir, la partie "iptables" ne semble pas nécessaire) :

# for NODE in admin1 worker2 worker3

do

ssh $NODE "cat <<EOF | sudo tee /etc/sysctl.d/k8s.conf

net.bridge.bridge-nf-call-iptables = 1

net.bridge.bridge-nf-call-ip6tables = 1

net.ipv4.ip_forward = 1

user.max_pid_namespaces = 1048576

user.max_user_namespaces = 1048576

vm.swappiness = 10

EOF

sysctl --system"

done

| Information mémoire On gardera la gestion de la SWAP avec une utilisation au dernier moment (Après 90% d'utilisation). Par défaut on utilise de la ZRAM en mémoire RAM, mais il est possible de rajouter de la SWAP sur unité de stockage. Bien qu'il soit conseillé de désactiver la SWAP, il est préférable de ne pas le faire ayant eu souvent le cas où le manque de mémoire RAM à entraîné l'arrêt par OOMKILLER des pods/containers (en perso ou en pro). |

On installe les paquets suivants :

# for NODE in admin1

do

ssh $NODE "dnf install -y cri-o cri-tools crun kubernetes-client kubernetes-kubeadm kubernetes-node"

done

# for NODE in worker2 worker3

do

ssh $NODE "dnf install -y cri-o cri-tools crun kubernetes-client kubernetes-kubeadm kubernetes-node"

done

On vas modifier les paramètres de kubelet et crio et, dans ce dernier, rajouter l'utilisation de "crun" à la place de "runc" pour une meilleur gestion de l'empreinte mémoire (reprise de l'article de Fedoramagazine) :

for NODE in admin1 worker2 worker3 do ssh $NODE "sed -i 's/KUBELET_ADDRESS=\"--address=127.0.0.1\"/KUBELET_ADDRESS=\"--address=0.0.0.0\"/g' /etc/kubernetes/kubelet sed -i 's/# KUBELET_PORT=\"--port=10250\"/KUBELET_PORT=\"--port=10250\"/g' /etc/kubernetes/kubelet sed -i 's/KUBELET_HOSTNAME=\"--hostname-override=127.0.0.1\"/KUBELET_HOSTNAME=\"--hostname-override=$HOSTNAME\"/g' /etc/kubernetes/kubelet sed -i 's/# cgroup_manager/cgroup_manager/g' /etc/crio/crio.conf sed -i 's/# default_runtime = \"runc\"/default_runtime = \"crun\"/g' /etc/crio/crio.conf mkdir /etc/crio/crio.conf.d tee -a /etc/crio/crio.conf.d/90-crun <<CRUN [crio.runtime.runtimes.crun] runtime_path = \"/usr/bin/crun\" runtime_type = \"oci\" CRUN" done

On ajoute la configuration de l'uid/gid des utilisateurs/groupes pour kubernetes :

for NODE in admin1 worker2 worker3 do ssh $NODE "echo \"containers:1000000:1048576\" | sudo tee -a /etc/subuid echo \"containers:1000000:1048576\" | sudo tee -a /etc/subgid tee -a /etc/crio/crio.conf.d/91-userns <<USERNS [crio.runtime.workloads.userns] activation_annotation = \"io.kubernetes.cri-o.userns-mode\" allowed_annotations = [\"io.kubernetes.cri-o.userns-mode\"] USERNS chcon -R --reference=/etc/crio/crio.conf /etc/crio/crio.conf.d/ ls -laZ /etc/crio/crio.conf.d/" done

On recharge systemd pour prendre en compte nos modifications :

# for NODE in admin1 worker2 worker3

do

ssh $NODE "systemctl daemon-reload"

done

On active le service kubelet :

# for NODE in admin1 worker2 worker3

do

ssh $NODE "systemctl enable kubelet.service"

done

Et on active et démarre le service "crio" :

# for NODE in admin1 worker2 worker3

do

ssh $NODE "systemctl enable --now crio.service"

done

On récupère le subnet du fichier "/etc/cni/net.d/100-crio-bridge.conflist" (en gras), ici "10.85.0.0/16" :

{

"cniVersion": "1.0.0",

"name": "crio",

"plugins": [

{

"type": "bridge",

"bridge": "cni0",

"isGateway": true,

"ipMasq": true,

"hairpinMode": true,

"ipam": {

"type": "host-local",

"routes": [

{ "dst": "0.0.0.0/0" },

{ "dst": "::/0" }

],

"cniVersion": "1.0.0",

"ranges": [

[{ "subnet": "10.85.0.0/16" }],

[{ "subnet": "1100:200::/24" }]

]

}

}

]

}

On peut initialiser notre kubernetes comme suit (les noeuds prennent le nom du "hostname" dans notre cas) et l'on modifie l'IP du controlPlaneEndpoint avec l'ip/port du "kadmin1", "podSubnet" (correspond à l'option "--pod-network-CIDR") par celle du premier "subnet" reprise ci-dessus, exemple :

# for NODE in admin1

do

ssh $NODE "mkdir /root/projects

mkdir /root/projects/kubenode

cat <<CONFIG > kubeadmin-config.yaml

---

apiVersion: kubeadm.k8s.io/v1beta3

kind: InitConfiguration

nodeRegistration:

criSocket: \"unix:///var/run/crio/crio.sock\"

imagePullPolicy: \"IfNotPresent\"

kubeletExtraArgs:

cgroup-driver: \"systemd\"

resolv-conf: \"/run/systemd/resolve/resolv.conf\"

max-pods: \"4096\"

max-open-files: \"20000000\"

---

apiVersion: kubeadm.k8s.io/v1beta3

kind: ClusterConfiguration

kubernetesVersion: \"1.27.0\"

controlPlaneEndpoint: \"IP_kadmin1:6443\"

networking:

podSubnet: \"10.85.0.0/16\"

serviceSubnet: \"172.16.16.0/24\"

controllerManager:

extraArgs:

node-cidr-mask-size: \"20\"

allocate-node-cidrs: \"true\"

---

CONFIG"

done

On peut initialiser notre kubernetes comme suit :

# for NODE in admin1

do

ssh $NODE "kubeadm init --config=kubeadmin-config.yaml --skip-token-print=true"

done

Si tout ce passe bien, nous devrions pouvoir récupérer l'IP:Port du master et son token pour les workers (avec une durée limité) :

# kubeadm token create --ttl=30m --print-join-command

Nous vous conseillons de copier les commandes/token quelque part dans un portefeuille numérique crypté (keepass, kwallet, etc...)

Pour avoir accès en permanence aux commandes "kube" et complétion-automatique, on lance les commandes suivante sur le/les "Controle Plane" :

# mkdir -p $HOME/.kube sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config sudo chown $(id -u):$(id -g) $HOME/.kube/config

Ou temporairement :

# export KUBECONFIG=/etc/kubernetes/admin.conf

On ajoutera le pilote CNI "flannel" :

Flannel est un plug-in CNI open source mature et stable conçu autour d’un modèle de réseau superposé basé sur VXLAN et adapté à la plupart des cas d’utilisation de Kubernetes.

wget https://github.com/coreos/flannel/raw/master/Documentation/kube-flannel.yml

On vas modifier le fichier "kube-flannel.yml" avant de l'appliquer, car il est nécessaire de changer l'IP par défaut :

sed -i 's/10.244.0.0\/16/10.85.0.0\/16/g' kube-flannel.yml

sed -i 's/cbr0/cni0/g' kube-flannel.yml

A déployer comme suit :

# kubectl apply -f kube-flannel.yml

Il existe d'autre types de pilotes (calico, calcium, etc...), à vous de trouver celui qui vous convient le mieux.

Installation des workers (à partir de kadmin1) :

Et on lancera donc la commande pour rattacher nos nœud en tant que "worker" retourné par le retour de "kubeadm init..." :

for NODE in worker2 worker3

do

ssh $NODE "mkdir /root/projects

mkdir /root/projects/kubenoeud

cat <<CONFIG > /root/projects/kubenoeud/join-config.yaml

---

apiVersion: kubeadm.k8s.io/v1beta3

kind: JoinConfiguration

discovery:

bootstrapToken:

token: <TOKEN>

apiServerEndpoint: 192.168.xx.xx:6443

caCertHashes: [\"sha256:xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx\"]

timeout: 5m

nodeRegistration:

criSocket: \"unix:///var/run/crio/crio.sock\"

imagePullPolicy: \"IfNotPresent\"

kubeletExtraArgs:

cgroup-driver: \"systemd\"

resolv-conf: \"/run/systemd/resolve/resolv.conf\"

max-pods: \"4096\"

max-open-files: \"20000000\"

---

CONFIG"

done

Que l'on initialisera comme suit après modification :

# for NODE in worker2 worker3

do

ssh $NODE "kubeadm join --config=/root/projects/kubenoeud/join-config.yaml"

done

On teste si l'on voit tous les noeuds :

# kubectl get nodes

Résultat (exemple) :

# kubectl get nodes NAME STATUS ROLES AGE VERSION kadmin1 Ready control-plane 206d v1.26.7 kworker1 Ready <none> 205d v1.26.7 kworker2 Ready <none> 205d v1.26.7

On va modifier le rôle par défaut de nos nœuds en tant que "Worker" :

# kubectl label node kube0x node-role.kubernetes.io/worker="worker"

Résultat (exemple) :

# kubectl get nodes NAME STATUS ROLES AGE VERSION kadmin1 Ready control-plane 206d v1.26.7 kworker1 Ready worker 205d v1.26.7 kworker2 Ready worker 205d v1.26.7

Pour vérifier les pods :

# kubectl get pods -A -o wide

Résultat (exemple) :

kube-system coredns-xxxx-6sgjh 1/1 Running 12 120d kube-system coredns-xxxx-j2478 1/1 Running 19 141d kube-system coredns-xxxxx-x58lj 1/1 Running 25 52d kube-system etcd-kubexxxxx01.xxxxx 1/1 Running 126 206d kube-system kube-apiserver-kubexxxxr01.xxxxx 1/1 Running 31 157d kube-system kube-controller-manager-kubexxxxr01.xxxx 1/1 Running 31 157d kube-system kube-proxy-6jfzb 1/1 Running 25 157d kube-system kube-proxy-92vd4 1/1 Running 26 157d kube-system kube-proxy-gpkdq 1/1 Running 29 157d kube-system kube-proxy-hthq6 1/1 Running 11 154d kube-system kube-proxy-n62vl 1/1 Running 6 157d kube-system kube-scheduler-kubexxxxr01.xxxx 1/1 Running 25 141d kubernetes-dashboard dashboard-metrics-scraper-64bcc67c9c-mftc6 1/1 Running 22 152d kubernetes-dashboard kubernetes-dashboard-5c8bd6b59-gtwtm 1/1 Running 22 152d kube-flannel kube-flannel-ds-tqps8 1/1 Running 4 75m kube-flannel kube-flannel-ds-z2kvm 1/1 Running 4 75m kube-flannel kube-flannel-ds-x7bgm 1/1 Running 4 75m

Espace de stockage permanent en locale :

On vas lancer l'ajout d'un espace de stockage en locale (sur les hôtes qui ont pour rôle "worker") . Vous pouvez aussi utiliser d'autres méthodes plus approprié comme l'utilisation d'un cluster "GlusterFS", du NFS, ou du CEPH comme décrit ici : Infrastructure KVM/QEMU+Kubernetes#Ceph : (En cours)

Nous allons utiliser l'exemple, il en existe beaucoup d'autres, fourni par l'article : https://fedoramagazine.org/kubernetes-with-cri-o-on-fedora-linux-39/

C'est à faire sur chaque "Worker" (ici kworker1 et kworker2).

Création du dossier utilisé pour le stockage permanent :

# mkdir -m=777 /data

semanage fcontext -a -t container_file_t /data

restorecon -R -v /data

mkdir -m=777 /data/folder{1..2}

On vérifie l'état de nos dossiers

# ls -laZ /data

Résultat :

drwxrwxrwx. root root unconfined_u:object_r:container_file_t:s0 . drwxrwxrwx. user user unconfined_u:object_r:container_file_t:s0 folder1 drwxrwxrwx. user user unconfined_u:object_r:container_file_t:s0 folder2

Nous allons appliquer des labels à nos dossiers, c'est la commande "chcat" qui peut le faire :

# chcat -- +c800 /data/folder1 chcat -- +c801 /data/folder2

On vérifie :

# ls -laZ /data

Résultat :

drwxrwxrwx. unconfined_u:object_r:container_file_t:s0 . drwxrwxrwx. unconfined_u:object_r:container_file_t:s0:c800 folder1 drwxrwxrwx. unconfined_u:object_r:container_file_t:s0:c801 folder2

Sur le "master" nous allons créer deux pods, l'un accédant au dossier /data/folder1 avec la catégorie "c800", l'autre au /data/folder2 avec le groupe et la catégorie "c801". Nous limiterons l'accès qu'aux pods ayant cette option.

kubectl apply -f - <<EOF

apiVersion: v1

kind: Pod

metadata:

name: test-hostpath1

annotations:

io.kubernetes.cri-o.userns-mode: "auto:size=256"

spec:

securityContext:

seLinuxOptions:

level: "s0:c800"

containers:

- name: test

image: fedora/fedora:latest

args: ["sleep", "infinity"]

volumeMounts:

- mountPath: /test

name: test-volume

volumes:

- name: test-volume

hostPath:

path: /data

---

apiVersion: v1

kind: Pod

metadata:

name: test-hostpath2

annotations:

io.kubernetes.cri-o.userns-mode: "auto:size=256"

spec:

securityContext:

seLinuxOptions:

level: "s0:c801"

containers:

- name: test

image: fedora/fedora:latest

args: ["sleep", "infinity"]

volumeMounts:

- mountPath: /test

name: test-volume

volumes:

- name: test-volume

hostPath:

path: /data

EOF

On regarde l'état de nos pods :

# kubectl get pods NAME READY STATUS RESTARTS AGE test-hostpath1 1/1 Running 0 17s test-hostpath2 1/1 Running 0 17s

Créate d'un fichier dans l'espace de stockage sur le pod "test-hostpath1" :

# kubectl exec test-hostpath1 -- touch /test/folder1/testfile

Test Ok

# kubectl exec test-hostpath1 -- touch /test/folder2/testfile touch: cannot touch '/test/folder2/testfile': Permission denied

Sur "test-hostpath2" :

# kubectl exec test-hostpath2 -- touch /test/folder2/testfile

Test Ok

# kubectl exec test-hostpath2 -- touch /test/folder1/testfile touch: cannot touch '/test/folder2/testfile': Permission denied

Comme décrit dans l'article de FedoraMagazine, il faudra porter une attention particulière au niveau "s0" qui est trop permissif.

Vous pouvez vous référer à ces lien pour approfondire le sujet :

https://kubernetes.io/docs/tasks/configure-pod-container/security-context/

https://access.redhat.com/documentation/fr-fr/red_hat_enterprise_linux/9/html/using_selinux/getting-started-with-selinux_using-selinux

Commandes utiles :

Toutes les commandes utiles sont généralement disponibles ici : https://kubernetes.io/fr/docs/reference/kubectl/cheatsheet/

Nous rajouterons au fur et à mesure celles qui nous semblent les plus importantes ici :

- Pour récupérer la commande, ainsi que son token, pour ajouter un noeud :

kubeadm token create --print-join-command

- Pour récupérer la clef du certificat :

kubeadm init phase upload-certs --upload-certs

Résultat :

I0xx 17:01:40.112468 19386 version.go:256] remote version is much newer: v1.28.1; falling back to: stable-1.26 [upload-certs] Storing the certificates in Secret "kubeadm-certs" in the "kube-system" Namespace [upload-certs] Using certificate key: 2xxxxxxxxxxxxxxxxxxxxxxxxxxxxf57ca186bbc34xxxxxxxxxxxxxxxxxxxx

Export de notre configuration dans un fichier pour certains outils (exemple "kubenav" sur android disponible par F-droid : https://f-droid.org/packages/io.kubenav.kubenav/) :

kubectl config view --raw > kubetest.yaml

Mise à jours des noeuds :

Nous pouvons lancer une petite boucle en ligne de commande pour mettre à jours nos noeuds en même temps :

for NODE in kadmin1 kworker1 kworker2; do ssh $NODE "dnf clean all && dnf upgrade -y"; done

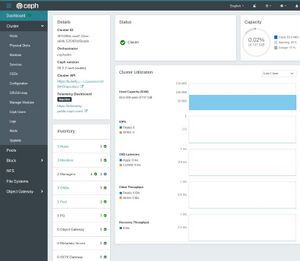

Ceph "REEF" (version 18.xx) :

Basé sur la documentation officielle valable pour "REEF" (peut être différent selon la version) :

Installation des serveurs CEPH (Basé sur la méthode recommendé "cephadm") :

https://docs.ceph.com/en/reef/cephadm/install/#cephadm-deploying-new-cluster

Et pour Kubernetes :

https://docs.ceph.com/en/latest/rbd/rbd-kubernetes/

Nous utiliserons le mode "POOL" mais il est possible d'en utiliser d'autres :

Pre-requis pour cette exemple :

- 3 VM appelé kubefs01,kubefs02 et kubefs03 sur 3 réseaux différents ( dans notre exemple : 192.168.10.0/24, 192.168.20.0/24, 192.168.30.0/24) :

- 1 VM par hôte physique (sauf dans le cas où vous n'utilisez pas cette partie)

- Composé au minimum de :

- 2 vcpu (possible de n'en mettre qu'un, mais cela n'est pas conseillé)

- 2Go de RAM

- 1 stockage supplémentaire de 10Go dédié au stockage CEPH

- Même conditions que pour la création des VM et concernant la partie réseau décrite ci-dessus

- Rajouter l'ip et le nom de ces VM dans /etc/hosts (exemple "192.168.10.50 kubefs01", etc...)

- Il faut parfois être patient, car le déploiement des services et la synchronisation des données peuvent prendre du temps.

Configuration préliminaire des nœuds :

Générer une clef ssh à partager sur les noeuds à partir du premier (ici kubefs01) :

# ssh-keygen -t ed25519 -q -N ""

# create new (define each Node and SSH user)

Host fsnode1

Hostname kubefs01

User root

Host fsnode2

Hostname kubefs02

User root

Host fsnode3

Hostname kubefs03

User root

# chmod 600 ~/.ssh/config

Lancer la copy de la clef sur vos différents noeuds :

# ssh-copy-id fsnode1

# ssh-copy-id fsnode2

# ssh-copy-id fsnode3

On lancera la boucle suivante :

for NODE in fsnode3 fsnode2 fsnode1

do

ssh $NODE "dnf -y install ceph ceph-exporter podman-compose"

done

On lance une boucle pour activer le service "ceph" du pare-feu sur chaque nœud :

for NODE in fsnode3 fsnode2 fsnode1

do

ssh $NODE "firewall-cmd --add-service=http --add-service=https --add-service=ceph --add-service=ceph-exporter --add-service=ceph-mon && firewall-cmd --add-port=9926/tcp && firewall-cmd --runtime-to-permanent"

done

On augmente le pid_max par défaut :

for NODE in fsnode3 fsnode2 fsnode1

do

ssh $NODE "cat <<EOF | sudo tee /etc/sysctl.d/k8s.conf

kernel.pid_max = 4194303

EOF

sysctl --system"

done

On lance l'installation de notre cluster CEPH en modifiant l'ip du serveur primaire :

cephadm bootstrap --mon-ip 192.168.10.50

Vous pouvez rajouter l'option si vous voulez utiliser la totalité de votre fqdn (exemple "kubefs01.toto.local") :

--allow-fqdn-hostname

On vérifie le status et la version installé :

ceph status ceph -v

On copy la clef ssh de notre Ceph sur les autres noeuds :

ssh-copy-id -f -i /etc/ceph/ceph.pub root@kubefs02 && ssh-copy-id -f -i /etc/ceph/ceph.pub root@kubefs03

Et on ajoute nos autres noeuds :

ceph orch host add kubefs02 192.168.20.50 ceph orch host add kubefs03 192.168.30.50

On vérfie la liste des hôtes de notre cluster CEPH :

ceph orch host ls

Résultat :

HOST ADDR LABELS STATUS kubefs01 192.168.10.50 _admin kubefs02 192.168.20.50 kubefs03 192.168.30.50 3 hosts in cluster

A faire si vous utilisez 3 réseaux différent comme notre exemple : activation du service "mon" (monitor) et rajout du "public_network" de chaque réseaux sur nos noeuds :

ceph config set mon public_network 192.168.10.0/24,192.168.20.0/24,192.168.30.0/24

Vous pouvez utiliser la commande suivante pour rattacher vos unités de stockage libre directement :

ceph orch apply osd --all-available-devices

D'autres options sont possible : https://docs.ceph.com/en/reef/cephadm/services/osd/#cephadm-deploy-osds

On vérifie le status après quelques minutes/heures le temps que nos unités de stockage soit synchronisées :

ceph status && ceph health detail

Résultat attendus :

cluster: id: 3f08730a-xxxxx-11ee-9cc7-xxxxxxxxxxxxx health: HEALTH_WARN 1 osds down 1 host (1 osds) down Degraded data redundancy: 1 pg undersized 1 slow ops, oldest one blocked for 136 sec, mon.kubefs01 has slow ops services: mon: 1 daemons, quorum kubefs01 (age 43m) mgr: kubefs01(active, since 42m), standbys: kubefs02 osd: 3 osds: 2 up (since 2m), 3 in (since 2m) data: pools: 1 pools, 1 pgs objects: 0 objects, 0 B usage: 80 MiB used, 60 GiB / 60 GiB avail pgs: 1 active+undersized HEALTH_OK

Vous pouvez allez dans le "Dashboard" avec votre navigateur Internet préféré :

https://IP-de-notre-premier-noeud:8443

Voilà, la première partie est terminé. Vous pouvez pousser plus loin, mais c'est fonctionnel en l'état.

Commandes utiles :

Mise à jours des noeuds :

Nous pouvons lancer une petite boucle en ligne de commande pour mettre à jours nos noeuds en même temps :

for NODE in kadmin1 kworker1 kworker2 fsnode1 fsnode2 fsnode3; do ssh $NODE "dnf clean all && dnf upgrade -y"; done

En cas de problèmes :

OSD :

Il est "down" :

En cas ou un OSD est en erreur sur le noeud incriminé relancer le service "OSD" :

# systemctl start ceph......@osd.X.service

Interface Web ("Dashboard") :

Plus de réponse du lien ou besoin de redémarrage :

ceph mgr module disable dashboard ceph mgr module enable dashboard

L'interface ne se lance pas sur le premier noeud :

Tester le second car il est possible que le dashboard puisse basculer (noeud primaire/secondaire)

Pour savoir où ce situe le dashboard :

ceph status

En gras le noeud actif :

cluster: id: 3f08730a-xxxxx-11ee-9cc7-xxxxxxxxxxxxx services: mon: 3 daemons, quorum kubefs03,kubefs02,kubefs01 (age 70m) mgr: kubefs01...(active, since 77m), standbys: kubefs02... osd: 3 osds: 3 up (since 70m), 3 in (since 70m)

Divers :

Pour éviter quelques problèmes lors du premier lancement de notre cluster :

# ceph osd set-full-ratio 0.97

On lance la commande suivante avec son résultat attendu :

# ceph osd dump | grep -i full

full_ratio 0.97 backfillfull_ratio 0.9 nearfull_ratio 0.85

Une fois les opérations automatique terminé, cela peut prendre pas mal de temps, il suffira de remettre la valeur par défaut comme suit :

# ceph osd set-full-ratio 0.95

Block Devices et Kubernetes (exemple repris de la doc officiel de CEPH) :

Pré-requis :

Il faut au minimum 3 noeuds kubernetes avec le rôle "Worker".

Soit :

- Rajouter une VM sur l'un de nos hyperviseurs

- On ajoutera la possibilité à notre master d'héberger des pods :

Si vous avez un seul noeud Kubernetes :

kubectl taint nodes --all node-role.kubernetes.io/master-

Si vous avez plusieurs noeuds kubernetes :

kubectl taint nodes --all node-role.kubernetes.io/control-plane-

Cette partie est un brouillon, merci de ne pas en tenir compte pour le moment.

On utilisera le module "RBD" pour cette partie

Création du POOL :

ceph osd pool create kubernetes

Une fois notre pool créé, nous allons l'initialiser pour utiliser rbd :

rbd pool init kubernetes

Authentification du CEPH-CSI :

Authentification du client :

Nous allons créer un nouvel utilisateur pour Kubernetes, ainsi qu'un ceph-csi (certificat signé) :

ceph auth get-or-create client.kubernetes mon 'profile rbd' \ osd 'profile rbd pool=kubernetes' \ mgr 'profile rbd pool=kubernetes'

Résultat à récupérer quelque part :

[client.kubernetes]

key = AQChdQJmwJxxxxxxxxxxxXXXXXXHg5Xzz4MYTxxxxxxxxxx==

Information pour le ConfigMap du CEPH-CSI :

On doit récupérer les information de ConfigMap et surtout le fsid (notre clusterID) et les informations des noeuds :

ceph mon dump <...> fsid b9127830-xxxx-4e34-xxxxx-xxxxxxxx <...> 0: [v2:192.168.10.50:3300/0,v1:192.168.10.50:6789/0] mon.kubefs01 1: [v2:192.168.20.50:3300/0,v1:192.168.20.50:6789/0] mon.kubefs02 2: [v2:192.168.30.50:3300/0,v1:192.168.30.50:6789/0] mon.kubefs03

Ici nous n'avons nos 3 monitor disponible.

Sur notre kubernetes "kadmin1" :

Configuration du CEPH-CSI CONFIGMAP :

Créer un répertoire de travail pour CEPH :

mkdir ~/projets mkdir ~/projets/ceph cd ~/projets/ceph

Dans ce répertoire, on vas générer un fichier yaml en modifiant les informations recueillis ci-dessus (fsid + ip des "monitors") :

cat <<EOF > csi-config-map.yaml

---

apiVersion: v1

kind: ConfigMap

data:

config.json: |-

[

{

"clusterID": "b9127830-xxxxxx-4e34-xxxxxx-xxxxxxxxx",

"monitors": [

"192.168.10.50:6789",

"192.168.20.50:6789",

"192.168.30.50:6789"

]

}

]

metadata:

name: ceph-csi-config

EOF

Pour l'appliquer :

kubectl apply -f csi-config-map.yaml

Nous devons rajouter un objet ConfigMap supplémentaire pour définir les détails du fournisseur du service de gestion des clés (KMS) :

cat <<EOF > csi-kms-config-map.yaml

---

apiVersion: v1

kind: ConfigMap

data:

config.json: |-

{}

metadata:

name: ceph-csi-encryption-kms-config

EOF

Pour l'appliquer :

kubectl apply -f csi-kms-config-map.yaml

On défini encore un autre objet ConfigMap pour la configuration de Ceph dans le ceph.conf dans nos conteneurs CSI :

cat <<EOF > ceph-config-map.yaml

---

apiVersion: v1

kind: ConfigMap

data:

ceph.conf: |

[global]

auth_cluster_required = cephx

auth_service_required = cephx

auth_client_required = cephx

# keyring is a required key and its value should be empty

keyring: |

metadata:

name: ceph-config

EOF

Pour l'appliquer :

kubectl apply -f ceph-config-map.yaml

Génération du CEPH-CSI CEPHX SECRET :

Il est nécessaire d'avoir les identifiant de CEPHX pour la communication avec notre cluster CEPH. Nous allons générer pour cela un Secret basé sur notre clef d'identification récupéré lors de la création de l'utilistateur pour Kubernetes plus haut :

cat <<EOF > csi-rbd-secret.yaml --- apiVersion: v1 kind: Secret metadata: name: csi-rbd-secret namespace: default stringData: userID: kubernetes userKey: AQChdQJmwJxxxxxxxxxxxXXXXXXHg5Xzz4MYTxxxxxxxxxx== EOF

Pour l'appliquer :

kubectl apply -f csi-rbd-secret.yaml

Configuration des Plugins CEPH-CSI :

Nous créons des ServiceAccount et des objets Kubernetes ClusterRole/ClusterRoleBinding RBAC. Nous allons reprendre des YAML pré-définis car il n'y a pas nécessité de les personnalisers (vous pouvez les télécharger si besoin) :

kubectl apply -f https://raw.githubusercontent.com/ceph/ceph-csi/master/deploy/rbd/kubernetes/csi-provisioner-rbac.yaml kubectl apply -f https://raw.githubusercontent.com/ceph/ceph-csi/master/deploy/rbd/kubernetes/csi-nodeplugin-rbac.yaml

On récupère les CEPH-CSI provisioner :

wget https://raw.githubusercontent.com/ceph/ceph-csi/master/deploy/rbd/kubernetes/csi-rbdplugin-provisioner.yaml

Pour l'appliquer :

kubectl apply -f csi-rbdplugin-provisioner.yaml

Ainsi que les plugins pour les noeuds :

wget https://raw.githubusercontent.com/ceph/ceph-csi/master/deploy/rbd/kubernetes/csi-rbdplugin.yaml

Pour l'appliquer :

kubectl apply -f csi-rbdplugin.yaml

Utiliser le CEPH BLOCK DEVICES :

Création du STORAGECLASS :

cat <<EOF > csi-rbd-sc.yaml --- apiVersion: storage.k8s.io/v1 kind: StorageClass metadata: name: csi-rbd-sc provisioner: rbd.csi.ceph.com parameters: clusterID: b9127830-xxxx-4e34-xxxxx-xxxxxxxx pool: kubernetes imageFeatures: layering csi.storage.k8s.io/provisioner-secret-name: csi-rbd-secret csi.storage.k8s.io/provisioner-secret-namespace: default csi.storage.k8s.io/controller-expand-secret-name: csi-rbd-secret csi.storage.k8s.io/controller-expand-secret-namespace: default csi.storage.k8s.io/node-stage-secret-name: csi-rbd-secret csi.storage.k8s.io/node-stage-secret-namespace: default reclaimPolicy: Delete allowVolumeExpansion: true mountOptions: - discard EOF

Pour l'appliquer :

kubectl apply -f csi-rbd-sc.yaml

Création d'un PERSISTENTVOLUMECLAIM (PCV) :

Cela vas nous permettre de faire une demande de ressource de stockage, par l'utilisateur, pour être associer à un POD et ainsi pouvoir fournir des volumes persistant géré par notre cluster CEPH à la demande.

La spécification Filesystem pour volumeMode peut prendre en charge à la fois ReadWriteOnce (Lire et Écrire sur un seul noeud) et ReadOnlyMany (Lire seulement multi-noeuds) comme accessMode claims (mode d'accès réclamé).

La spécification Block pour volumeMode peut quand à elle supporter ReadWriteOnce (Lire et Écrire sur un seul noeud) , ReadWriteMany (Lire et Écrire sur tous les noeuds), and ReadOnlyMany (Lire seulement multi-noeuds) comme accessMode claims (mode d'accès réclamé).

1 - Exemple Basé sur un PVC de type "BLOCK" :

cat <<EOF > raw-block-pvc.yaml

---

apiVersion: v1

kind: PersistentVolumeClaim

metadata:

name: raw-block-pvc

spec:

accessModes:

- ReadWriteOnce

volumeMode: Block

resources:

requests:

storage: 1Gi

storageClassName: csi-rbd-sc

EOF

Pour l'appliquer :

kubectl apply -f raw-block-pvc.yaml

Exemple de liaison de la revendication du PVC à une ressource de POD en tant que dispositif de type BLOCK (Blocs Bruts) :

cat <<EOF > raw-block-pod.yaml

---

apiVersion: v1

kind: Pod

metadata:

name: pod-with-raw-block-volume

spec:

containers:

- name: fc-container

image: fedora:39

command: ["/bin/sh", "-c"]

args: ["tail -f /dev/null"]

volumeDevices:

- name: data

devicePath: /dev/xvda

volumes:

- name: data

persistentVolumeClaim:

claimName: raw-block-pvc

EOF

Pour l'appliquer :

kubectl apply -f raw-block-pod.yaml

On crée notre file-system basé sur le PVC en utilisant notre StorageClass :

cat <<EOF > pvc.yaml

---

apiVersion: v1

kind: PersistentVolumeClaim

metadata:

name: rbd-pvc

spec:

accessModes:

- ReadWriteOnce

volumeMode: Filesystem

resources:

requests:

storage: 1Gi

storageClassName: csi-rbd-sc

EOF

Pour l'appliquer :

kubectl apply -f pvc.yaml

........

cat <<EOF > pod.yaml

---

apiVersion: v1

kind: Pod

metadata:

name: csi-rbd-demo-pod

spec:

containers:

- name: web-server

image: nginx

volumeMounts:

- name: mypvc

mountPath: /var/lib/www/html

volumes:

- name: mypvc

persistentVolumeClaim:

claimName: rbd-pvc

readOnly: false

EOF

Exemples pratiques :

Avancée :

Sécurité :

Pare-feu(firewall) :

Coté système, nous pouvons jouer avec les règles du pare-feu (firewall) :

Parefeu - firewall - firewalld

https://firewalld.org/documentation/

Kubernetes :

Coté Kubernetes, vous pouvez vous inspirer des liens suivant :

https://kubernetes.io/docs/concepts/security/ (en anglais)

https://www.redhat.com/fr/topics/containers/intro-kubernetes-security (en français généralement)